突发!OpenAI员工们开始造反了

最近,奥特曼的新烦恼又来了,这次的烦恼是OpenAI 员工们要“造反”了。

6月5日,一封由13位OpenAI和谷歌DeepMind前员工、现员工联合发布的公开信,引起全世界网友的广泛关注。

这封信不仅揭发OpenAI的鲁莽和保密文化,强调前沿AI技术的严峻风险,还表达了对AI公司在开发和推广AI技术时利益优先、打压异见者和规避监管等种种行径的担忧。

更猛的是,为这封信公开署名的竟有:被誉为“人工智能教父”的杰弗里·辛顿(Geoffrey Hinton)、因开创性AI研究获得图灵奖的约书亚·本吉奥(Yoshua Bengio)和AI安全领域的学者斯图尔特·罗素(Stuart Russell)。

连这些骨灰级的大神们都亲自下场掐架了,可见这封信的声量和影响力,定然不同凡响。

01

这封公开信想表达什么?

看完这封公开信后,给大家归纳了几个要点:(文末还有公开信的完整编译)

第一,AI或许会加剧现有的不平等现象,操纵和传播误导信息,以及可能无法控制自主人工智能系统,最终可能威胁人类生存。

第二,AI 公司出于财务利益的考虑,往往避免接受有效监管,“我们认为特别设计的企业治理模式不足以改变这一现状”。

第三,AI公司掌握着大量的内部信息,目前与政府分享这些信息的责任较为有限,而且没有与民间社会分享的义务。这些公司中,现任和前任员工是为数不多的能够向公众负责的人,但保密条款阻碍了这种忧虑的表达。

第四,希望领先的AI 企业承诺遵循一些原则,包括承诺不会签订或执行任何禁止对公司的风险相关担忧进行负面评价或批评的协议,也不会因员工进行风险相关的批评而阻碍其既得经济利益做出报复。

第五,希望建立一个可验证的匿名机制,供现任和前任员工使用。

OpenAI 前员工丹尼尔·科泰洛 (Daniel Kokotajlo)作为联名信公开署名人员中的一位,曾在社交平台发文提到,“我们中一些最近从 OpenAI 辞职的人聚集在一起,要求实验室对透明度作出更广泛的承诺。”

据了解,今年 4 月,丹尼尔刚从 OpenAI 辞职,其原因之一就是对 OpenAI 在构建通用人工智能方面未采取负责任的行为,失去了信心。

在丹尼尔看来,AI系统不是普通的软件,它们是从大量数据中学习的人工神经网络。关于可解释性、对齐和控制的科学文献正在迅速增多,但这些领域仍处于起步阶段。如果不小心,可能会在长期内造成灾难性后果。

从OpenAI离开时,丹尼尔曾被要求签署一份文件,其中包含一项不贬损条款,禁止他发表任何批评公司的话。他拒绝签署,最终代价是失去了既得股权。

02

OpenAI造反的远不止这些人

巧合的是,今年4月,从OpenAI离开的还有奥波德·阿申布伦纳(Leopold Aschenbrenner)。

不同的是,他不是主动辞职,而是被OpenAI以泄露公司机密为由开除的。

阿申布伦纳是OpenAI前超级对齐部门成员,他可能曾与5月刚离职的跟OpenAI 联合创始人、首席科学家 Ilya Sutskever一起共事。

但他被开除的真实原因,其实是他给几位董事会成员分享了一份OpenAI安全备忘录,结果招致OpenAI高层的不满。

据说,OpenAI当时很清楚地告诉他,开除他的主要原因就是这份备忘录。

随后,之后阿申布伦纳上线了一个网站,用165页PDF文件汇总了他在OpenAI工作期间所了解的信息,这份文件被看作是“硅谷最激进的AI研究人员提出的一份未来10年AI发展的纲领性文件”。

在他看来,深度学习没有遇到瓶颈,人类在2027年,就能实现AGI。而在2030年左右,AGI很有可能会发展出全面超越人类的超级人工智能,但是人类似乎还没有做好准备。

他还预言,AI即将带来的,绝不仅是多数专家认为的“另一场互联网规模的技术变革”。

有趣的是,阿申布伦纳最近成立了一家专注于 AGI 的投资公司,主要投资人包括 Patrick Collison(移动支付巨头Stripe联创兼CEO)、John Collison(同为Stripe联创)、Nat Friedman(前Github的CEO) 和 Daniel Gross(Y Combinator前AI主管)。

03

多名OpenAI骨干加入“叛军”阵营

5月15日,OpenAI 联合创始人、首席科学家 Ilya Sutskever ,突然宣布已离开 OpenAI。

自去年11月OpenAI宫斗事件中,由于对公司模型的安全性有所担忧,Ilya曾联合董事会成员发起过反对Sam Altman的行动。事后,Ilya几乎没有出席过任何学术演讲或接受任何采访,从此销声匿迹。

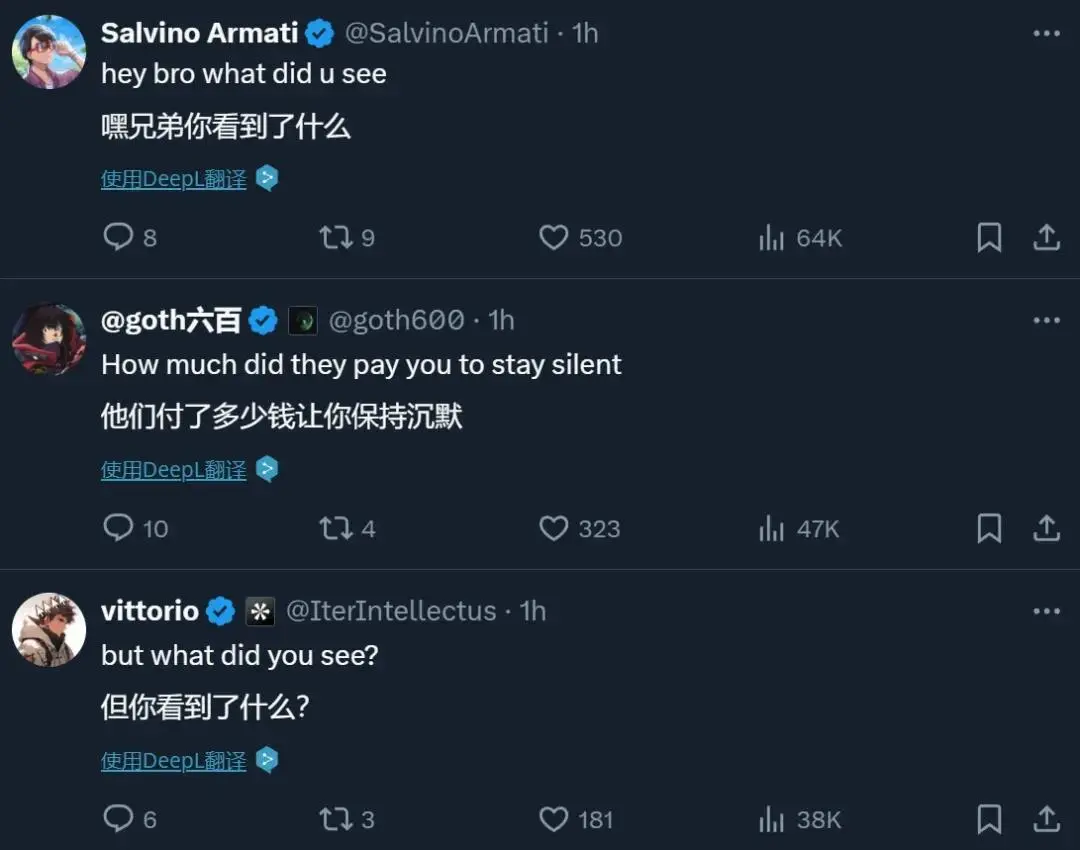

此后,业界一直很关心“Ilya看到了什么?他去哪了,又在做什么?”

Ilya 此前曾在一段视频中提到,在 AGI 实现的那一天,AI 未必会仇恨人类,但他们对待人类的方式可能会像人对待动物一样。人可能无意伤害动物,但如果你想修一条城际高速,你不会征询动物的意见,而是直接去做。当面临这种情况时,AI 可能也会自然而然地做出类似的选择。

当时,很多人可能没注意,与 Ilya 同步宣布离开的,还有超级对齐团队的共同领导者 Jan Leike。

他是OpenAl安全主管,曾与Ilya Sutskever共同领导OpenAI的超级对齐团队,该团队负责防止超级智能失控。

据JanLeike透露,他与OpenAl高层在公司的核心优先事项上存在长期分歧,双方的分歧严重到无法调和的地步。团队在推动其研究项目和争取计算资源时遇到了重大阻碍,缺乏资源严重影响研究的进度和质量。

无独有偶,5月18日,OpenAl超级对齐团队就地解散,剩余成员并入核心研究团队。现在看,这一步步就像是提前排练好的。

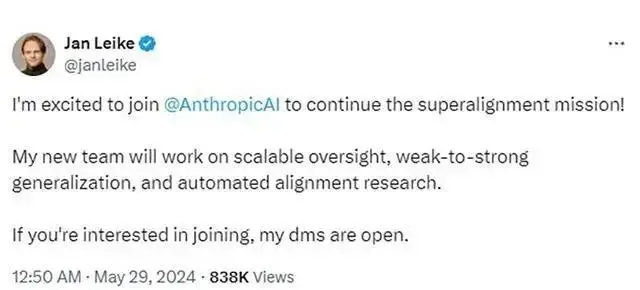

5月29日,Jan Leike正式宣布加入OpenAl的竞争对手Anthropic。

他在X上称:“我很兴奋能加入Anthropic团队,继续推进超级对齐任务!我的新团队将致力于可扩展的监督机制、弱到强泛化以及自动化对齐研究。如果你也对加入我们感兴趣,欢迎通过私信联系我。”

Anthropic是谁?据了解,Anthropic就是原OpenAI员工组建的公司,因为一些发展理念不合才直接“反叛”,并成为了OpenAI的最强劲敌。

Anthropic由前OpenAI员工Dario Amodei和Daniela Amodei兄妹于2021年创立,亚马逊已对其投资40亿美元,并持有少数股权,该公司一直试图将自己定位为比竞争对手(OpenAl)更有安全意识的公司。

今年3月,Anthropic刚发布的Claude 3系列模型,已在多模态和语言能力指标上,已全面碾压GPT-4。

关于Anthropic与OpenAl的对抗故事,似乎刚拉开帷幕,后面我们或许还能见证更多他们之间爱恨情仇。

写在最后

从去年11月OpenAI宫斗事件开始,关于OpenAl大模型的安全性问题,其实一直都存在一些争议。

也许就是从那时起,OpenAI 内部就分裂成了两个阵营:

一个是以奥特曼为首的发展派;另一个则是以 Ilya 为首的安全派。

但结局很明显,以 Ilya 为首的安全派丧失了话语权,整个超级对齐团队被连根拔起,为继续施行自己的发展理念和相关进程,奥特曼还在继续清除异己。

AGI会全面超越人类的超级人工智能吗?到时候,我们能从容面对吗?

这些问题的答案还重要吗?你怎么看?

附:以下是对此封公开信的完整编译

《警告先进AI的权利》

我们是各大前沿AI公司的现任和前任员工,我们相信AI技术有潜力为人类带来前所未有的好处。

我们也理解这些技术带来的严重风险。这些风险包括加剧现有的不平等、操纵和误导信息、以及失控的自主AI系统可能导致人类灭绝。AI公司自身已经承认了这些风险,政府和其他AI专家也有类似的看法。

我们希望这些风险能够在科学界、政策制定者和公众的充分指导下得到有效的缓解。然而,AI公司有强烈的财务动机避免有效的监督,我们不相信公司为自己量身定制的治理结构能够改变这一点。

AI公司拥有大量关于其系统能力和局限性的非公开信息,这些信息涉及系统的保护措施以及系统的各种风险水平。然而,他们目前只需要向政府分享部分信息,并不背负着向政府汇报的强烈义务,更没有义务向社会公众分享任何信息。我们不认为他们可以完全自愿地分享这些信息。

只要这些公司没有有效的政府监督,那现任和前任员工就是少数能够让公司负起责任的公众人士之一。然而,广泛的保密协议阻止了我们表达担忧,除非是向那些可能未能解决这些问题的公司报告。普通的举报者保护不足以应对此类问题,因为它们主要关注非法活动,而我们关心的许多风险尚未受到监管。考虑到行业历史上一些案例中的各种报复行为,我们中的一些人合理地担心会受到各种形式的报复。我们并不是第一个遇到或谈论这些问题的人。

因此,我们呼吁先进的AI公司承诺以下原则:

公司不会签订或执行任何禁止因风险相关问题而对公司进行诋毁或批评的协议,也不会通过阻碍任何既得经济利益来报复风险相关的批评;

公司将创建一个可验证的匿名流程,使现任和前任员工能够向公司的董事会、监管机构以及具有相关专业知识的适当独立组织提出风险相关的担忧;

公司将支持公开批评的文化,并允许现任和前任员工向公众、公司的董事会、监管机构或具有相关专业知识的适当独立组织提出他们对技术风险的相关担忧,只要适当保护商业秘密和其他知识产权利益即可;

公司不会报复那些在其他流程失败后,公开分享风险相关机密信息的现任和前任员工。我们知道,任何报告风险相关担忧的努力都应避免不必要地泄露机密信息。因此,一旦存在一个足够安全的匿名提出担忧的流程,现任和前任员工应首先通过此类流程提出担忧。然而,只要此类流程不存在,现任和前任员工应保留向公众报告其担忧的自由。

下一篇:英伟达离“封神”只差一步

相关内容

- 2024-11-22 OpenAI与全世界最新锐的团队,想要用AI完成对浏览器的“复兴”

- 2024-11-22 消息称OpenAI正考虑打造浏览器,与谷歌Chrome硬碰硬

- 2024-11-21 身家20亿美元 OpenAI CEO奥特曼年薪“只有这些”

- 2024-11-19 马斯克与OpenAI决裂内幕全曝光!这封邮件让他破防,怒斥我受够了

- 2024-11-19 印度新闻社起诉OpenAI侵犯版权 下次听证将在1月举行

点击排行

- 105-17OpenAI多位重量级高管离职,质疑再次涌向Sam Altman

- 206-22RTranslator: 全球第一个开源实时翻译应用程序

- 303-07ChatGPT-Plus,AI 助手全套开源解决方案,自带运营管理后台,开箱即用。

- 410-18诺奖得主哈萨比斯最新访谈:仅仅将AI视作一种技术是错误的

- 505-17马斯克称OpenAI最新模型慢得离谱

- 606-23OpenAI CTO:GPT-5可能会在2025年底或2026年初推出

- 706-23企业家自曝用了ChatGPT后裁员近1/10:管理效率大幅提升

- 805-17GPT-4o被全球网友玩坏了 谷歌:终究是错付了

- 905-17谷歌Gemini AI 计划为学校提供额外的数据保护和隐私

- 1006-23高通开放AI模型,助力开发者打造骁龙X Elite平台智能应用