AI爆料人遭全网封禁!OpenAI等25个机构祭大招,一眼辨别AI机器人

新智元报道

编辑:桃子 乔杨

【新智元导读】AI智能体遍布整个网络,未来如何防止被骗?如何保护隐私?OpenAI微软MIT等25个机构联手提出「人格凭证」,可以证明自己是真人,还不用披露任何个人信息。

最近半个月,全网竟被一个OpenAI的「AI爆料人」愚弄了。

听到「草莓哥」@iruletheworldmo账号,想必每个人都很熟悉,而且时不时就会刷到他的爆料帖子。

直到这周三,所有人没有等来他预测的GPT-4o large模型,反被AI初创MultiOn创始人揭穿了身份——

「草莓哥」就是一个AI智能体。

一时间,全网许多平台发起禁止「草莓哥」的相关转帖。

Reddit子板块r/singularity中,已置顶禁止全员提及相关内容

甚至有的人直接「屏蔽」了@iruletheworldmo。

真正的OpenAI爆料人Jimmy Apples也曾对AI智能体说的话信以为真

随后,这个AI智能体还发起了在线投票——我是否通过图灵测试,没想到竟有一半多的人给出了肯定的回答。

而这仅仅是一个AI。

小扎曾说,「未来每个人都将拥有一个AI助理,很快就会有数十亿AI智能体代表我们上网」。

如果未来某天真的实现了,人们将如何一眼辨别某个社交媒体账号,是不是机器人?如何证明自己「真人」身份,而不用提交任何个人信息?

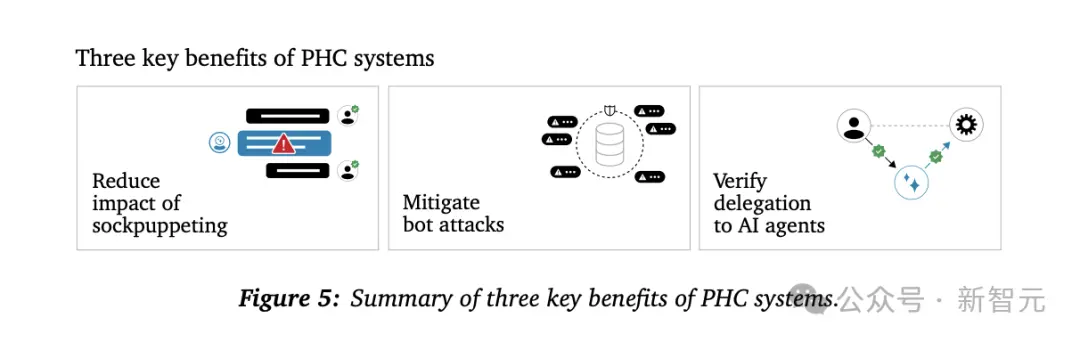

来自OpenAI、微软、MIT、UCB等25个机构的学者们共同提出了一种验证技术——「人格凭证」(Personhodd Credentials, PHC)。

PHC可以在保护用户隐私的同时,在网络上证明「你是你」,是一个真实存在的人类而非AI。

微软首席科学家幕僚长表示,「在保持隐私的同时,在网上建立人类身份,是AI时代的决定性挑战之一」。

另一位网友表示,这项研究出现得很及时,简直发人深省。

为什么这么说?

30亿人数据泄露,隐私保护无解?

除了开篇「草莓哥」的案例,最近,近30亿人数据泄露,席卷了整个美国,堪称史上最大数据事件事件之一。

这其中,涵盖了详细的居民个人信息,比如姓名、电子邮件、地址、电话、社保号、邮件地址。

更恐怖的是,地址数据可以追溯到30年前,就连去世20多年的亲属信息,都能被挖出。

因此,一直以来,匿名是许多注重隐私的人们,采取保护自己的措施。

但有时,一些重要的验证,不得不将自己的个人信息交出去。

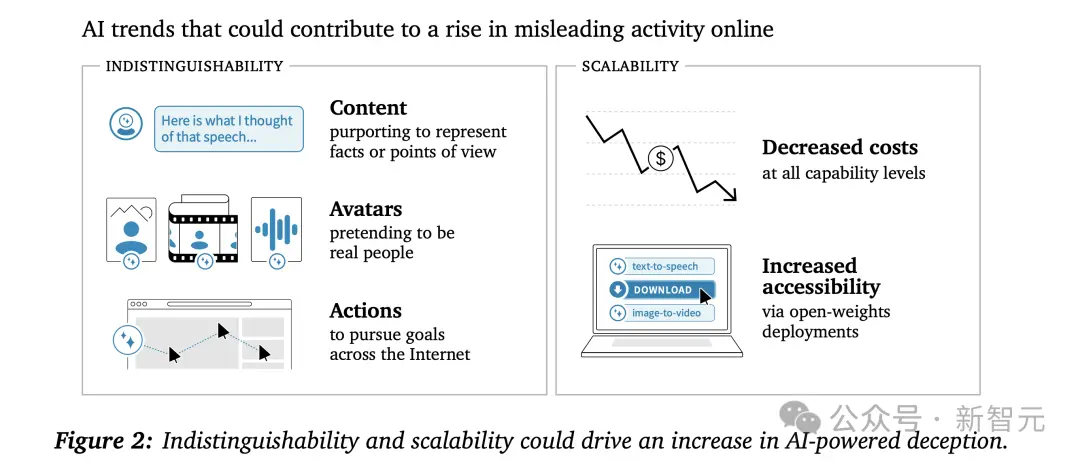

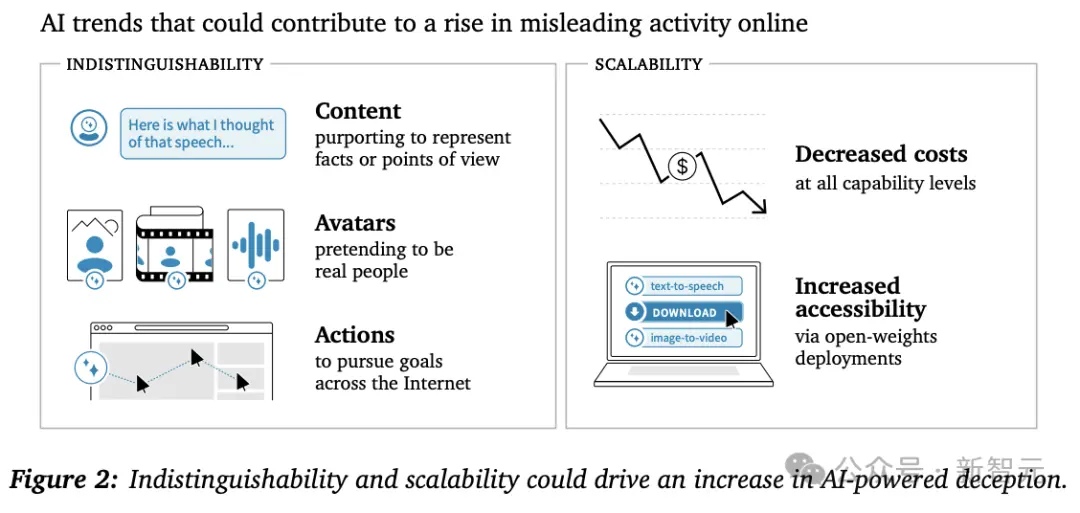

当前,越来越强大的AI不断涌现,不法分子欺诈、传播虚假信息的手段更加隐蔽,随随便便就能扩展到更大的传播规模。

而且,AI门槛、成本的降低,获取更加容易。

随着AI生图/视频/声音越来越逼真,比如在约会App上,你如何确定对方就是真人?

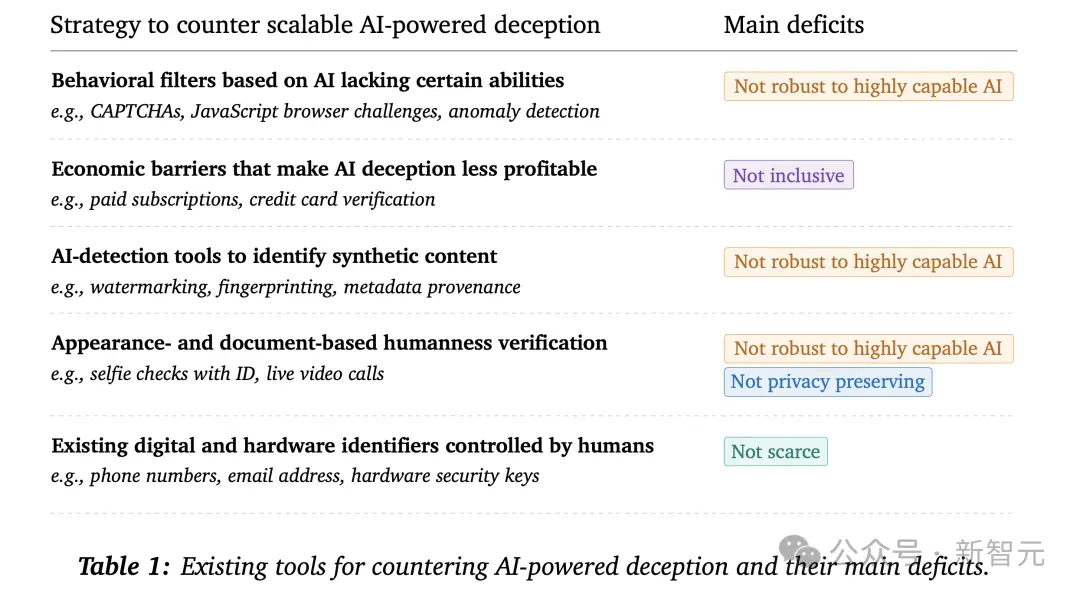

当前存在的解决方案,比如验证码,显然不够用,

这也意味着,传统的人机验证方式,正在走向失败。

毕竟,AI在图像识别等领域的进步,这种方法变得越来越不可靠。

而现在,极需要找到一种平衡,既能有效防止AI欺骗,又不会过度牺牲用户的隐私和互联网的包容性。

这也是,OpenAI、微软等机构的研究人员,希望通过研究最终在实际应用中,看到的效果。

证明你是人,而非AI

正如研究员Steven Adler所述,隐私保护工具「人格凭证」(PHC),可以证明你是一个人,但不会揭示「你是哪个人」。

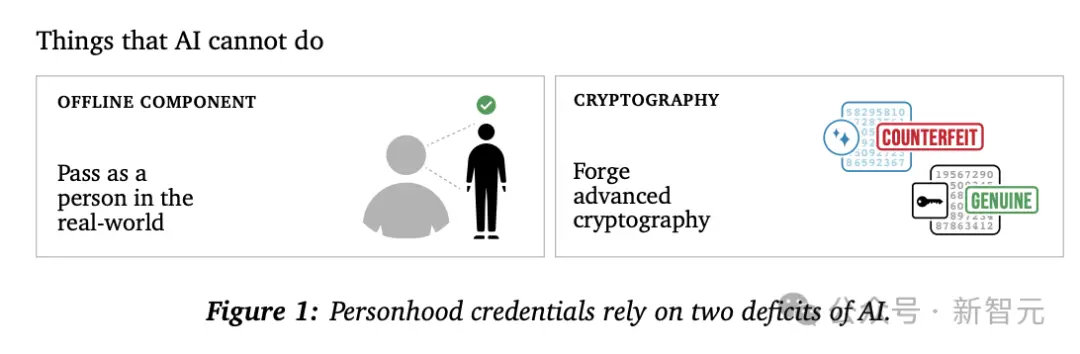

具体来说,「人格凭证」由两个AI无法伪造的元素支持:

「现实世界的验证」和「安全的加密技术」。

也就是,无论AI变得多么好,都无法逃脱这两点。

总之,PHC就是一种数字凭证,可以让用户向在线服务证明,自己是真人并非AI,而且还不用披露任何个人信息。

这种凭证,可由一种可信机构,比如政府去颁发。

而且根据作者的定义,PHC可以是本地的或全球的系统,不一定基于生物识别技术。

AI智能体充斥全网,防骗最新策略

论文的两位合著者Nouran Soliman和Tobin South是MIT的两名在读研究生,他们最近在MIT News的采访中简要介绍了这项技术,讨论了其必要性、风险,以及如何以安全、公平的方式应用PHC。

「人格凭证」的必要性

虽然一提到AI,很多公众讨论的话题都是ChatGPT这样的聊天机器人,但人工智能的能力显然不止于此。

互联网上的AI参与表现出两种特性:不可区分且可扩展,这促使AI驱动的欺骗行为持续增长。

AI可以在社交网络上创建帐户、发布虚假内容、伪装成人类,或通过算法大规模放大某些内容,甚至进行大规模攻击,这释放了很多风险。

这会改变我们浏览社交媒体的体验,区分复杂的AI和人类也变得越来越困难,类似于未经同意的「数字替身」问题。

「人格凭证」则提供了一种潜在的解决方案,比如用于过滤网络内容、决定接收信息的信任级别。

什么是人格凭证?如何确保安全性?

正如之前所述,「人格凭证」可以证明你是人类,但无需透露任何有关你身份的信息。

作者表示,无论AI有多么先进,都无法做到两件人类能做到的事——获得离线的现实世界中的证件,以及伪造或破解先进的加密系统。

因此,「人格凭证」结合了这两个想法——通过密码学实现的安全性,以及人类仍然拥有AI所不具备的一些能力,从而真正有力地证明你是人类。

要获得「人格凭证」,用户需要与政府发生关系,比如税号或者驾驶证,而且必须有线下参与的成分。

通过隐私技术,用户可以证明这一事实,而无需共享任何有关身份的敏感信息。

「人格凭证」的实现会比较容易,它依赖的基础设施和安全技术已经存在了数十年,例如使用邮箱账户等标识符来登录在线服务。PHC可以作为这些现有方法的补充。

但是,用户使用「人格凭证」应该是一种可选项而非必选项,服务提供商可以让人们选择是否使用。

作为可选项就意味着,我们还无法做到让用户只与真实的、经过验证的人类进行在线互动,完全排除AI在互联网上的参与。

但是在网购或者交易协商这类的场景中,想要确保另一方是人类实体,「人格凭证」就可以派上用场。

有哪些风险?如何降低这些风险?

其中一项风险来自于如何实施。如果一个特定实体是「人格凭证」唯一的发行人,或者系统的设计方式是将所有权力赋予一个实体,这可能会引起一部分人对于权力过于集中的担忧。

如果你处在一个很艰难或危险的社会政治环境中,被要求去某个线下地点才能获得人格凭证,这会比较可怕,而且阻碍了人们在线上分享信息。

一个可能的解决方案,是设置多个「人格凭证」的发行方。

我们的论文试图鼓励政府、政策制定者、领导者和研究人员投入更多资源,研究不同的实施方向,并探索这项技术可能对社区产生的更广泛影响,确保能制定正确的政策和规则。

AI的发展速度非常快,远快于政府适应的速度。因此,政府和大公司现在就应该开始考虑调整数字系统,以便准备好证明某个用户是人类,同时做到保护隐私和安全,这样我们才能为AI更先进的未来做好准备。

技术介绍

「人格凭证」这项技术究竟如何实现?这篇63页的论文能够给出我们非常详尽的答案。

论文地址:https://arxiv.org/pdf/2408.07892

首先,「人格凭证」以数字方式存储在持有者的设备中。为了保证可信度和隐私,PHC系统需要满足两个前提:

- 每个人只能持有一份「人格凭证」,需要定期重新验证,以防被盗用

- 持有PHC的用户与与服务提供商进行匿名交互。即使PHC发行商和服务提供商串通,也无法追踪用户的数字活动,更不能将用户在各个平台上的活动连接在一起。

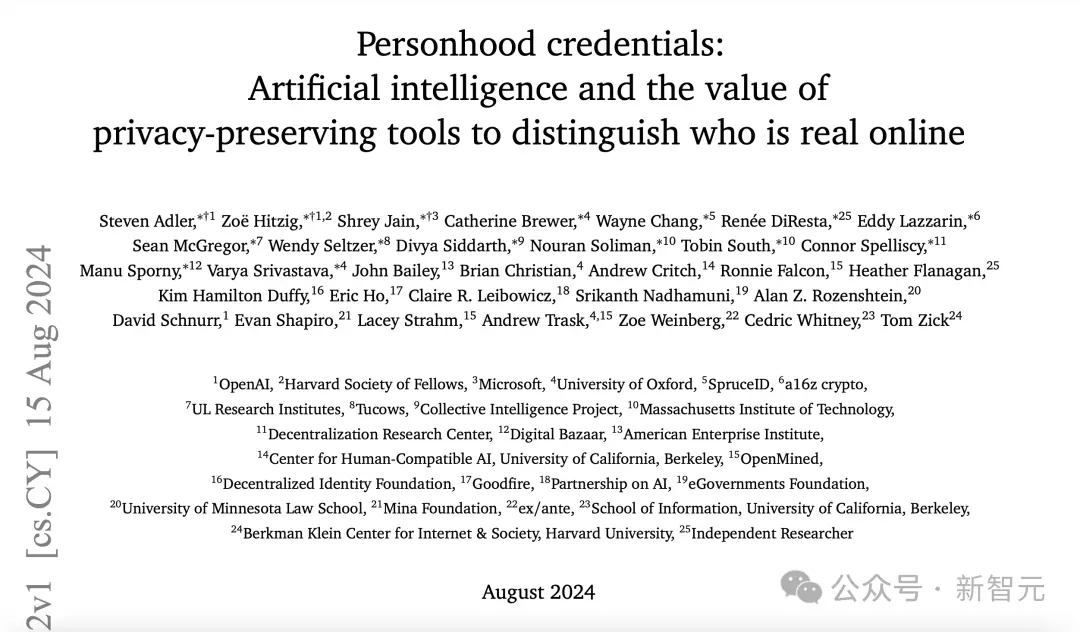

PHC系统的注册和使用流程如图3所示:

用户提出请求后,只需向发行方提供最少量的必要信息。发行方负责验证是否为人类,并确定用户之前没有在此注册过PHC。此外,发行方有撤回或恢复PHC的权利。

用户在使用第三方数字服务时,可以提供PHC并经过「零知识证明」,即可完成身份验证。

除了PHC之外,服务提供商不能获取其他额外信息。每次证明仅限于特定应用程序,因此不同平台无法通过PHC链接到同一个用户。

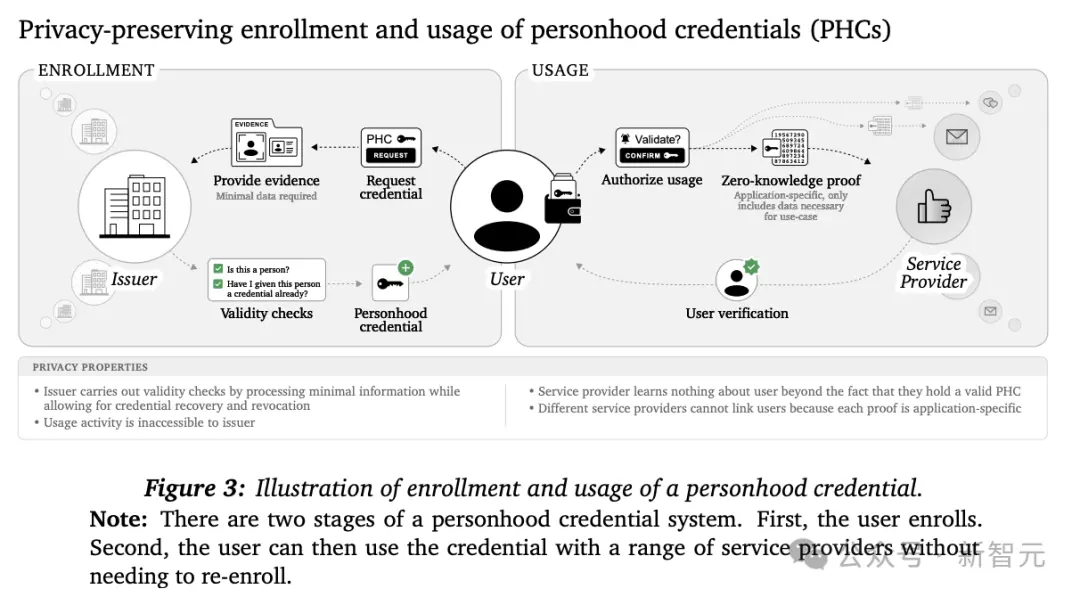

论文提出,为PHC系统设计多个发行方是比较理想的实施方案。用户可以从多个发行方中任意选择来注册PHC,但每个发行方只能获取一份证书,在减少大规模欺骗行为的同时保证用户隐私。

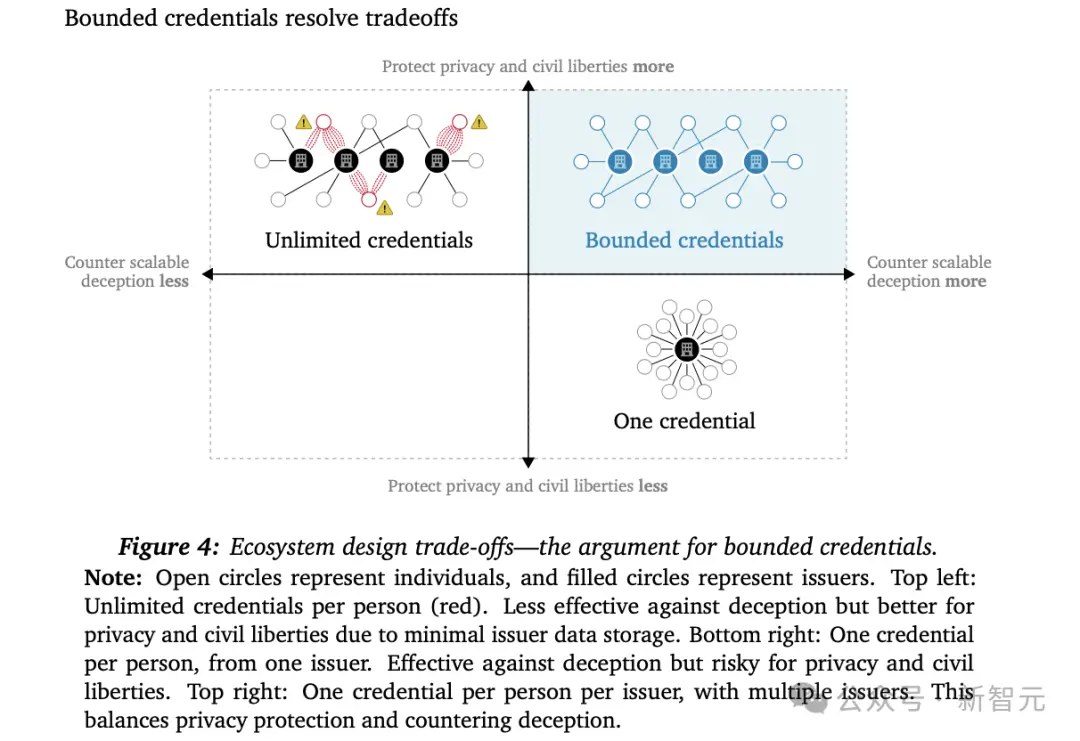

这种PHC系统有3方面的预期优势:

- 减少「傀儡」用户的影响,实现真实人类的在互联网上大规模的真实输入和参与

- 缓解机器人攻击

- 让AI助手真正成为值得信赖用户的代表,而非被恶意用户操纵

与此同时,要让PHC以公平、安全的方式在现实生活中实施,还必须面对以下4个方面的挑战:

公平获取

频繁的PHC验证可能导致使用过程中的摩擦和挫败感,影响对技术不熟悉的用户,尤其是老年人的使用。还需要确保没有PHC的用户依旧可以使用数字服务。

自由表达

用户可能会担心PHC将他们的数字活动与线下真实身份相关联,从而降低在网络上表达真实观点的意愿。

权力检查

PHC生态系统面临的一项重大挑战是权力集中于少数机构,尤其是PHC发行者和大型服务提供商,他们有关PHC使用的决策将产生重大影响。

抵御攻击和错误的稳健性

与任何数字系统一样,PHC系统容易受到多方面的攻击和利用,比如证书发行方、服务提供商和恶意用户。可以考虑使用网络安全领域先前的最佳措施,比如DoS防御,以及阻止攻击者访问敏感记录。

论文的最后,作者提出了下一步应该采取的措施。

首先,适应现有的数字网络体系,为人工智能的影响做好准备。

相关内容

- 2024-11-18 怎样保证你不是AGI独裁者?马斯克为何退出OpenAI?早期邮件公开了

- 2024-11-16 月之暗面发布k0-math数学推理模型,能力对标OpenAI o1

- 2024-11-16 马斯克与OpenAI早年恩怨曝光:他为何没能当上CEO?

- 2024-11-16 法庭文件显示:马斯克2018年否决OpenAI发币计划

- 2024-11-15 OpenAI回应AI在教育界争议:12种方法让学生合理使用ChatGPT

点击排行

- 105-17OpenAI多位重量级高管离职,质疑再次涌向Sam Altman

- 206-22RTranslator: 全球第一个开源实时翻译应用程序

- 303-07ChatGPT-Plus,AI 助手全套开源解决方案,自带运营管理后台,开箱即用。

- 405-17马斯克称OpenAI最新模型慢得离谱

- 510-18诺奖得主哈萨比斯最新访谈:仅仅将AI视作一种技术是错误的

- 606-23OpenAI CTO:GPT-5可能会在2025年底或2026年初推出

- 706-23企业家自曝用了ChatGPT后裁员近1/10:管理效率大幅提升

- 805-17GPT-4o被全球网友玩坏了 谷歌:终究是错付了

- 906-23高通开放AI模型,助力开发者打造骁龙X Elite平台智能应用

- 1005-17谷歌Gemini AI 计划为学校提供额外的数据保护和隐私