OpenAI o1模型问世,五级AGI再突破!推理极限超博士,清北复旦华人立功

就在刚刚,OpenAI最强的o1系列模型忽然上线。毫无预警地,OpenAI就扔出这一声炸雷。

传说中两周内就要上线的草莓模型,居然两天内就来了!

从今天开始,o1-preview在ChatGPT中会向所有Plus和Team用户推出,并且在API中向tier 5开发者推出。

同时,OpenAI还发布了o1-mini——一种经济高效的推理模型,非常擅长STEM,尤其是数学和编码。

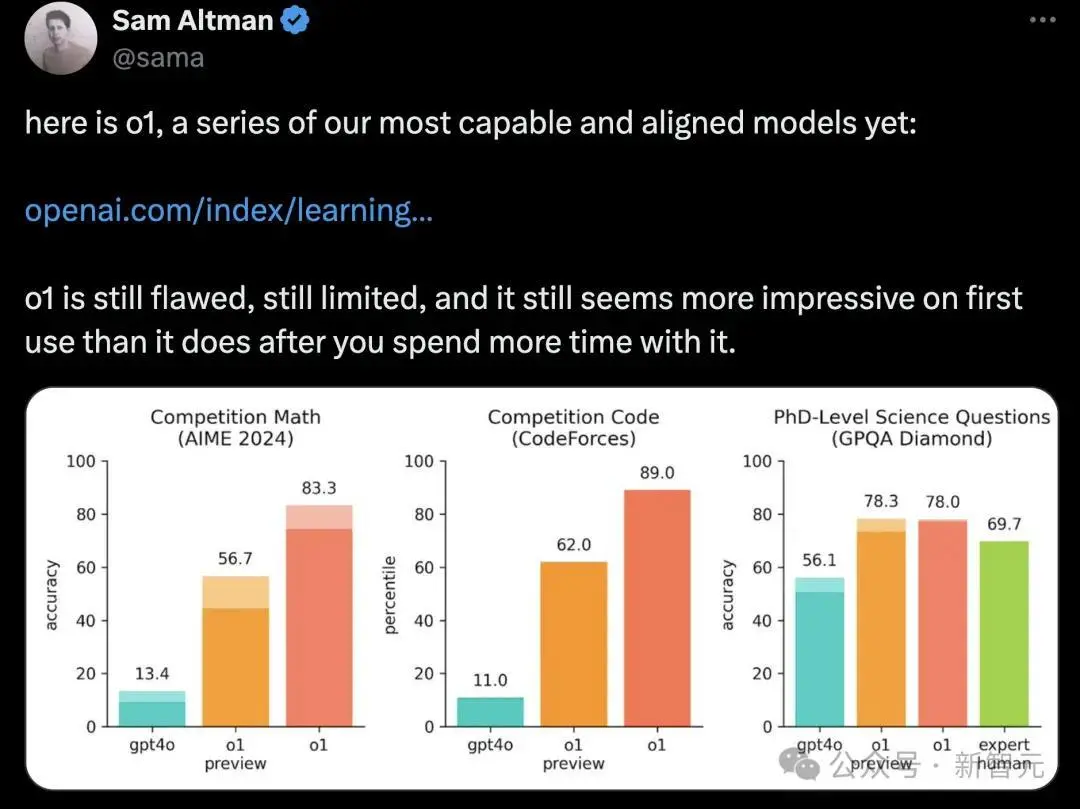

o1模型仍存在缺陷、局限性,它在首次使用时比长期使用,更令人印象深刻

全新的o1系列,在复杂推理上的性能又提升到了一个全新级别,可以说拥有了真正的通用推理能力。

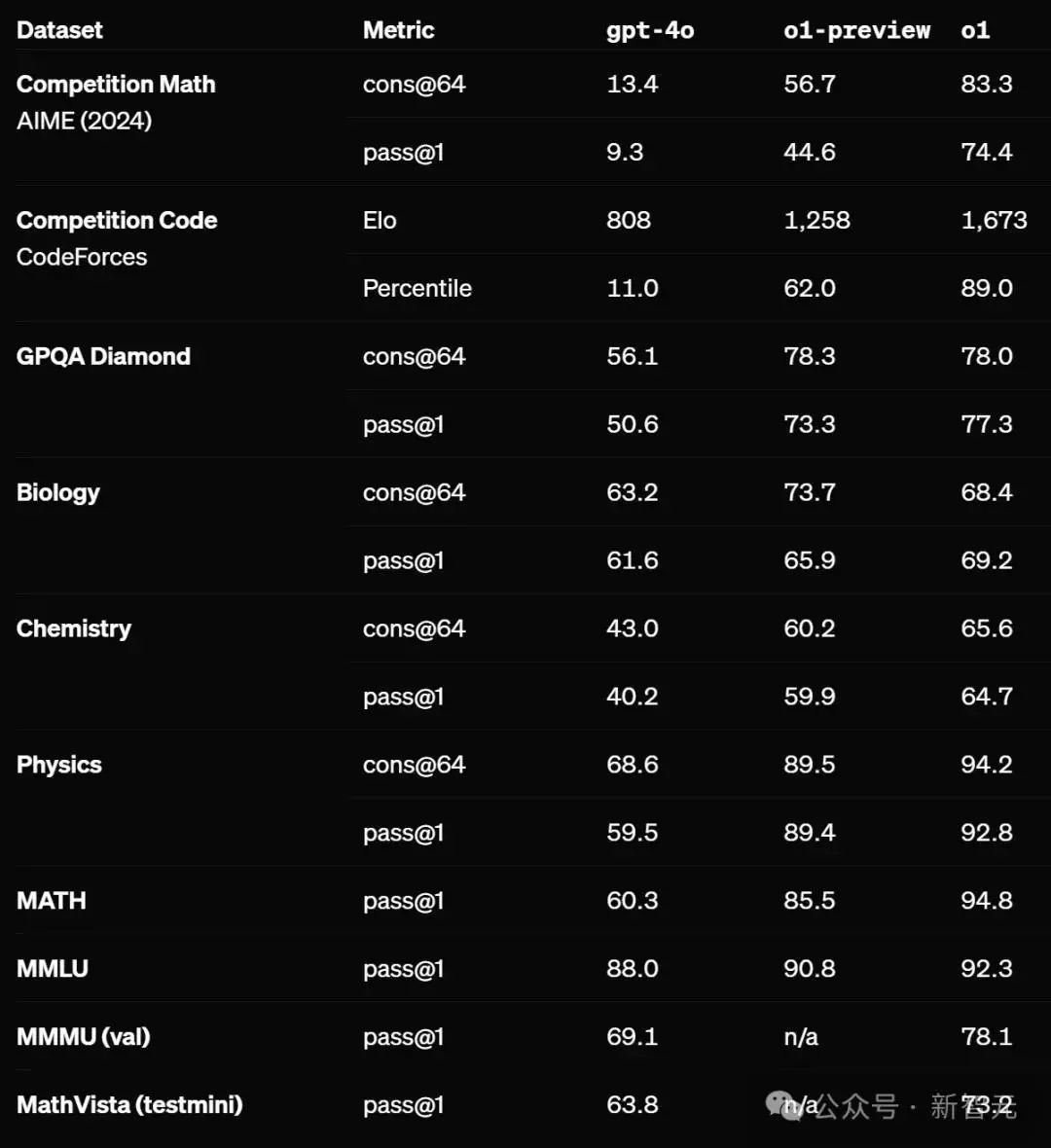

在一系列基准测试中,o1相比GPT-4o再次有了巨大提升,具有了奥数金牌能力,在物理、生物、化学问题的基准测试中,直接超过了人类博士水平!

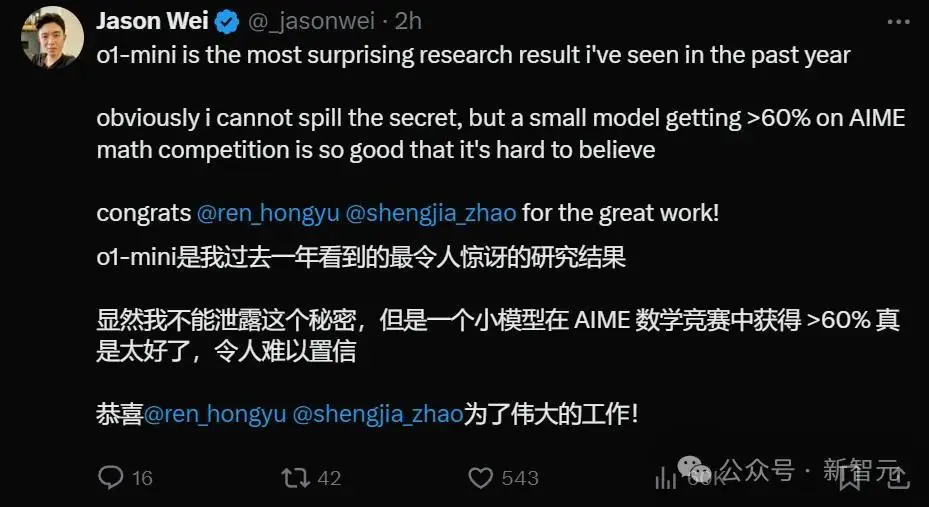

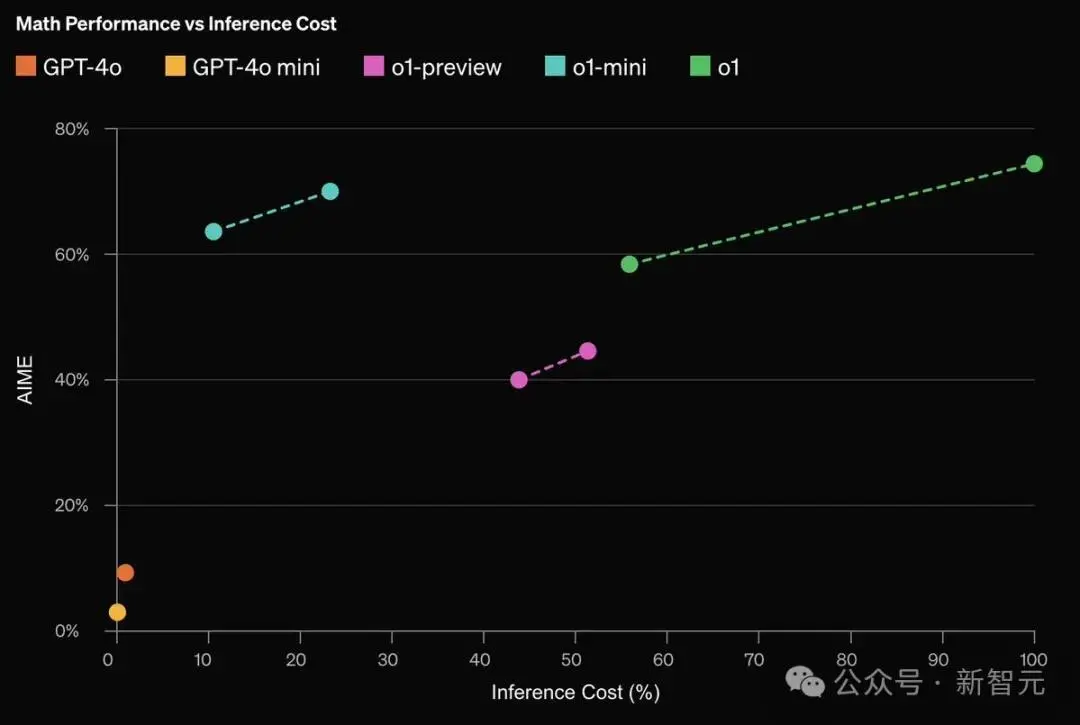

OpenAI研究员Jason Wei表示,o1-mini是自己过去一年看到的最令人惊讶的研究成果。一个小模型,居然在AIME数学竞赛中获得了高于60%的成绩。

不过,从OpenAI文章中的附录来看,这次放出的preview和mini似乎都只是o1的「阉割版」。

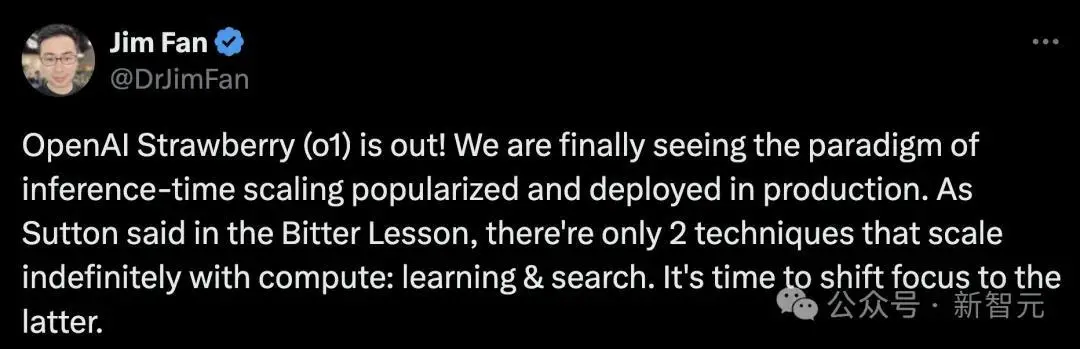

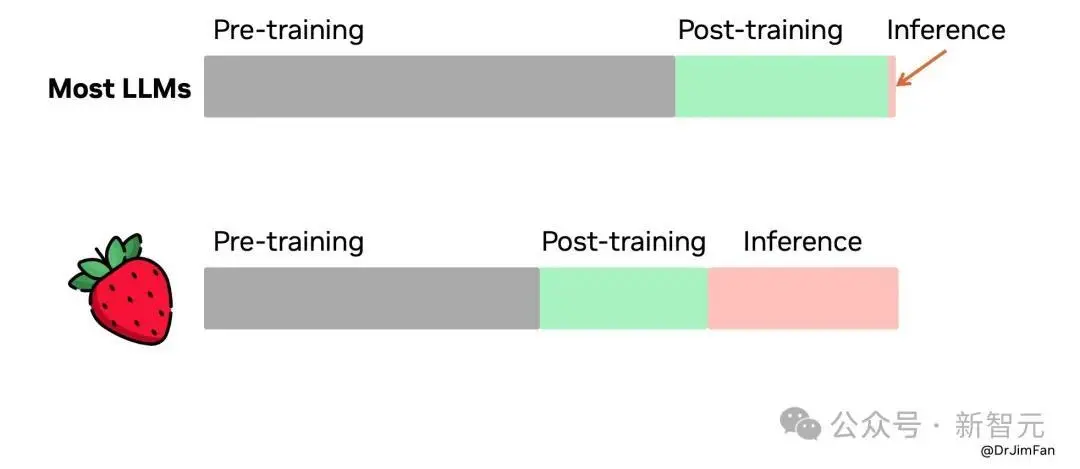

推理Scaling新范式开启

英伟达高级科学家Jim Fan对o1模型背后原理做了进一步解析。

他表示,推理时间Scaling新范式正在大范围普及和部署。正如Sutton在「苦涩的教训」中所言,只有两种技术可以无限scaling计算能力:学习和搜索。

现在,是时候将重点转向后者了。

1. 进行推理不需要巨大的模型。

2. 大量计算从预训练/后训练,转移到推理服务

3. OpenAI一定很早就发现了推理scaling法则,而学术界最近才开始发现

4. 将o1投入实际应用中,比在学术基准测试中取得好成绩要困难得多

5. Strawberry很容易成为一个数据飞轮

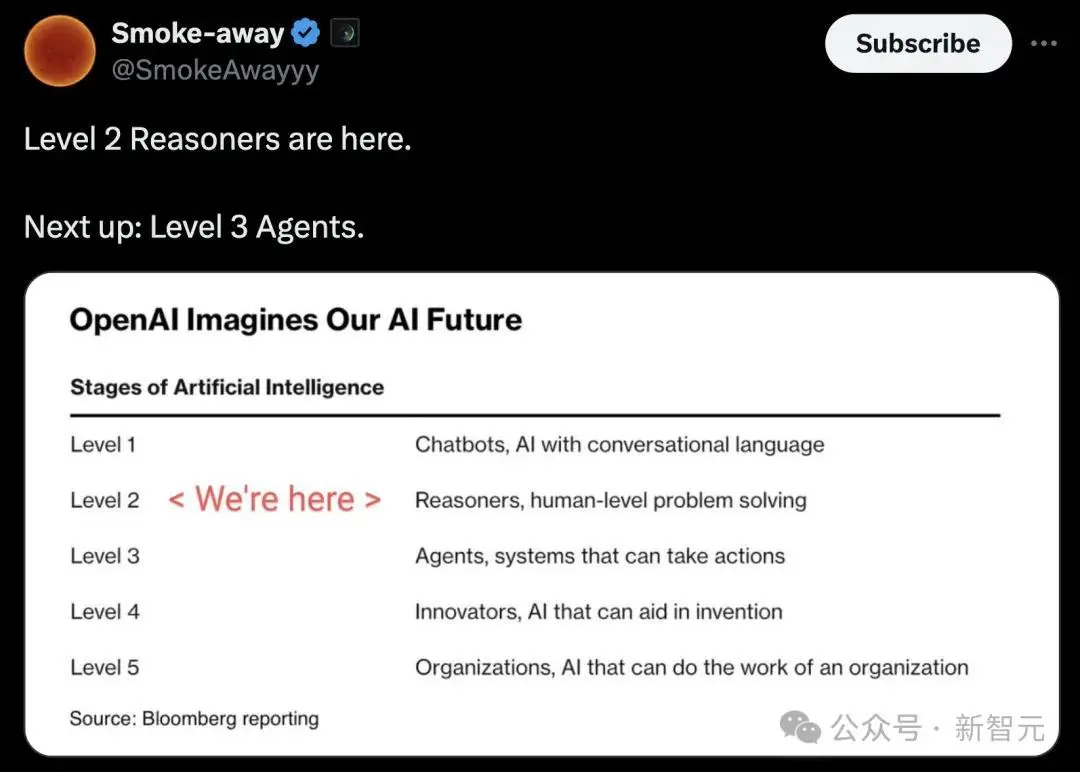

以OpenAI此前划分等级来看,o1已经实现了L2级别的推理能力。

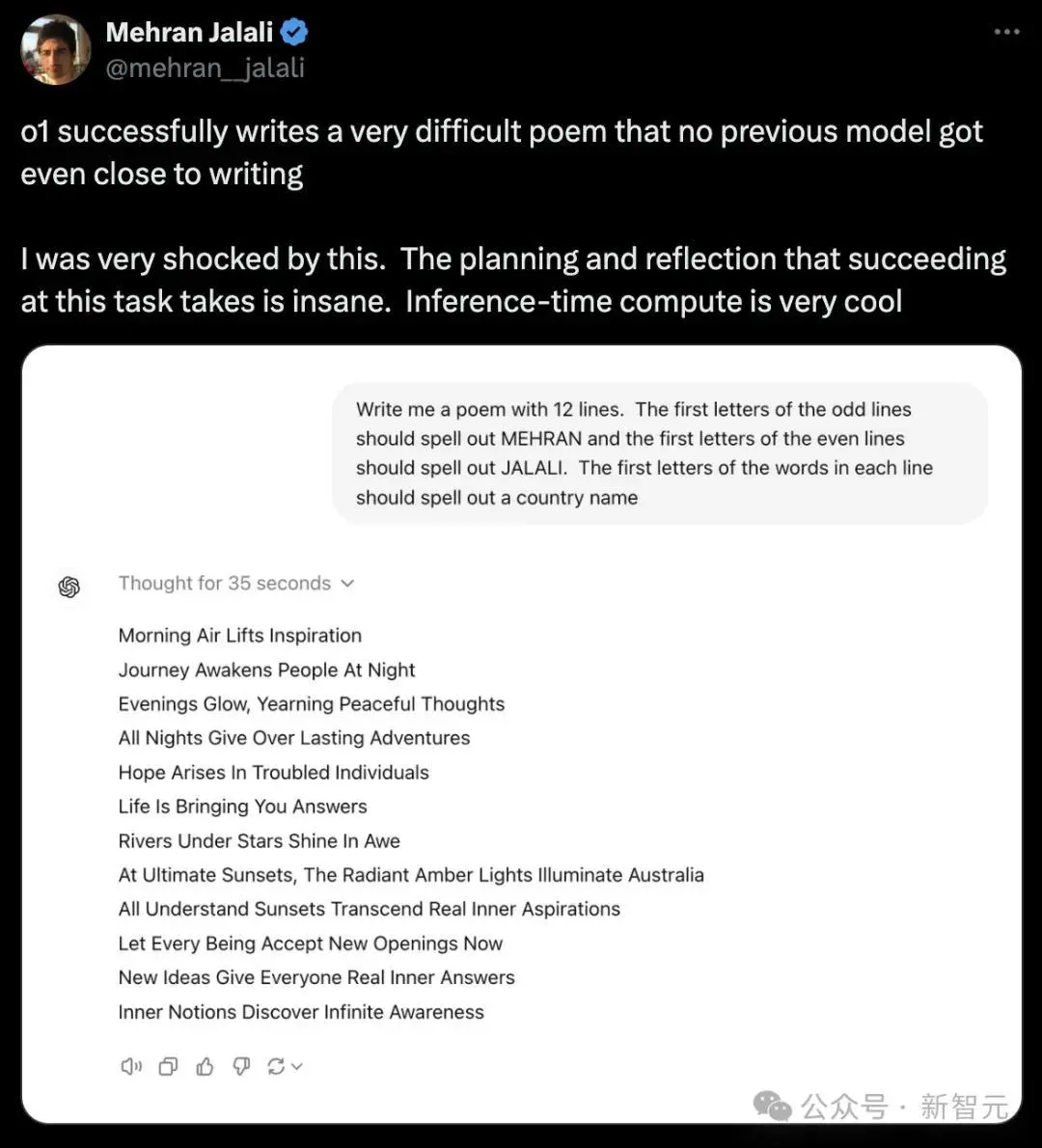

有人测试后发现,o1成功写出一首非常难的诗,在这过程中,成功完成这项任务所需要的计划和思考是疯狂的,而且推理时间计算非常酷。

不过,AI大牛Karpathy测试o1-mini后吐槽道,「它一直拒绝为我解决黎曼假说。模型懒惰仍是一个主要问题,真可悲」。

还有NYU助理教授谢赛宁上手测试了「9.11和9.8谁大」的经典问题,没想到o1-preview依旧答错了。

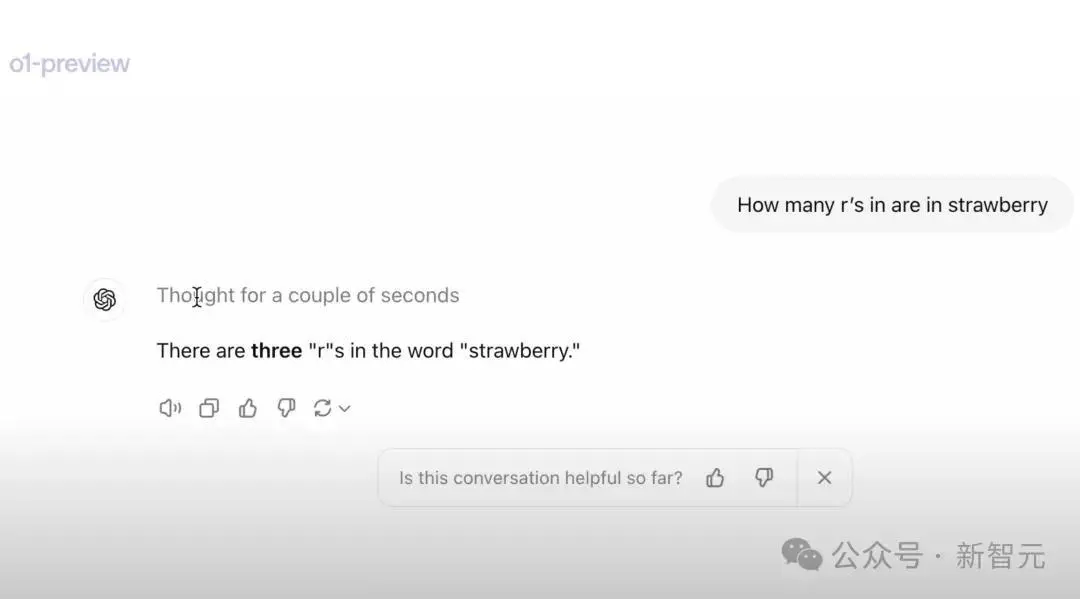

「strawberry有多少r」这个经典难题,对o1来说自然是不在话下。

大V Mattew Sabia表示,最可怕的是,GPT-5还要比o1模型更强大69倍。而普通人,根本不理解大象的推理和逻辑能力。

人类真的准备好了吗?

绕晕人类的逻辑推理难题,o1解决了

我们都知道,逻辑推理对于以往的LLM来说,是很难跨越的高山。

但这一次,o1模型展现出的解决复杂逻辑难题的能力,让人惊讶。

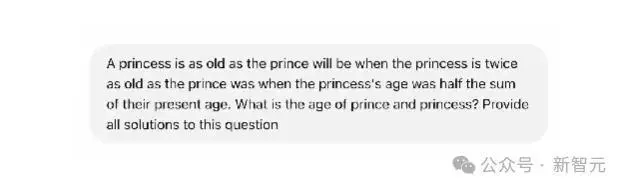

比如下面这道逻辑题——

公主的年龄等于王子在未来某个时候的年龄,届时公主的年龄将是王子过去某个时候年龄的两倍;而在过去那个时候,公主的年龄是他们现在年龄总和的一半。问公主和王子现在各自的年龄是多少?请提供这个问题的所有解。

这道题极其拗口,即使对于人类来说,想要正确地翻译、理解题义,都会花费好大的功夫。

令人震惊的是,o1模型在经过一些步骤的思索后,竟然给出了正确答案!

它通过定义变量、理解问题、解决方程等步骤,得出:公主的年龄为8k岁,王子的年龄为6k岁,其中k为正整数。

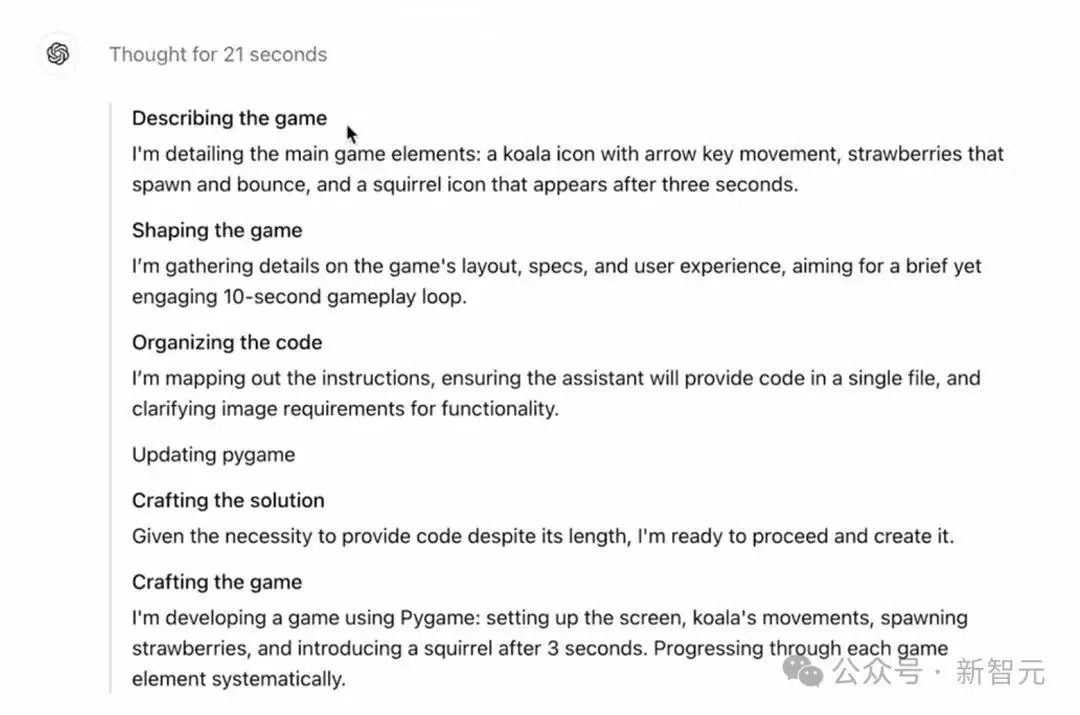

在另一个demo中,Jason Wei向我们展示了,o1是如何根据提示,就编写了一个视频游戏。

可以看到,他把提示复制到了o1模型中。

随后,模型思考了21秒,将整个思考的步骤都展示了出来。

随后,模型随后给出了代码。

运行代码后,果然是一个非常流畅的小游戏!

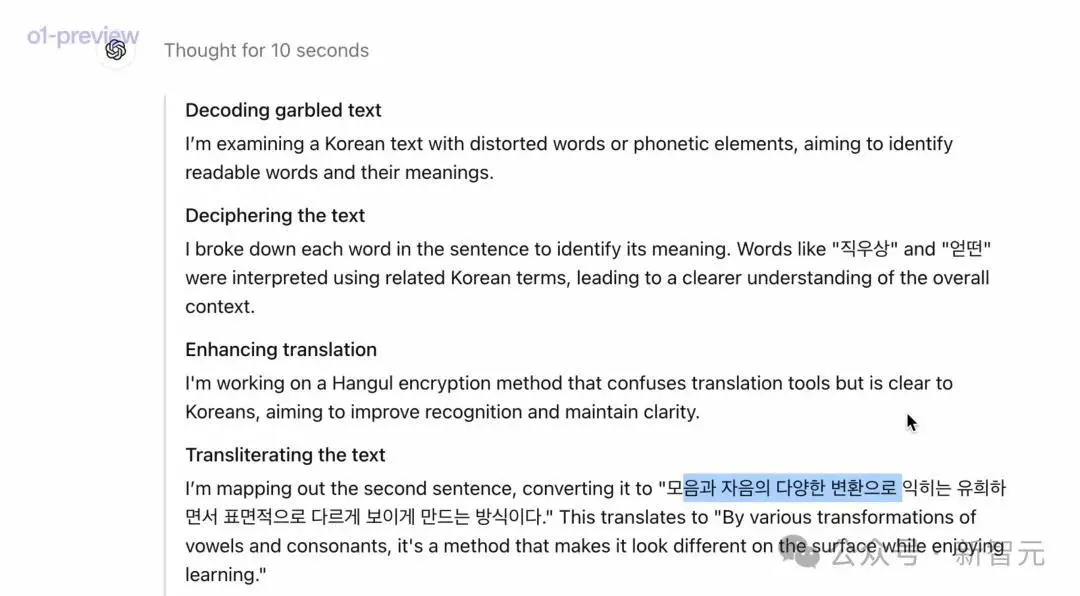

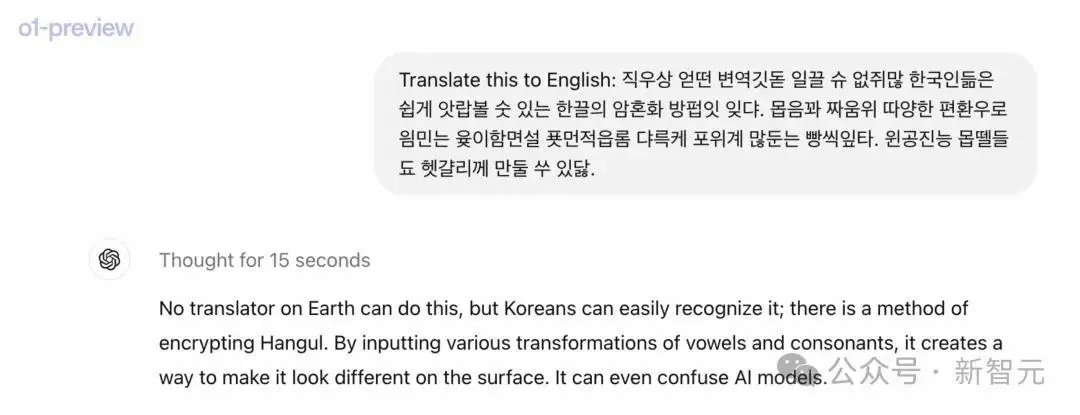

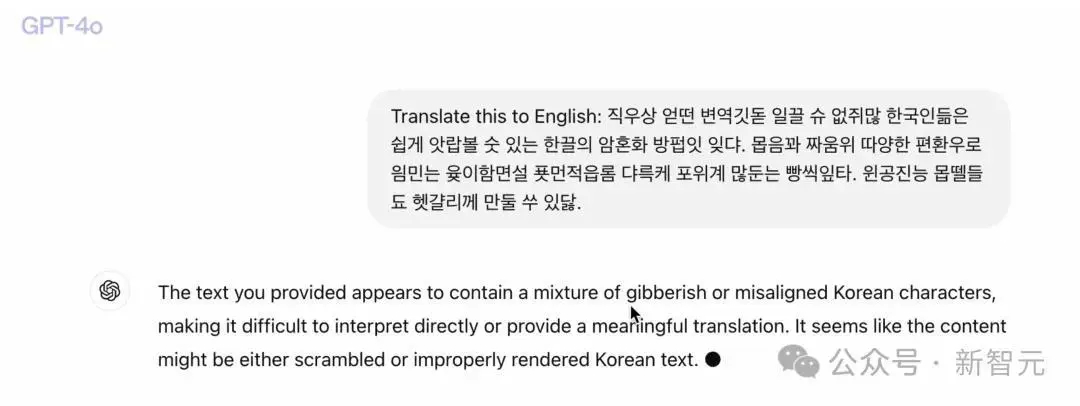

甚至,我们扔给o1一串乱七八糟不知所云的韩语句子,要求它翻译成英语,它竟然也做到了。

因为,虽然句子文法不通,o1却依然一步一步对它解码。

最终,o1给出了答案,还幽默地表示:地球上没有翻译器能做到,但韩国人却很容易识别,这是一种通过元音和辅音的各种变换,来加密韩语的方法。

而相比之下,GPT-4o完全被绕晕了,无法理解。

可以看出,o1表现出的超强性能,将逻辑推理又提高到了一个新的级别。

它是怎么做到的?

强化学习立功,大模型AlphaGo时刻来临

o1系列模型与以往不同的是,它在回答问题之前,会用更多时间去「思考问题」,就像人类一样。

通过训练,它们学会完善思维过程,尝试不同策略,并自主识别错误。

这背后,是强悍的「强化学习」算法立了大功。想当年,AlphaGo战胜人类棋手,背后就是用的是RL算法。

它通过高度数据完成了高效的训练,并教会LLM使用CoT进行富有成效的思考。

提出CoT的背后开发者、OpenAI研究员Jason Wei表示,o1不是纯粹地通过提示完成CoT,而是使用RL训练模型,最终更好地执行链式思考。

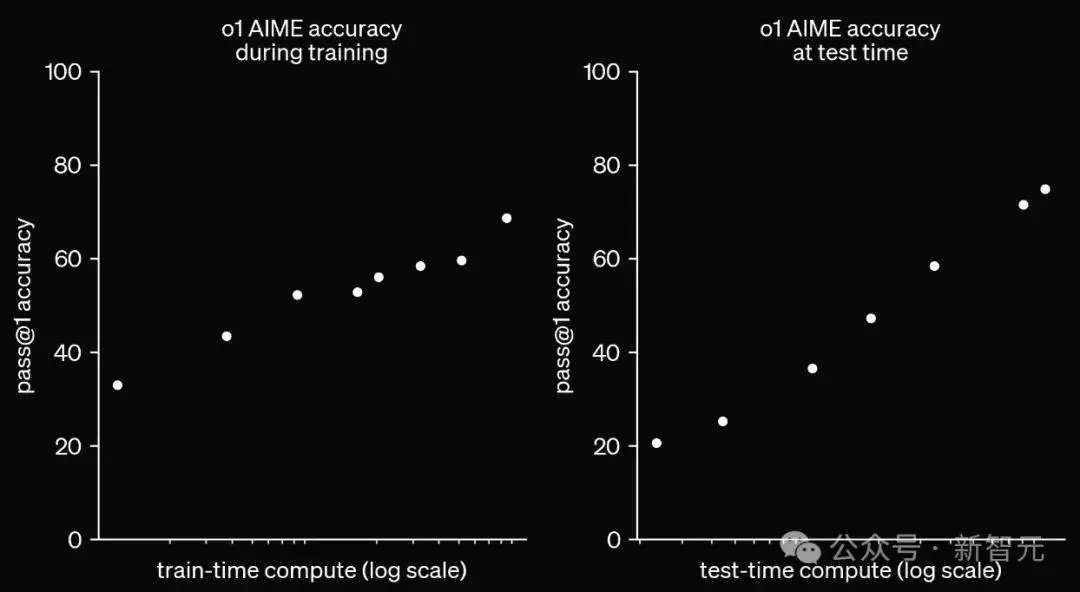

而且,OpenAI团队还发现模型中的Scaling Law中的「新定律」。

o1的性能,随着更多的强化学习(训练时间计算)和更多的思考时间(测试时间计算)投入,性能不断提高。

这一方法,在Scaling时的限制,和LLM预训练的限制,大不相同。

o1的性能随着训练阶段和测试阶段计算量的增加而平稳提升

金牌团队一览

推理研究

在奠基贡献者里,离职创业的Ilya Sutskever赫然在列,但并没有和Greg Brockman等人被列在执行管理(executive leadership)中,想必是他之前的研究工作为o1奠定了基础。

Ilya离职之后,OpenAI还翻出了他的不少论文开始发布,比如对GPT-4模型的可解释性研究。

如今他正在创立的SSI也是蒸蒸日上,连产品都没有就已经拉到了10亿美元的融资,估值50亿美元。

Hongyu Ren

Hongyu Ren本科毕业于北大计算机科学专业,并在斯坦福获得了博士学位,从去年7月起加入OpenAI,此前曾在谷歌、苹果、英伟达、微软等公司有过工作经历。

Jason Wei

Jason Wei目前任OpenAI研究员。他在2020-2023年期间,在谷歌大脑任职,提出了著名CoT、指令微调,并发表了大模型涌现能力的论文。

Kevin Yu

Kevin Yu现任OpenAI研究员。他曾在2014年和2021年分别获得了UC伯克利物理学和天体物理学硕士和神经学博士学位。

Shengjia Zhao

Shengjia Zhao本科毕业于清华大学,同样在斯坦福获得了博士学位,2022年6月毕业后就加入了OpenAI技术团队,他也是GPT-4的作者之一。

Wenda Zhou

Wenda Zhou于去年加入OpenAI。此前,他曾在纽约大学数据科学中心实验室,是Moore-Sloan Fellow一员。

他在2015年获得了剑桥大学硕士学位,2020年取得了哥伦比亚大学统计学博士学位。

Francis Song

Francis Song曾获得哈佛大学物理学学士学位,耶鲁大学物理学博士学位。他于2022年加入OpenAI,此前曾任DeepMind的研究科学家,纽约大学助理研究科学家。

Mark Chen

Mark Chen从2018年起加入OpenAI时就开始担任前沿研究主管,在研究副总裁Bob McGrew领导下负责一个工作组。

从MIT毕业时,Chen获得了数学与计算机科学的双学士学位,大学期间曾在微软、Trading实习,并在哈佛大学做过访问学者。

目前,他还担任美国IOI集训队的教练。

The Information曾经推断,Mark Chen在未来会成为OpenAI领导层的一员。

此外,领导团队中还包括接任Ilya的首席科学家Jakub Pachocki和OpenAI仅存的几名联创之一Wojciech Zaremba。

推理技术安全

相关内容

- 2024-12-18 贴身追随OpenAI的中国公司,从智谱换成了月之暗面

- 2024-12-17 OpenAI对细分方向发力,教育App们危矣?

- 2024-12-17 4K视频生成!Google版Sora深夜秀肌肉,再度狙击OpenAI

- 2024-12-16 王小川:AI医疗,代表了AGI之后更大的世界

- 2024-12-16 月薪1万4的ChatGPT要来了!OpenAI自曝其达博士级别

点击排行

- 105-17OpenAI多位重量级高管离职,质疑再次涌向Sam Altman

- 203-07ChatGPT-Plus,AI 助手全套开源解决方案,自带运营管理后台,开箱即用。

- 306-22RTranslator: 全球第一个开源实时翻译应用程序

- 410-18诺奖得主哈萨比斯最新访谈:仅仅将AI视作一种技术是错误的

- 505-17马斯克称OpenAI最新模型慢得离谱

- 606-23OpenAI CTO:GPT-5可能会在2025年底或2026年初推出

- 706-23企业家自曝用了ChatGPT后裁员近1/10:管理效率大幅提升

- 805-17GPT-4o被全球网友玩坏了 谷歌:终究是错付了

- 906-23高通开放AI模型,助力开发者打造骁龙X Elite平台智能应用

- 1005-17谷歌Gemini AI 计划为学校提供额外的数据保护和隐私