谷歌工程师2018年内部信曝光,5年前就有人拉响AI警报了

2023 年 2 月,谷歌 CEO 桑达尔・皮查伊(Sundar・Pichai)对内发布了一份「红色代码」预警,要求谷歌旗下用户超 10 亿的产品尽快接入生成式 AI,以对抗来势汹汹的 ChatGPT。

这一举动给人一种谷歌「慌了」的感觉,因为 ChatGPT 的到来已经威胁到了谷歌核心的搜索业务:如果大家都习惯用 ChatGPT 这类 AI 对话引擎直接得到答案,谁还会去谷歌搜索呢?谁还会去谷歌投广告呢?

乍看起来,这一切都发生地非常突然,谷歌应对起来也很被动。但其实,早在 2018 年,谷歌内部就已经有工程师拉响了警报,指出 AI 正在对谷歌的业务带来风险,尤其是网页搜索。

众所周知,谷歌借助用户交互数据对搜索结果进行排名。通过观察用户与搜索结果页面的交互方式(点击结果、后退、点击其他内容),谷歌能够知道哪些页面与特定查询最相关。多年来,这帮助谷歌保持了搜索相关性的领先地位,因为它比其他任何搜索引擎都拥有更多的用户交互数据。

但在 2018 年底,谷歌的工程师们突然意识到一个惊人的问题:复杂的语言模型最终将能够仅通过网页文本理解网页,而无需任何用户反馈。而这可能会危及谷歌在搜索领域长达 20 年的优势,这种威胁甚至可能来自一家小型初创公司。

谷歌资深软件工程师 Eric Lehman 就是早早意识到这一问题的工程师之一。为了表达自己的这份担忧,他还专门写了一份邮件:

我想写写我在假期期间思考的一个问题:

在不远的将来,深度机器学习系统将明显优于谷歌 20 年来积累的网页搜索相关性算法。

此处我所讨论的仅限于「相关性」—— 即判断一个文档与一个查询讨论的是否为同一主题。网页排名还涉及许多其他方面,在这些方面,机器学习似乎不那么适用。但我认为,基本的相关性是网页排名的核心任务,足够「客观」,可以很有效地使用 ML。

没有人能预见未来,但我敢打赌,这几乎肯定会在 5 年内成为现实,甚至可能在 6 个月内成为现实。类似于网页排名的问题一个接一个被解决,几乎没有理由认为网页排名会是个例外。实际上,这个问题思考的出发点是源于 AI 最近在网络问答方面取得的进展,深度 ML(具体来说是 BERT)突然取代了之前几乎所有的工作。

对于网页问答团队来说,过去几周深度 ML 带来的巨变是完全出乎意料的。有了这次预警,我们不应再被意外打败;相反,我们应该从现在开始考虑其后果。而且,「现在」正是时候,因为我预计在新的一年里,很多网页排名工程师将会反思 BERT,并开始沿着这些相同的线路思考。

一个需要考虑的事实是,这样的深度 ML 系统可能会在谷歌之外的地方被开发出来 —— 比如在微软、百度、Yandex、亚马逊、苹果…… 甚至是一个创业公司。在我的印象中,翻译团队已经有过这种经历。深度 ML 彻底改变了翻译领域;过去的优势被一扫而空。幸运的是,谷歌在深度 ML 上的巨大投资得到了回报,我们在这个新领域表现出色。然而,我们的新 ML 翻译器在基准测试中仍然被一家小型创业公司超越。

我们可以从 BERT 中得出一个惊人的结论:大量的用户反馈在很大程度上可以被原始文本的无监督学习所取代。这可能会对谷歌产生重大影响,导致谷歌在相关性方面输给其他公司。

网络搜索中的相关性可能不会很快被深度 ML 所颠覆,因为我们依赖的记忆系统远大于任何当前的 ML 模型,并且包含了大量关于语言和世界的重要知识。此外还有许多性能挑战和特殊考虑等。尽管如此,我认为我们当前方法的优势最终会消失;ML 正在迅速进步,而传统技术则不然。

我不知道其他人怎么看。个人而言,我倾向于认为这个未来几乎是不可避免的,但我还没有深入思考其后果。我们可能需要思考的一些问题包括:

我们能不能现在就采取措施,确保自己引领这一变革,而不是成为变革的牺牲品?就我个人而言,我不想在未来几年,人们回顾时认为,「那些坚守传统网页排名方法的人被新潮流碾压,而他们却毫无预警……」我们能否制定一个 2019 年的合作目标,结合研究力量,利用深度模型击败我们现有的最佳预测呢?

我们如何在不打击士气的情况下与从事网页排名工作的人讨论这个可能的未来?

我听说翻译团队几年前就决定「all in」大规模 ML,现在回想起来,这似乎是明智之举。今天,我对围绕相关性采取如此极端的措施持怀疑态度,因为从现在到深度 ML 方法真正占据主导地位的这段时间里,我们可能会牺牲传统方法所取得的重大成果 —— 我认为这至少还需要几年的时间。然而,听到 BERT 的警示而不调整我们的计划似乎也是不明智的。

在谷歌内部,Eric Lehman 可能不是唯一发现并指出这一问题的人。在此之后,谷歌也确实采取了一些做法来更新自己的搜索系统。比如,在 2019 年 10 月,谷歌正式宣布,他们的搜索引擎用上了 BERT,能够改善 10% 的搜索结果。一年后,谷歌又宣布,几乎所有的英文搜索都用上 BERT 了。

不过,在之后的两三年里,谷歌并没有采取更激进的措施,比如直接做一个基于大型语言模型的搜索系统,直接给用户答案。这就给很多创业公司提供了机会,比如 AI 驱动的搜索引擎 perplexity。

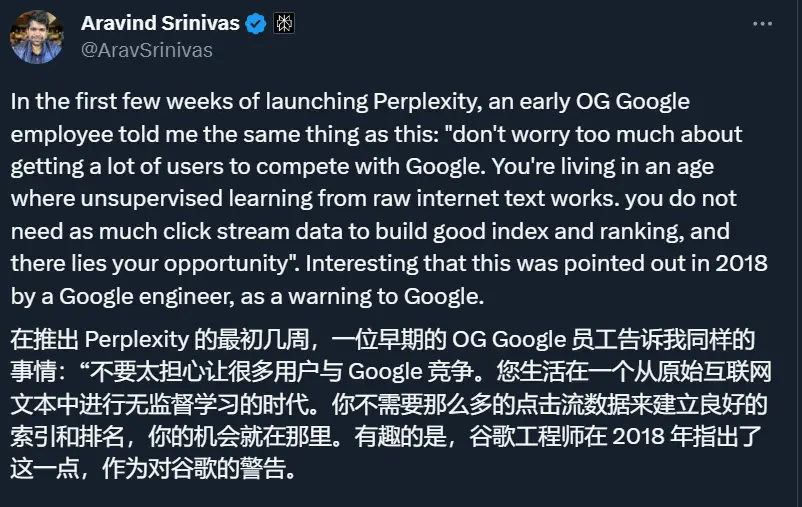

这家公司的 CEO 表示,在推出 perplexity 的最初几周,一位谷歌老员工就对他说过,「不用太担心吸引大量用户来与谷歌竞争。你生活在一个可以从原始网络文本中进行无监督学习的时代。你并不需要那么多点击流数据就能构建出好的索引和排名系统,这就是你的机会。」

那么,谷歌为什么没有再接再厉,及早推出基于大型语言模型的搜索系统呢?有人分析出了谷歌当时的几个顾虑:

会对依赖蓝色链接(即传统搜索结果链接)流量的生态系统造成太大伤害:谷歌搜索的一个主要功能是将用户引导到其他网站,而采用 LLM 答案系统可能会直接提供答案而非链接,这样会减少引导到外部网站的流量,对依赖这种流量的网站造成影响。

即使谷歌决定因为竞争对手的压力而接受这种变化,监管机构可能也不会同意。从监管的角度看,直接提供答案而减少对其他网站链接的引用可能会引起关于市场垄断和竞争公平性的担忧。

即使在美国,监管机构可能不采取行动,这种威胁本身也是令人瘫痪的:这意味着,即便没有实际的监管干预,仅仅是存在这种可能性和随之而来的法律和公众压力,就足以使谷歌在采取这种策略方面犹豫不决。

在 ChatGPT 走红之初,Meta 首席人工智能科学家 Yann LeCun 也表达过类似想法,表示大公司确实更难以推动这种大的革新,因为他们面临的公众、监管压力要更大。

后面的故事走向大家都很熟悉了:除了像 perplexity 这样的搜索新秀,谷歌还要应对来自微软的威胁,后者通过与 OpenAI 合作,将自己的搜索引擎彻底重构,打造了新必应。

不过,在过去的一年里,微软的新搜索业务并没有对谷歌形成真正的威胁。根据美国网站流量统计服务商 Statcounter 公布的统计数据,2023 年 2 月 Bing 在全球市场的份额是 3.03%,在一年时间过去后,其市场份额仅仅只是达到了 3.4%。这可能和新必应使用体验不佳、提示工程门槛较高等因素有关。与此同时,基于最新的 Gemini Ultra 模型,谷歌对于搜索引擎的重构步伐也在加快。看起来,虽然行动慢了一些,谷歌搜索的地位暂时还无人可以撼动。

相关内容

- 2024-11-22 第一批用AI的外贸人已经赢麻了

- 2024-11-21 谷歌前CEO改口称美国ai落后中国了

- 2024-11-19 阿里海外,要靠AI打响效率之战

- 2024-11-18 谷歌前CEO:AI性能将继续高速增长,潜在威胁不容忽视

- 2024-11-15 腾讯的AI困局

点击排行

- 105-17OpenAI多位重量级高管离职,质疑再次涌向Sam Altman

- 206-22RTranslator: 全球第一个开源实时翻译应用程序

- 303-07ChatGPT-Plus,AI 助手全套开源解决方案,自带运营管理后台,开箱即用。

- 410-18诺奖得主哈萨比斯最新访谈:仅仅将AI视作一种技术是错误的

- 505-17马斯克称OpenAI最新模型慢得离谱

- 606-23OpenAI CTO:GPT-5可能会在2025年底或2026年初推出

- 706-23企业家自曝用了ChatGPT后裁员近1/10:管理效率大幅提升

- 805-17GPT-4o被全球网友玩坏了 谷歌:终究是错付了

- 905-17谷歌Gemini AI 计划为学校提供额外的数据保护和隐私

- 1006-23高通开放AI模型,助力开发者打造骁龙X Elite平台智能应用