去年股价跌去四分之三的meta 元宇宙的故事才刚刚开始

在各种 AI 新闻满天飞的 2023 年,大家还记得大明湖畔的元宇宙吗?

至少从大伙们讨论度上来看。。。是有点凉透了的意思。

最近一次上热搜,也只剩林俊杰元宇宙血亏 90% 这类的被套牢新闻。

而其中,曾扯着嗓子高调梭哈,甚至不惜押上了姓名的 Meta ,更成了大伙们的笑料。

先是去年 10 月份股价一度较最高点跌去 75% 。

而后今年在其他科技大厂大模型满天飞, AI 发布会都快开了一轮的情况下。

这个 Meta ,好像除了裁员,还是裁员。

“ 呦 ~ 扎哥你是不是因为搞元宇宙又裁员了。 ”

“ 随后什么降本增效啊,为社会输送人才啊,一句句冒了出来,到处充满了欢声笑语。 ”

就连隔壁部门的同事,都玩着类似的梗。。。并问着差评君,Meta 在AI 时代咋掉队了?他们还元得下去不?

不过,笑归笑,闹归闹,咱还真别拿 Meta 的人工智能开玩笑。

差评君在这儿,直接给大家先省个流,那就是 Meta 在 AI 领域,还真不是大家眼中的软蛋。

并且给个暴论啊( 不构成投资建议),他们离自己的元宇宙目标可能还更近了。

这么说吧,虽然 Meta 官方在大模型的声量和宣传上,确实没别家高,但 Meta 的人工智能技术,在世界范围内,还真没有谁能说它不行。

深度学习框架这个东西大家晓得伐?

这个东西是用来方便开发训练深度学习模型的,相当于 AI 界的操作系统。

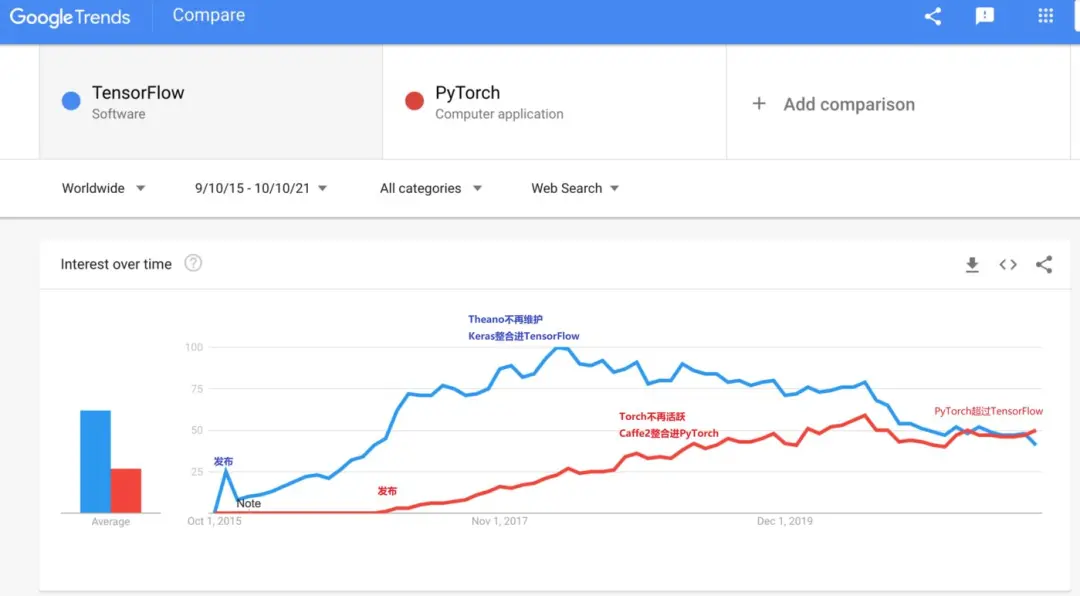

在 17 、 18 年这会儿,市场上占据最多使用率的,还是人谷歌大名鼎鼎的 TensorFlow 。

这个时候的 TensorFlow 可以说是眼中毫无对手,毕竟 15 年发家,大量人力维护更新,自开源后就把市场上的其它深度学习框架挤得没有生存空间了。

可没想到,谷歌这好日子过了还没多久,半路突然杀出来一个程咬金, Pytorch 发布了,这个由当时还叫 Facebook 的公司主导开发的深度学习框架,从易用性着手,自发布之后,用户一路走高。

并在 19 年逆袭谷歌,成为目前最受欢迎的深度学习框架。

但好汉总不能只提当年勇,如今大火大语言模型,Meta 其实也不拉,只是人家没有专门开发布会发布而已。

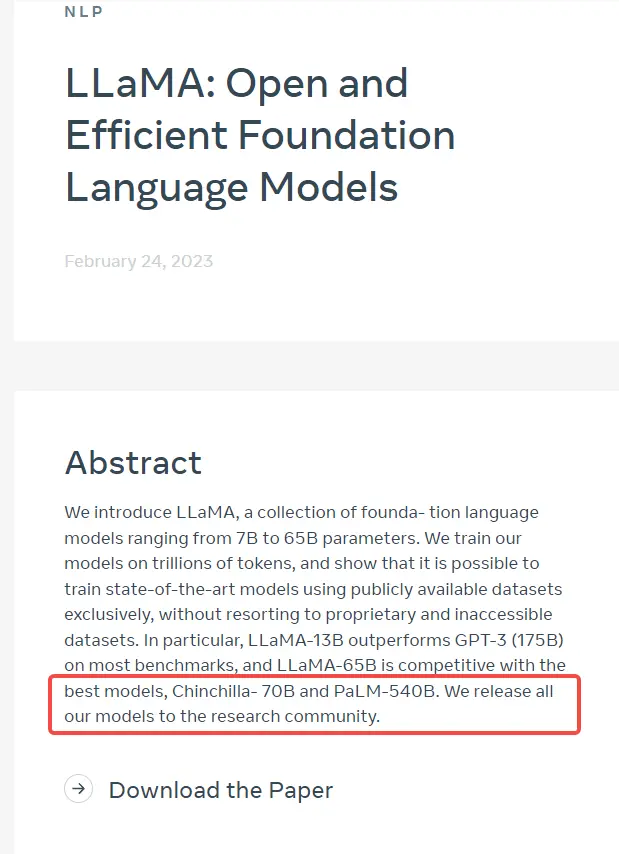

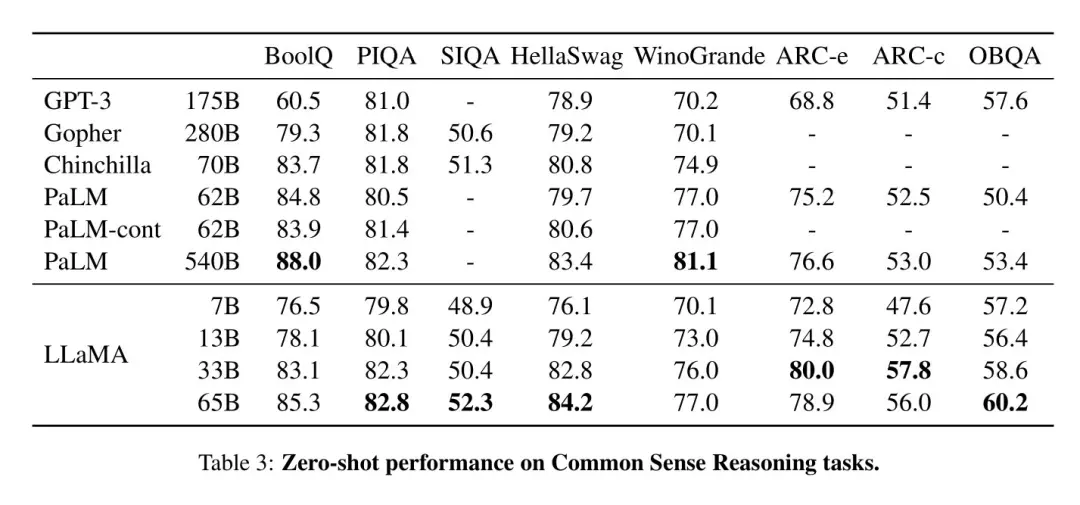

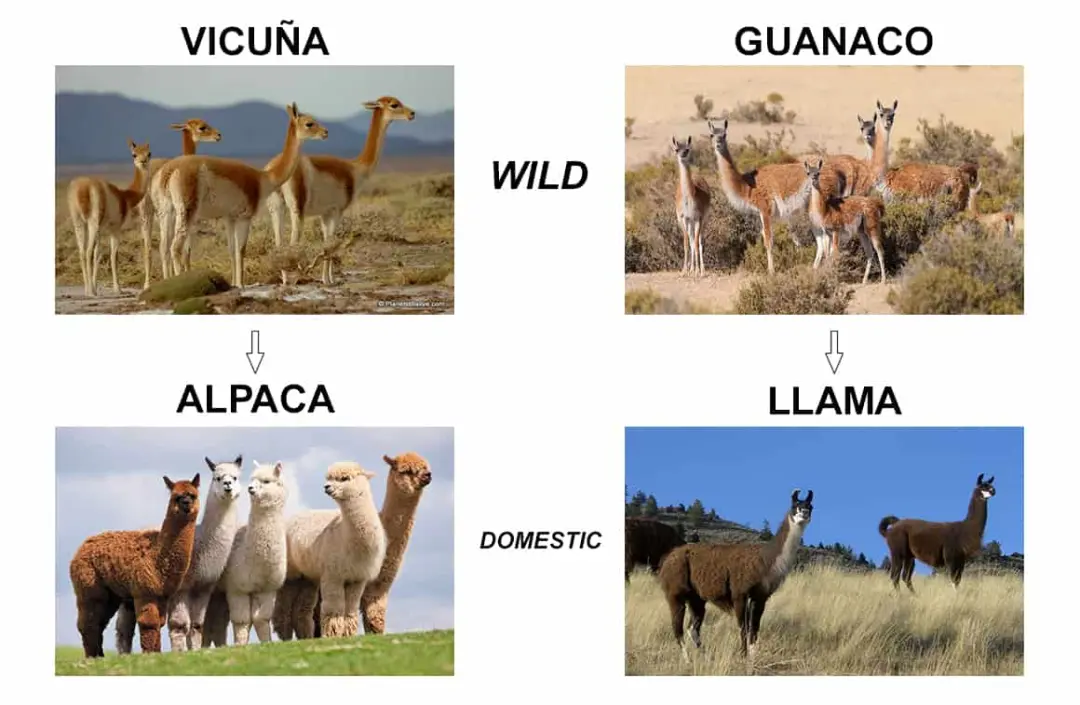

它们家的大语言模型 LLaMA ,也就是羊驼( 或者翻译成:草泥马 ),在圈儿内的名声,完全不输 GPT 。

本来呢,这个模型是只释放给一些科研机构用作研究用的,结果,不知道哪个小崽子,脑子一热,就给公开到网上去了。

好家伙,不公开不要紧,这一公开,各种各样复刻 ChatGPT 的项目就来了。

什么斯坦福的羊驼只要 100 美元就能比肩 GPT3.5 啊。。。

又是什么 UC 伯克利的 “ 小羊驼 ”130 亿参数平替 ChatGPT 啊。

感觉是个人就能出大语言模型的样子。。。

而且,据他们测试,这个 LLaMA 在很多项的能力比拼下,是优于 GPT-3 的。。。

到现在,这个模型已经在各大机构大佬的努力劳作下,开枝散叶,诞生了一批 “ 羊驼家族 ” 了。。。

甚至可以说现在的学术圈和开源社区,已经是一只只草泥马的形状了。

在另一个人工智能领域, CV ( 计算机视觉 )圈, Meta 的动静可就更大了。

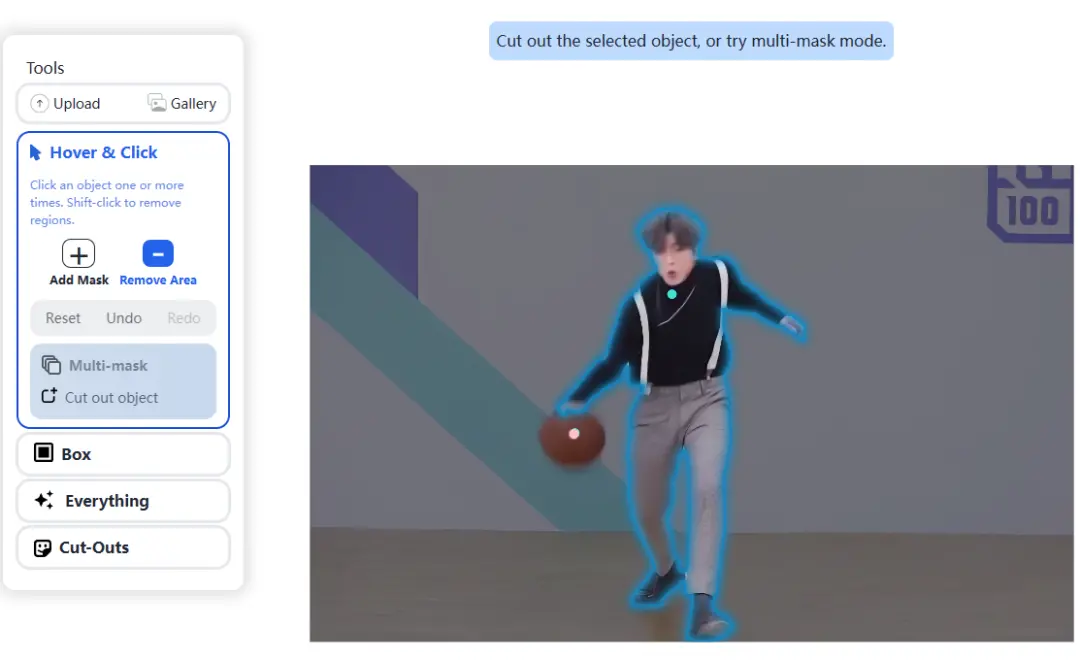

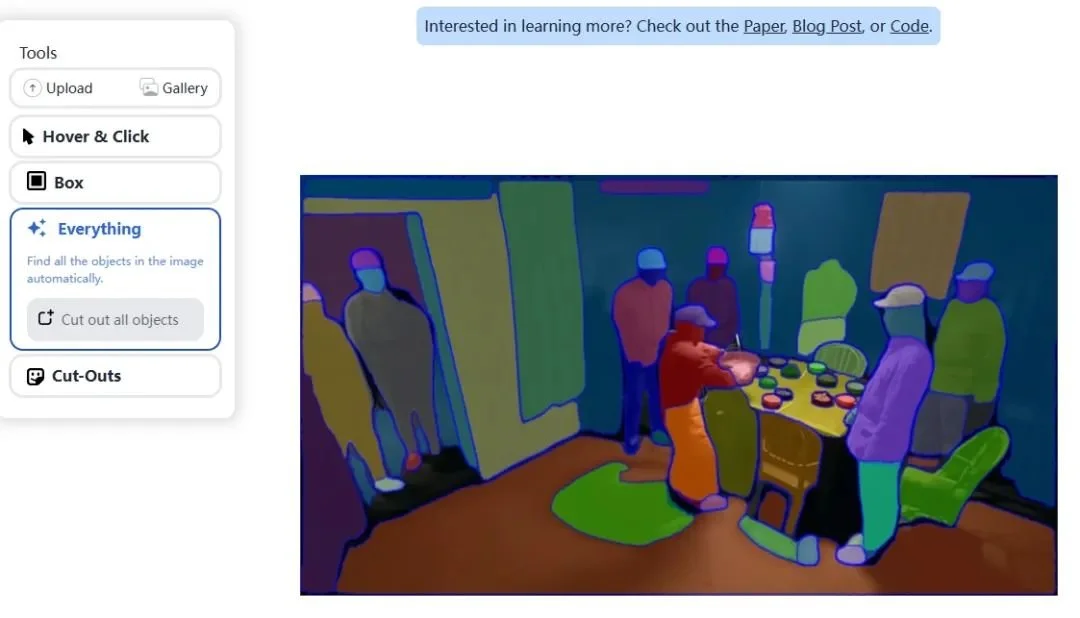

4 月 5 号, Meta 就发布了一个用于图像分割的 AI 大模型:Segment Anything Model 。

就和它的名字一样,这个模型可以识别图像和视频中的物体,并且一键剪切任何图像中的任何对象。

在官网的演示中,比如这张男子打篮球的图片,只需要给图片中的物体标一个点,就能自动切割出咱们想要的主体。

甚至,如果有一些图片过于复杂,你自己都懒得去点标记的话,你还可以把分割的任务全权交给 SAM ,直接点击 Everthing ,它就自动帮你把图片中的可分割物体切割出来。

整个过程方便简单快捷。

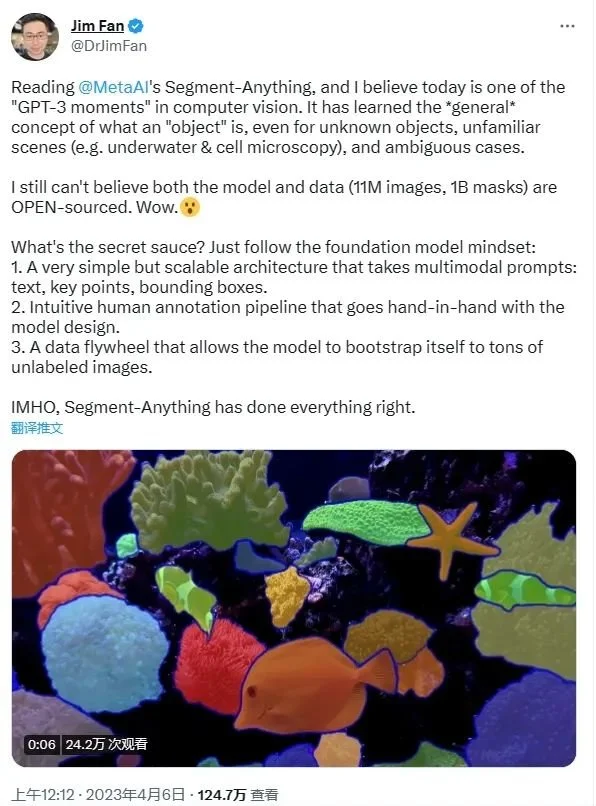

所以,这个模型一经推出,众多 CV 界师生纷纷大喊:CV 不存在了。

原因就是他把现在 CV 比较热门的方向,比如目标检测,图像分类,物体分割等等,差不多都解决得很好了。

英伟达的人工智能科学家 Jim Fan ,甚至还把 SAM 的出现比喻成 CV 界的 “GPT-3 时刻 ” ,可见各位业内人士对 SAM 的认可了。

但,这还不是结束,仅仅就在几天前。

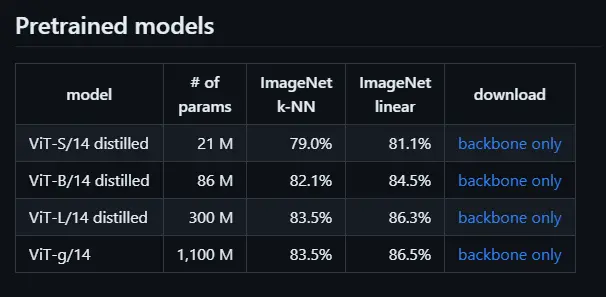

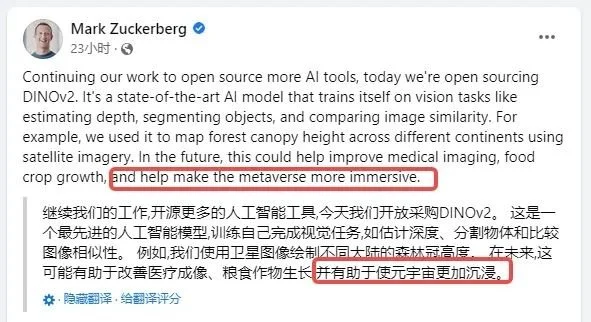

咱们的扎哥又亲自通过脸书,宣布开源了另一个重磅模型, DINO V2 。

同样的也是 CV 方向,但这个 DINO V2 可不仅仅只能对图像进行识别、分类、分割了。

它还能通过一张二维的图片,去估计场景的三维深度,比如下图右边的灰度图,就是通过左边的场景估算生成的。

深度图记录了整个场景的深度信息,有了这个深度信息,你甚至能从一张平面的图像中,建模出一个 3 维的场景。

另外, DINO V2 的图像特征提取功能 + 语义分割,更是把以图搜图的能力抬到了另外一个台阶。

以往的以图搜图,只能搜索相似的画面。

但是加上了特征提取和语义分割之后,你不仅能搜索到相似的图片,还能以单个图像特征为条件,搜索不同风格的图片。

只要是 CV 类的任务,这个 DINO V2 基本都能作为任务的主干去完成。

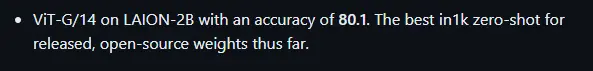

而且,从官方提供的四个预训练模型来看,这四个面模型,参数最高的一个, ImageNet Linear 精度最大达到了 86.5% 。

在之前,同领域表现最好的 OpenClip ,其所预训练出来的模型,表现最好的精度也只有 80.1%

不管是 Pytorch 、 LLaMA 、 SAM ,还是 DINO V2 ,上面的这些成果,其实大都来自 Meta 的两个专攻 AI 的实验室。

其中一个是 Facebook ’ s Artificial Intelligence Research ,简称 FAIR ,主攻研发,另一个则是 Applied Machine Learning ,主攻应用落地。

而且他们的研究基本全部开源, 在测试可用后,你都能在开源网站上找到项目的源码。

所以说,Meta 不但没有在 AI 时代掉队,反而已经属于靠前的梯队。

那么说了这么多,它们和小扎一直挂在嘴边的元宇宙,有啥毛线关系呢?

其实早在 16 年的开发者大会上,小扎就给出了在公司未来的发展方向上,给出了三步走的计划。

第一步,先要连接世界,这个就是扎哥的老本行了,社交网络。

第二步,以人工智能为核心,打造连接世界的技术核心,这也是它们从好几年前一直做的事情。

而第三步的 VR 和 AR 嘛。。。要放到现在,翻译翻译,这还是元宇宙。。。

所以说发展 AI,早在小扎的小本本上。

咱们也回头看看一下之前 Meta 那些无论是大模型、还是计算机视觉的开源项目,在某种程度上,其实都是在降低 AI 使用的门槛。

而 AI 的发展,又能推动元宇宙的建设。

可以细品一下几天前,小扎在发布 DINO V2 时脸书上写的这么一句话:

“ 在未来,这可能有助于改善医疗成像、粮食作物生长,并有助于使元宇宙更加沉浸。 ”

说白了小扎在 “ 元宇宙 ” 的路上不仅没自认折戟,反而可能更加自信了。

而随着 AI 技术的持续发展,特别是 AIGC 的普及,各种AI建模,AI绘图,AI音乐等工具的出现。。。

说不定真能让元宇宙里的内容越来越多,越来越逼真。

反正在使用过了不少大语言模型,被无数以假乱真的AI图震撼过之后。。。。

元宇宙这个不久前还那么缥缈的概念,在 AI 的助力下,好像也没那么的玄了。

相关内容

- 2024-08-19 元宇宙泡沫破灭?以下是几个“数据真相”

- 2024-08-14 苹果AR眼镜或对标Meta,将通过AI大模型加持的语音助理进行互动

- 2024-07-19 Meta削减AR/VR/元宇宙团队20%开支

- 2024-07-03 苹果Vision Pro头显新专利探索“头控”方案:可调音量、亮度等

- 2024-06-30 快手Vision Pro版国内首批上线,支持沉浸式刷视频

点击排行

- 105-04Project Galaxy的银河女孩NFT今晚(5.4晚8:00)空投

- 204-302022年按市值划分的5大NFT项目

- 303-19手把手教你验证brightid

- 404-30这届NFT,已经盯上月球了

- 503-202023年值得关注的五大AI 代币

- 604-18X-to-earn 新模式:骑行也能赚钱?

- 704-172022年20个最佳NFT项目(加上即将到来的NFT)

- 805-18数藏团队跑路通告,这算有良心吗?

- 910-21Aptos 代币在“早期网络参与者”的 APT 空投后暴跌 40%

- 1003-17birghtID 10k庆典NFT领取