数据说话:“AI吞金兽”正在威胁互联网大厂_tiknovel-最新最全的nft,web3,AI技术资讯技术社区

数据说话:“AI吞金兽”正在威胁互联网大厂

一个服务于1000万日活跃用户数的通用大模型,至少需要年收入100亿元才可能保持收支平衡,如果未来能服务1亿日活用户呢?10亿日活用户呢?

每增加一个AI大模型用户,公司付出的边际成本远高于电商、社交、短视频等领域的单位拉新成本。这些是业内流传的一组数据,说明人工智能的训练和推理成本对一家公司的现金流是极大的考验。

AI到底有多费钱?即便有上述这组数字,我们也缺乏一种直观印象。眼看新一轮财报季来临,各大厂又将不约而同地展示AI贡献、宣布增加AI投入。下面就从谷歌、Meta、阿里巴巴、微软、亚马逊等大型科技企业的财报中收集详细数据,来分析大厂对AI持续投入是一个怎样的场面,是否投入越多就越能在下一个互联网周期到来时傲视群雄?

学会看“资本性支出”

谷歌母公司Alphabet首席财务官Ruth Porat近期透露,预计公司在2024年的资本性支出(CapEx)将比2023年有显著性增加(notably larger than 2023),尤其是对AI芯片的投入上。该公司也在2023年报中说,未来将继续加大资本性开支,以支持长期的AI布局。该公司此前对2024年的资本性支出预期范围是300亿至370亿美元,后来把指引提升到350亿至400亿美元。

上面表格是根据Alphabet历年年报罗列的资本性支出和对应的现金流情况。从2022年开始,资本性支出呈现显著增加趋势,但经营活动现金流净额,以及年末的现金及现金等价物的增长并不明显。单从数字看,公司每年资本性支出大约占到经营现金流的三分之一,而经营现金流减去资本性支出后,就是自由现金流。

我们为什么把资本性支出视为衡量这类公司在AI、云计算等基础设施服务上的投入程度呢?

所谓资本性支出,简单说就是这些钱不是花在当季的,要相应地摊销/折旧到以后的每个会计年度,它不像营销费用、股权激励这些开销,它是为以后长期带来收益的一种投入,比如传统企业扩建厂房、购置设备等大件开销。对于互联网公司有所不同,比如Alphabet在年报中解释资本性支出主要针对服务器、网络设备、数据中心等技术基础设施。2022年后AI浪潮严重左右了这些公司在技术基建上投入的方向,这从“所有App都值得用AI重新做一遍”“AI将在未来几年为公司带来数百亿美元收入”的高管表态中也有所体现。因此把AI相关成本与科技企业的资本性支出做强关联,是比较合理的。业务层面上,AI也离不开云。

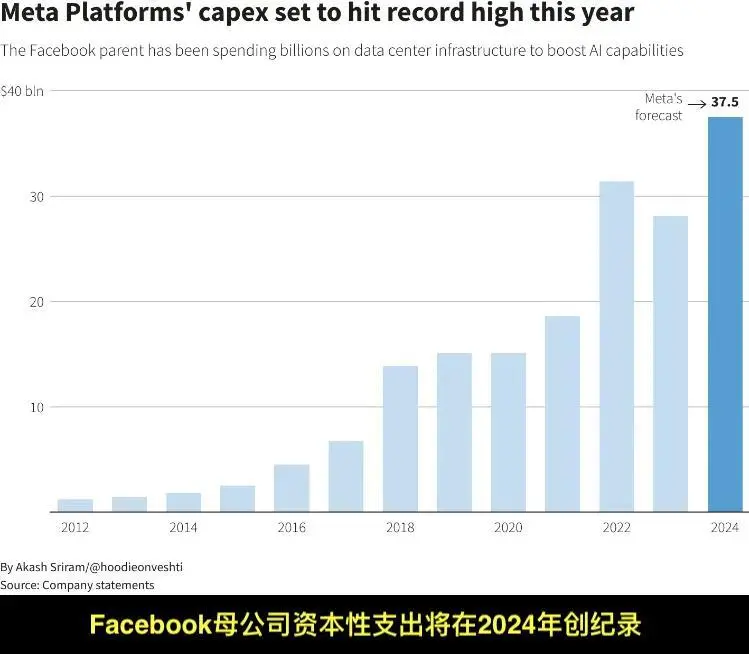

事实上,与2022年之前相比,2022年后这类公司在资本性支出上明显大幅增加,甚至翻倍,这在往年并不常见。而在这一场围绕AI的技术军备竞赛中,这个趋势仍在持续加剧。除了Alphabet,我们也在微软、Facebook母公司Meta、阿里巴巴等大公司年报中看到这种趋势。

相比,亚马逊最近几年的资本性支出相对稳定,2020年至2023年依次为350亿美元、554亿美元、583亿美元和481亿美元。亚马逊在AI领域目前主要采用自研芯片(训练和推理)+入股外部AI公司(如前后两次共计40亿美元入股Anthropic,并购资金不计入资本性支出)的策略;而且与轻资产的微软和Meta相比,亚马逊资本性支出中包含了重资产的仓储物流这一影响因素。

而阿里巴巴的相关数据有一些特殊性。其2020财年至2023年财年的资本性支出依次为326亿元、415亿元、533亿元和343亿元,主要包括云计算数据中心、物流基础设施、购置园区的在建工程与土地使用权,以及前些年热衷的新零售基建。尤其是前两年阿里北京总部和全球总部园区建设,使得在建工程与土地使用权这一单项的资本性开支在2020财年、2021财年和2022财年分别达到79亿元、53亿元和113亿元,如果剔除这个因素,并考虑到近两年缩减了新零售基建投入,公司实际花在云与AI上的资本性支出也呈现增长趋势。

总之,由于AI大模型持续高昂的训练和推理成本,以及英伟达GPU芯片价格的水涨船高,使得云计算大厂在这个新赛道上的投入比以前大得多。AI成本就像一个无底洞,让现金流卷入漩涡中,这是大厂面临的一个共同难题。

平衡被再一次打破

Meta公司前不久称一季度收入会低于分析师预期,同时宣布提高人工智能投入,导致其股价在盘后交易中暴跌15%。投资人担心巨大的AI成本会对公司经营业绩造成负面影响。这些投入主要集中在数据中心、AI芯片设计研发上。由原Facebook的VR/AR部门重组为Reality Labs的实验室,在一季度花了38亿美元,但只取得了4.4亿美元收入。

另一边,谷歌目前需要平衡内、外部对计算资源的消耗关系,由于算力供不应求,谷歌内部业务一度拿不到新增的计算资源。它对外投资20亿美元的人工智能公司Anthropic也在通过谷歌云使用它的TPUs算力(这家公司同时也在用亚马逊的自研芯片)。在这种供需矛盾中,谷歌只得修剪业务枝叶,把算力用在内、外部增长性更强的业务需求上。

这种把所有资源集中在同一个赛道的局面在过往互联网发展中从未出现。在互联网拓荒期,各家公司在电商、物流、社交网络、云计算等领域分头投资布局,像亚马逊重仓仓储网络,京东自建物流,确立各自的领先范围,井水不犯河水;后来各自领域的边际效应下降,又开始互相渗透对手领地,微软进攻谷歌的搜索和亚马逊的云计算,亚马逊挑战Facebook和谷歌的广告业务,美团和阿里在零售与本地生活领域打了数个回合……连环攻守,从而在市场份额上达到一个新的平衡;当几乎所有领域的边际效应都递减到一定程度,缺乏新增空间时,大厂现在纷纷瞄准了AI,统一了进攻目标,平衡再一次被打破。

但是,当大家都在争夺同一个东西时,就都失去了溢价能力,边际成本不断上涨。相信一句话,总有人在逆势中赚到钱。这时候却便宜了“做钓鱼竿”和“卖铲子”的人,英伟达成了最大受益者,连几家大厂都对外宣称自己和英伟达的关系有多铁,能第一批享用最新推向市场的GPU芯片。英伟达在过去十年将算力成本降低了1000倍,并通过软硬件一体化策略牢牢接住了AI风口上刮过来的馅饼。

为降低成本,对英伟达又爱又恨的大厂们开始自己造芯片和AI加速器,比如亚马逊的Gravition、阿里的平头哥产品、百度的昆仑系列、谷歌的TPUs和Axion、微软的Azure Maia等。但这些芯片多数是定制化、非标化、自用型的产品,目前在机器学习上还不能完全取代英伟达H100。提供标准化服务的英伟达可能并不担心对手能把算力做多大。

为了凸显AI高成本投入的回报前景,未来大厂财报中会更频繁地出现类似表述,“由AI拉动的增长达到多少多少”。微软高管在一季报时曾披露,在云计算Azure一季度31%的同比增长中,AI贡献占了7个百分点。

当AI大模型陆续渗透到各公司所有业务中时,就很难再界定哪些是由AI拉动的。比如ChatGPT嵌入到Azure、Bing、Microsoft 365微软全家桶中;阿里把通义千问嵌入到钉钉应用中;谷歌把Gemini Chatbox植入搜索和广告业务里。这些都不是像微软对数字助手Copilot用户每月收取30美元的直接变现,而是把AI作为一个底层能力,助推原有的上层业务获得新的收入增长。从几家公有云大厂营收增速有所回暖看,AI确实发挥了一定的作用。

总结:新的平衡

在互联网拓荒期,长期亏损的亚马逊能让投资人津津乐道的是总能看到新的增长点。贝索斯不追求短期盈利(当时投资人似乎也不在意这些),而是喜欢把资金大量投入到仓储、云计算这些重资产业务中,在未来给公司带去更大规模的收益和增长性。只要有增速和创新,投资人就有足够的耐心。贝索斯为证明公司实力,总习惯在财报里一上来就展示其充裕的现金流数据,而非利润表数据。

但现在时代变了,没有哪个大厂可以不顾及盈利压力,只用增长和创新给投资人“画饼”。在AI这个高度一致性、持续高成本消耗的技术竞赛中,每个有实力的选手都要下场参赛,更大规模的营收预期才能匹配这种级别的投入。大厂纷纷抢跑AI,就是为了在下一个平衡到来前拿到一张新的船票,只不过这张船票太贵了。

Prev Chapter:全球十大IC:美国压倒性领先 上海韦尔进榜

Next Chapter:又一个AI爬虫:Skyvern-AI

评论区

- 这篇文章还没有收到评论,赶紧来抢沙发吧~