小而强,英伟达剪枝、蒸馏出Llama-3.1-Minitron 4B AI模型_tiknovel-最新最全的nft,web3,AI技术资讯技术社区

小而强,英伟达剪枝、蒸馏出Llama-3.1-Minitron 4B AI模型

2024-08-17 17:41:21 浏览:289 作者:管理员

小而强,英伟达剪枝、蒸馏出Llama-3.1-Minitron 4B AI模型

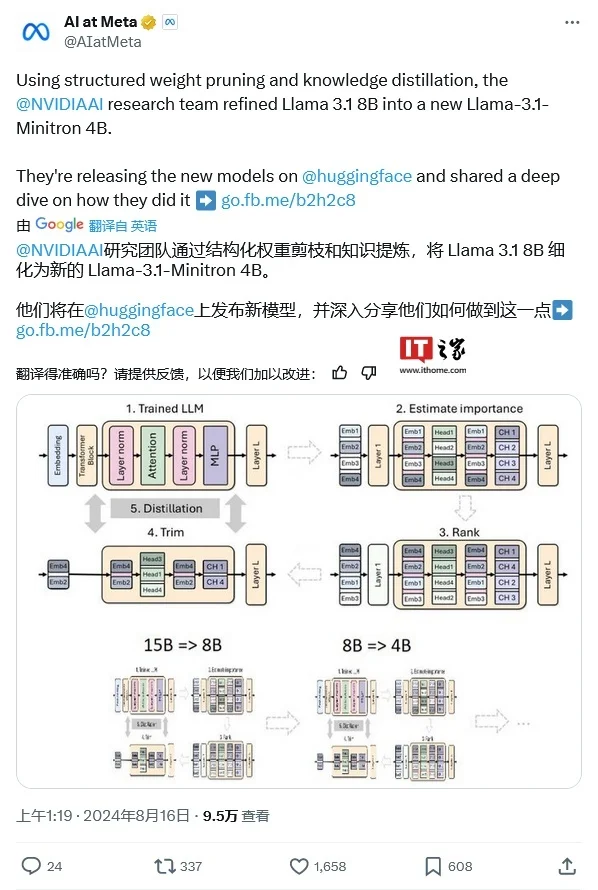

IT之家 8 月 17 日消息,英伟达公司联合 Meta 公司发布了最新的 Llama-3.1-Minitron 4B AI 模型,主要通过结构化权重剪枝、知识提炼等尖端技术,成功蒸馏(Distill)出 40 亿参数的“小而强”模型。

图源:英伟达

Llama-3.1-Minitron 4B 模型在 Llama-3.1-Minitron 8B 基础上蒸馏而来,英伟达在深度和宽度方向上使用了结构化剪枝技术。

IT之家注:剪枝是一种删除网络中不那么重要的层或神经元的技术,保留其性能的情况下,目的是减小模型的大小和复杂度。

英伟达通过从模型中删除 16 层来进行深度剪枝,并将其从 8B 模型缩减为 4B 模型,此外还部署另一种技术,通过修剪嵌入维度和 MLP 中间层来进行宽度剪枝。

除了剪枝,Nvidia 还采用了经典蒸馏技术来提高 Llama-3.1-Minitron 4B 的效率。

知识蒸馏是一个过程,在这个过程中,一个较小的模型(即学生)会被训练成模仿一个更大、更复杂的模型(即教师)的行为。通过这种方式,较小模型中保留了原始模型的大部分预测能力,但速度更快,资源更节省。

英伟达将此与蒸馏技术和剪枝技术相结合,确保重新训练的 4B 模型性能优异,并在更大的模型中得到很好的应用。

Prev Chapter:Together AI发表了一篇介绍对GPU集群进行验收测试的指南文章

Next Chapter:Linly-Dubbing 智能视频多语言AI配音/翻译工具

评论区

共 0 条评论

- 这篇文章还没有收到评论,赶紧来抢沙发吧~