谷歌发布基础世界模型Genie,能一图创建互动的虚拟环境_tiknovel-最新最全的nft,web3,AI技术资讯技术社区

谷歌发布基础世界模型Genie,能一图创建互动的虚拟环境

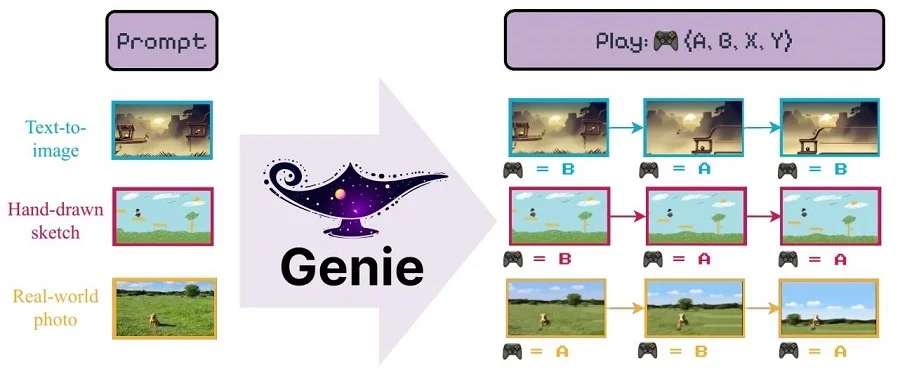

据谷歌公司官网26日报道,谷歌旗下“深度思维”公司重磅发布了一个根据互联网视频训练的基础世界模型——Genie(精灵)。其可从合成图像、照片、草图生成多种动作可控的环境。

Genie效果的动图截图演示。

图片来源:谷歌官网

过去几年,生成式人工智能(AI)模型能通过语言、图像甚至视频生成内容。谷歌此次引入生成式人工智能新范式,即生成式交互式环境,通过单个图像提示即可生成交互式、动作可控的环境。

Genie是一个110亿参数的基础世界模型,在超过20万小时的二维(2D)游戏视频上进行训练,无需人工监督。这意味着Genie可以从视频中自行识别不同动作的特征和模式。其能学习各种角色的动作、控制和行动。

Genie的独特之处还在于它能够专门从互联网视频中学习细颗粒度的控制。Genie不仅能观察哪些部分是可控制的,而且能根据生成的环境来推测出多种潜在的动作。

该模型接受单个图像(无论是AI合成图像、照片还是草图),并将其转换为可玩的游戏,响应用户控件。从图像到基本的交互环境一步到位。

用户只需提供一张纸上的草图、一幅完美的数字艺术作品,甚至是AI生成对2D世界的描述,Genie就会完成剩下的工作,帮用户生成2D游戏。

谷歌官网称,Genie专注2D平台游戏和机器人技术的视频,但方法通用,应适用于任何类型领域并可扩展至更大的互联网数据集。只需一张图像就能创建全新的交互环境,这为生成和进入虚拟世界的各种新路径开启了大门。

Prev Chapter:多家新闻机构起诉微软和OpenAI,指控ChatGPT侵犯版权

Next Chapter:EMO:一张照片+音频即可生成会说话唱歌的视频

评论区

- 这篇文章还没有收到评论,赶紧来抢沙发吧~

【随机内容】

-

Library of Heaven’s Path Chapter 369: Kong shi Admits a Disciple, the Student of the Sage

2024-11-17 -

Emperor’s Domination Chapter 5646: Ancient Battlefield Online | tiknovel.com

2024-11-19 -

The Desolate Era Chapter 33 – Evanescent Demonslayer Sword

2024-11-21 -

lord of the mysteries Chapter 1212 - Spreading Radiance

2024-11-16