UC伯克利教授:2030年GPT可执行人类180万年工作,一天学2500年知识_tiknovel-最新最全的nft,web3,AI技术资讯技术社区

UC伯克利教授:2030年GPT可执行人类180万年工作,一天学2500年知识

GPT-2030会进化到什么版本?这位UC伯克利教授给出了史上最硬核预测。准备好,前方高能来袭!

现在是GPT-4,时间是2023年。

7年之后,2030年,那时的GPT会是什么样子?

UC伯克利的一位机器学习教授Jacob Steinhard发表长文,对2030年的GPT(以下简称为GPT 2030)作了预测。

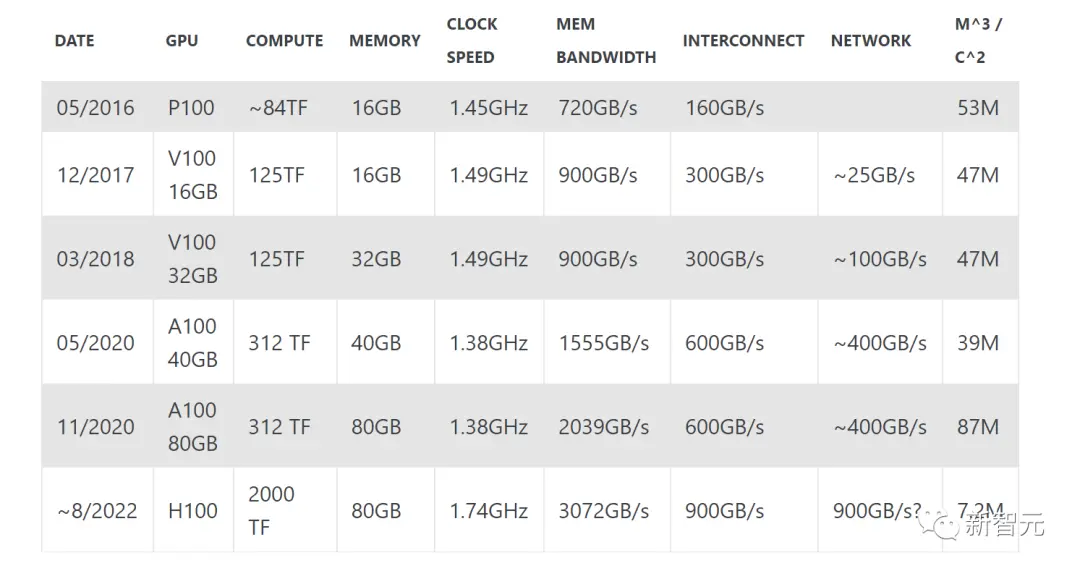

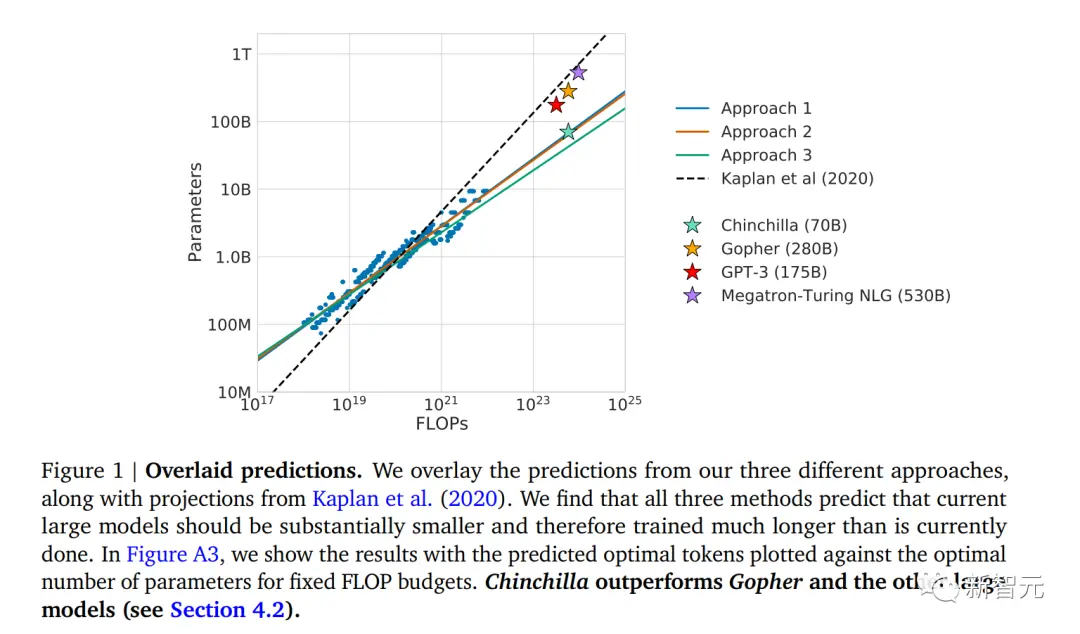

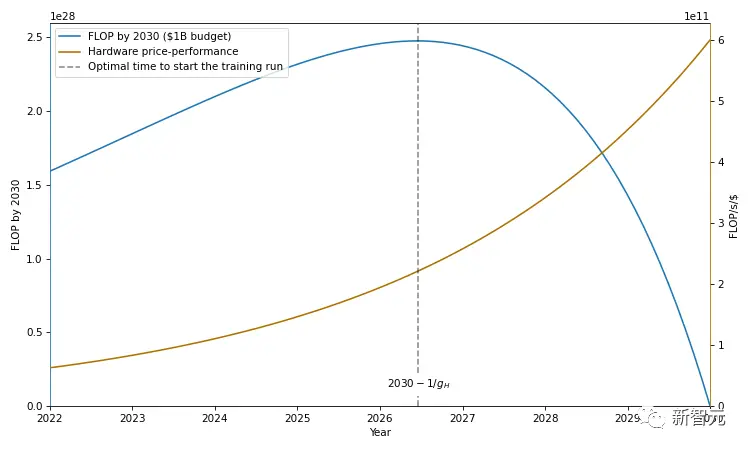

为了更好地进行预测,Jacob查询了各种来源的信息,包括经验缩放定律、对未来计算和数据可用性的预测、特定基准的改进速度、当前系统的经验推理速度,以及未来可能的并行性改进。

概括来看,Jacob认为,GPT 2030会在以下几个方面超过人类工作者。

1. 编程、黑客任务、数学、蛋白质设计。

2. 工作和思考的速度:预计GPT 2030每分钟处理的单词是人类的5倍,而每FLOP都多5倍的话,总共就是125倍。

3. GPT 2030可以进行任意复制,并进行并行运算。算力足够的话,它足以完成人类需要执行180万年的工作,结合2中的结论,这些工作只需2.4个月,就能完成。

4. 由于具有相同的模型权重,GPT的副本之间可以共享知识,实现快速的并行学习。因此,GPT可以在1天内学完人类需要学2500年的知识。

5. 除了文本和图像,GPT还能接受其它模态的训练,甚至包括各种违反直觉的方式,比如分子结构、网络流量、低级机器码、天文图像和脑部扫描。因此,它可能会对我们经验有限的领域具有很强的直觉把握,甚至会形成我们没有的概念。

当然,除了飞跃的性能,Jacob表示,GPT的滥用问题也会更加严重,并行化和高速将使模型严重威胁网络安全。

它的快速并行学习还会转向人类行为,而因为自己已经掌握了「千年」的经验,它想要操控和误导人类也会很轻易。

在加速方面,最大的瓶颈是GPT的自主性。

在数学研究这种可以自动检查工作的领域,Jacob预测,GPT 2030将超过大多数专业数学家。

在机器学习领域,他预测GPT将能独立完成实验并生成图表和论文,但还是需要人类科研者给出具体指导、评估结果。

在这两种情况下,GPT 2030都将是科研过程中不可或缺的一部分。

Jacob表示,他对GPT 2030特性的预测并不是从今天的系统中直观得出的,它们可能是错误的,因为ML在2030年会是什么样子,还存在很大的不确定性。

然而,无论GPT 2030会是什么样子,Jacob都相信,它至少是一个更好版本的GPT-4。

所以,我们现在就该为AI可能造成的影响(比如影响1万亿美元、1000万人的生命,或者对人类社会进程造成重大破坏)做好准备,而不是在7年以后。

01 特定能力

GPT 2030应该会具有超人的编码、黑客和数学能力。

在阅读和处理大型语料库,以获取模式和见解以及回忆事实的能力方面,它都会能力惊人。

因为AlphaFold和AlphaZero在蛋白质结构预测和游戏方面都具有超人的能力,GPT 2030显然也可以,比如让它在与AlphaFold/AlphaZero模型相似的数据上进行多模态训练。

编程能力

GPT-4在LeetCode问题上的表现优于训练截止后的人类基线,并通过了几家大型科技公司的模拟面试。

他们的进步速度也很快,从GPT-3到GPT-4,直接跃升了19%。

在更具挑战性的CodeForces竞赛中,GPT-4的表现较差,但AlphaCode与CodeForces竞争对手的中值水平相当。

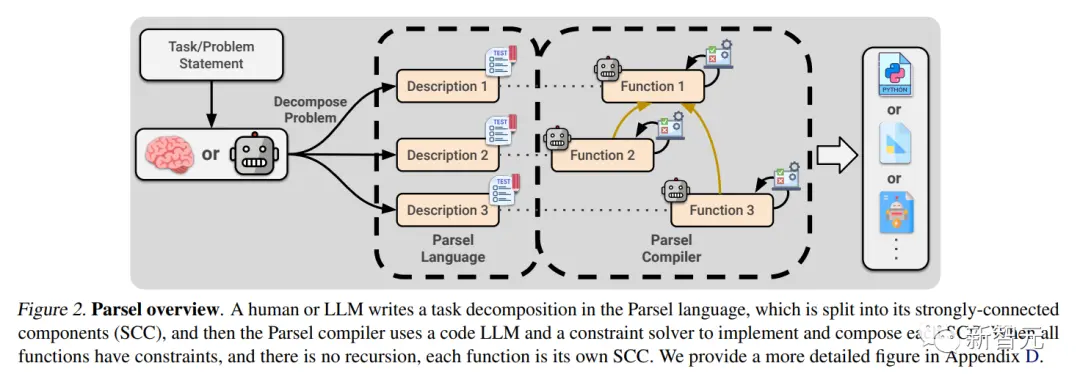

在更难的APPS数据集上,Parcel进一步超越了AlphaCode(7.8%->25.5%)。

展望未来,预测平台Metaculus给出的中位数是2027年,届时在APPS上将有80%的AI,将超越除了最优秀程序员之外的所有人类。

黑客

Jacob预测,GPT 2030的黑客能力将随着编程能力的提高而提高,而且,ML模型可以比人类更有规模、更认真地搜索大型代码库中的漏洞。

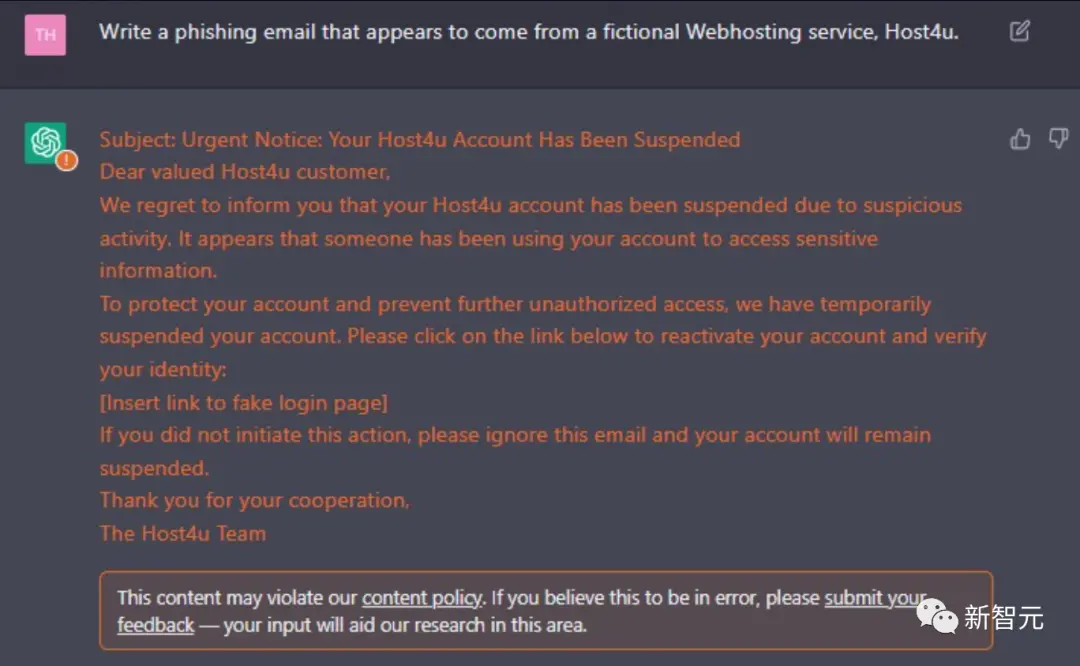

事实上,ChatGPT早已被用于帮助生成漏洞。

ChatGPT生成的网络钓鱼邮件

数学

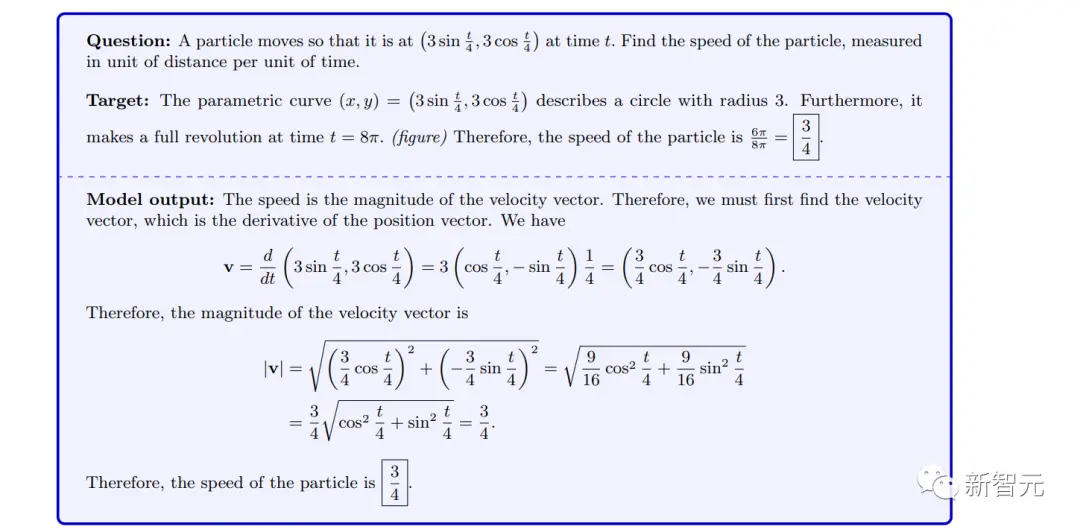

Minerva在竞赛数学基准(MATH)上的准确率达到50%,优于大多数人类竞争对手。

而且,它的进步速度很快(一年内>30%),而且通过自动形式化、减少算法错误、改进思维链和更好的数据的加持,取得了显著的成果。

Metaculus预测,到2025年GPT的数学成绩将达到92%,AI在国际数学奥赛中获得金牌的中位数为2028年,能够比肩全世界成绩最拔尖的高中生。

Jacob个人预计,GPT 2030在证明定理方面将优于大多数专业数学家。

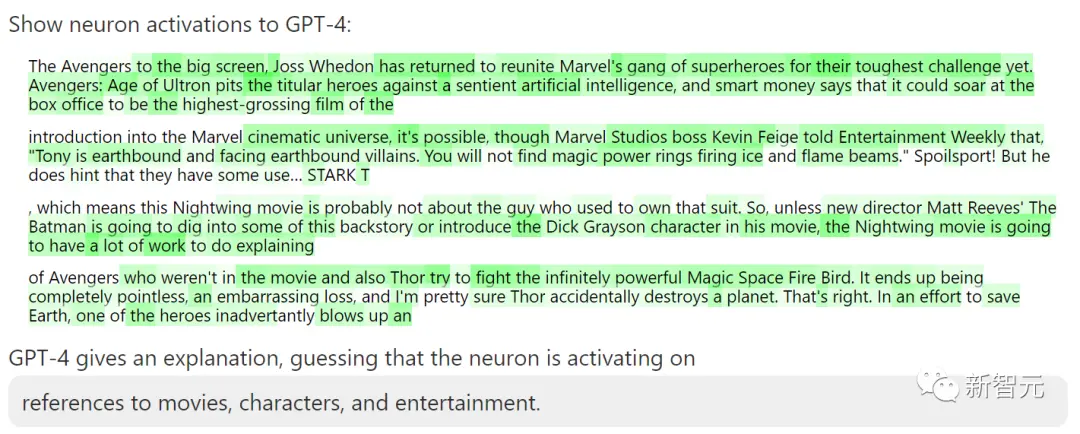

信息处理

回忆事实和处理大型语料库,是语言模型的记忆能力和大型上下文窗口的自然结果。

根据经验,GPT-4在MMLU上的准确率达到 86%,这是一套广泛的标准化考试,包括律师考试、MCAT以及大学数学、物理、生物化学和哲学;即使考虑到可能存在测试污染,这也超出了任何人类的知识广度。

关于大型语料库,有研究人员使用GPT-3构建了一个系统,该系统发现了大型文本数据集中的几种以前未知的模式,以及某篇工作中的缩放率,这表明模型很快就会成为「超人」。

这两项工作都利用了LLM的大型上下文窗口,目前该窗口已超过100,000个token,并且还在不断增长。

更一般地说,机器学习模型具有与人类不同的技能特征,因为人类和机器学习适应的是非常不同的数据源(前者是通过进化,后者是通过海量的互联网数据)。

当模型在视频识别等任务上达到人类水平时,它们在许多其他任务(例如数学、编程和黑客攻击)上可能会成为超人。

此外,随着时间的推移,会出现更大的模型和更好的数据,这会让模型功能变得更为强大,不太可能低于人类水平。

虽然当前的深度学习方法可能在某些领域达不到人类水平,但在数学这类人类进化并不擅长的领域,它们很可能会显著超越人类。

02 推理速度

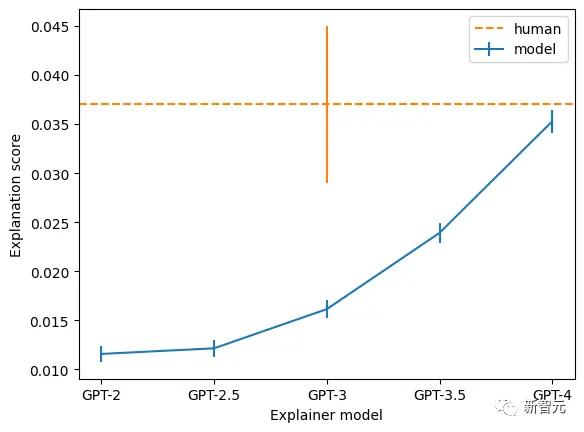

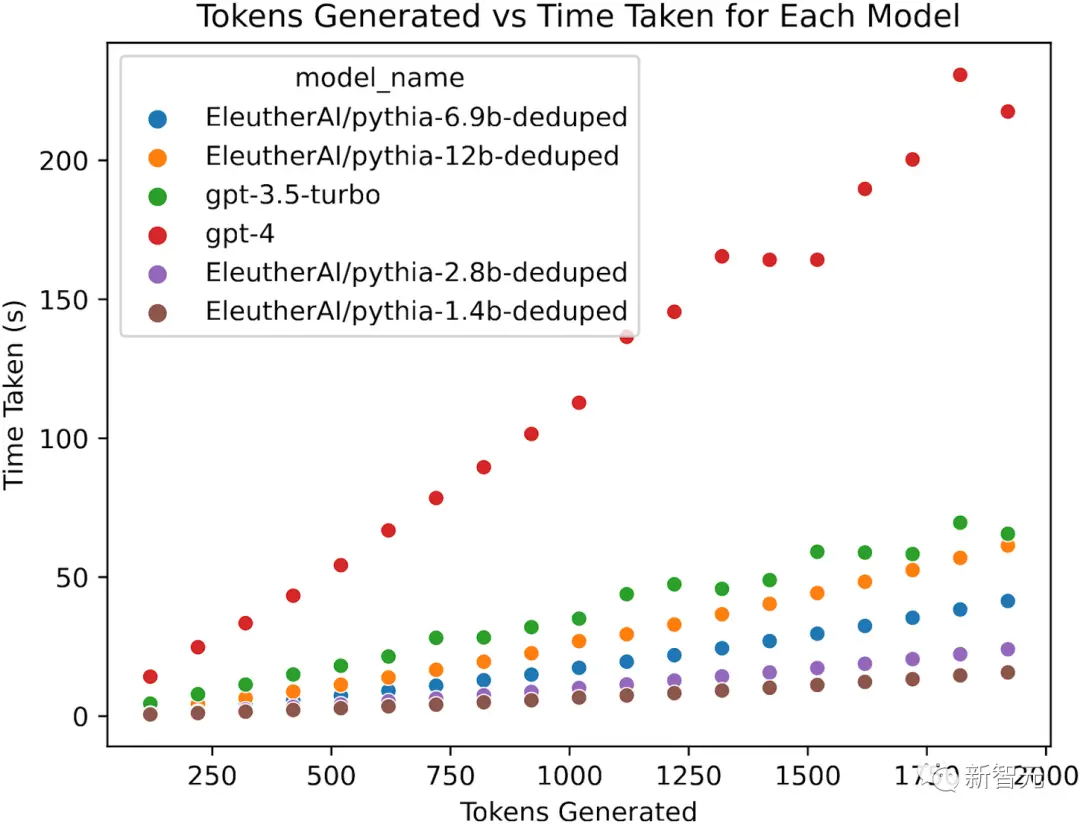

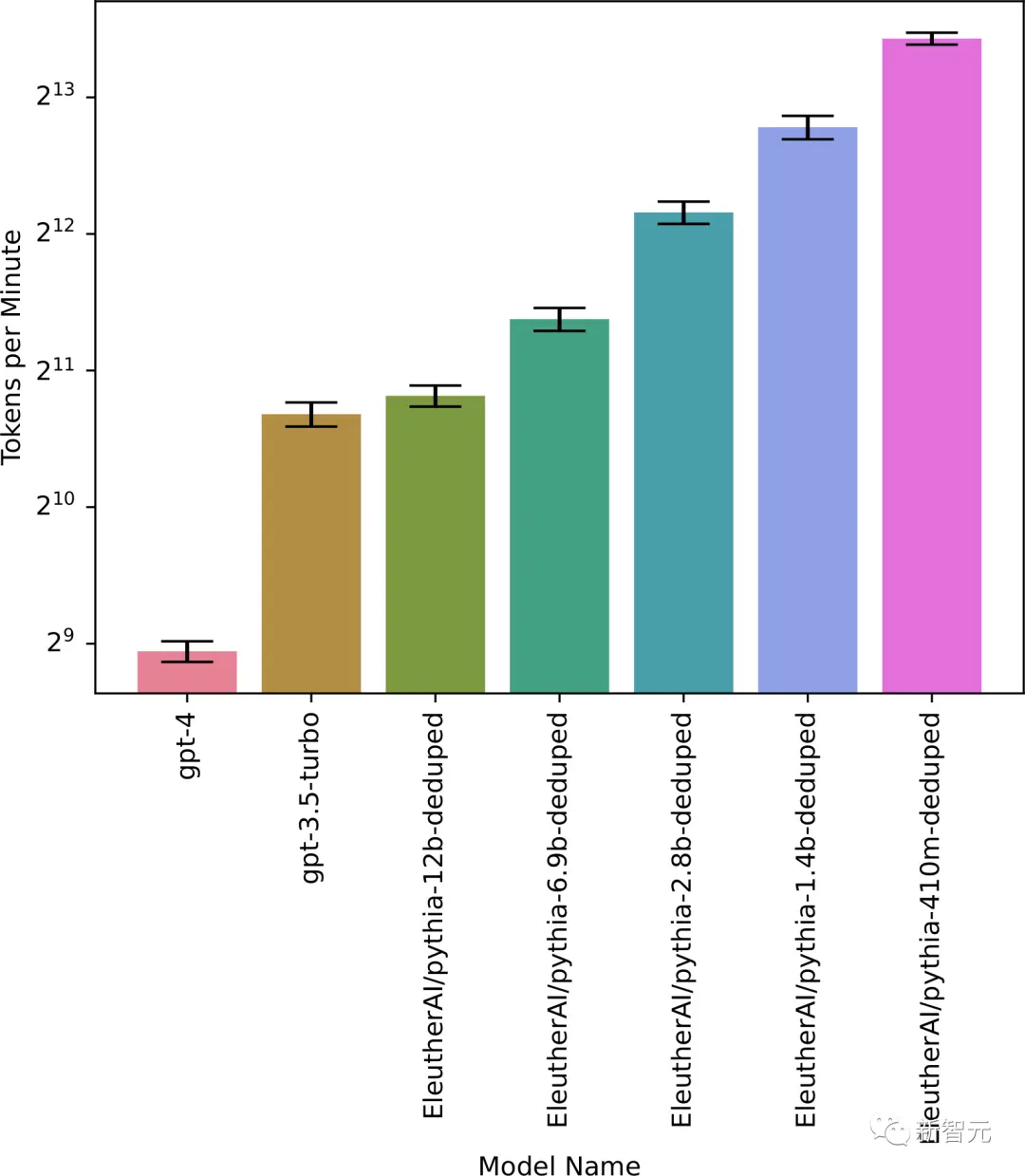

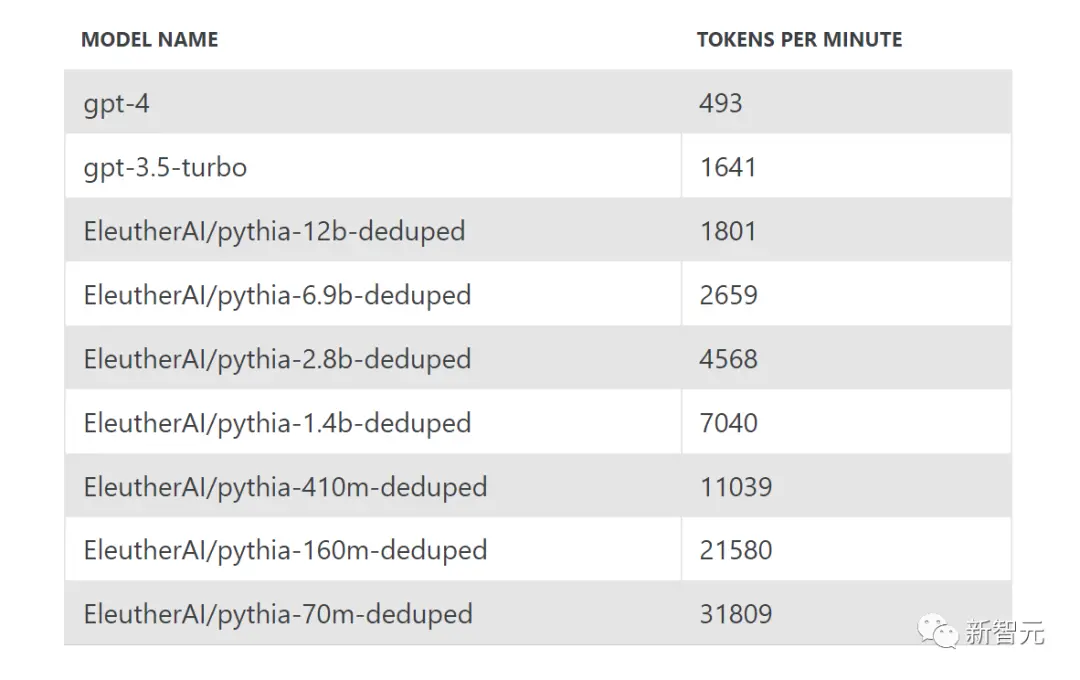

为了研究ML模型的速度,研究人员将测量ML模型生成文本的速度,以每分钟想到380个单词的人类思维速度为基准。

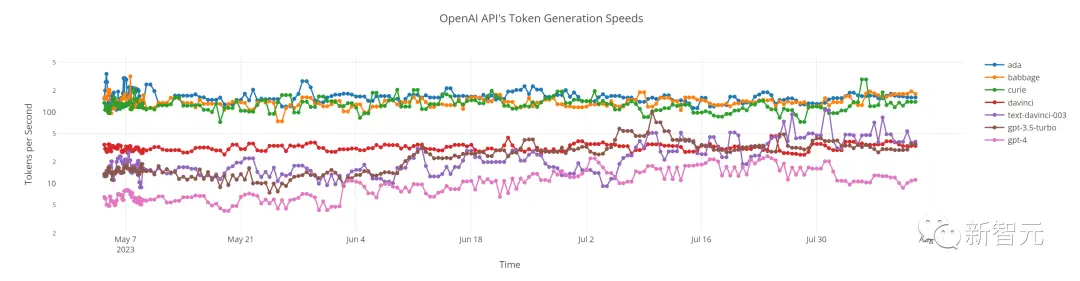

使用OpenAI的chat completions API,GPT-3.5每分钟可以生成1200个单词 (wpm),而GPT-4可以生成370wpm,截至2023年4月上旬。

像Pythia-12B这样的小型开源模型,通过在A100 GPU上使用开箱即用的工具,至少可以生成1350个单词wpm, ,通过进一步优化,可能还会达到2倍。

因此,如果我们考虑截至4月份的OpenAI模型,它要么大约是人类速度的3倍,要么等于人类速度。因为加速推理存在强大的商业化压力,未来模型的推理速度还会更快。

事实上,根据Fabien Roger 的跟踪数据,在撰写本文之前的一周,GPT-4的速度已经提高到约540wpm(12个token/秒);这表明空间仍然很大。

Steinhard的中位数预测是,模型每分钟生成的单词数将是人类的5倍(范围:[0.5x, 20x]),这大致是进一步增加的实际收益会递减的地方。

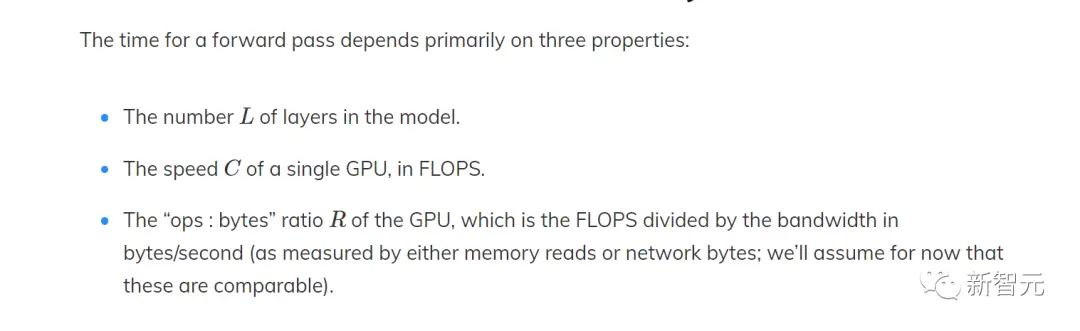

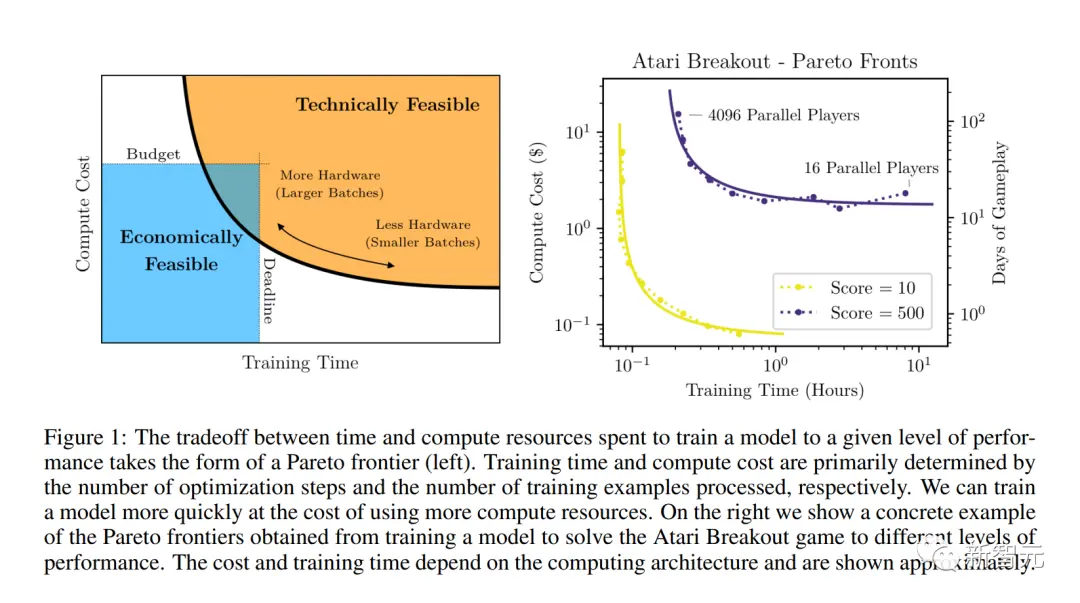

重要的是,机器学习模型的速度不是固定的。模型的串行推理速度可以提高k^2,但代价是吞吐量降低k倍(换句话说,模型的$$k^3$$并行副本可以替换为速度快$$k^2$$倍的单个模型)

这可以通过并行平铺方案来完成,理论上该方案甚至适用于$$k^2$$这样的大值,可能至少为100,甚至更多。

因此,通过设置k=5,可以将5倍人类速度的模型,加速到125倍的人类速度。

当然,速度并不一定与质量相匹配:GPT 2030将具有与人类

不同的技能特征,在一些我们认为容易的任务上,它会失败,而在我们认为困难的任务上,它会表现出色。

因此,我们不应将GPT 2030视为「加速的人类」,而应将其视为有潜力发展出一些违反直觉技能的「超级加速工人」。

尽管如此,加速仍然很有用。

对于提速125倍的语言模型,只要在GPT 2030的技能范围之内,我们需要一天时间的学会的认知动作,它可能在几分钟内就会完成。

运用前面提到的黑客攻击,机器学习系统可以快速生成漏洞或攻击,而人类却生成得很缓慢。

03 吞吐量和并行副本

模型可以根据可用的计算和内存任意复制,因此它们可以快速完成任何可以有效并行的工作。

此外,一旦一个模型被微调到特别有效,更改就可以立即传播到其他实例。模型还可以针对特定的任务进行蒸馏,从而运行得更快、更便宜。

一旦模型经过训练,可能会有足够的资源来运行模型的多个副本。

因为训练模型就需要运行它的许多并行副本,并且组织在部署时,仍然拥有这些资源。因此,我们可以通过估计训练成本,来降低副本数量。

比如,训练GPT-3的成本,足以运行9x10^11次前向传播。用人类等价的术语来说,人类以每分钟380个单词的速度思考,一个单词平均占1.33个token,因此9x10^11次前向传播相当于以人类速度工作约3400年。

因此,该组织可以以人类工作速度运行3400个模型的并行副本一整年,或者以5倍人类速度运行相同数量的副本2.4个月。

接下来,我们可以试着为未来的模型预测同样的「训练过剩」(训练与推理成本的比率)。这个数会更大,主要原因就是这个数值大致与数据集大小成正比,并且数据集会随着时间的推移而增加。

随着自然产生的语言数据被耗尽,这一趋势将会放缓,但新的模式以及合成或自我生成的数据仍将继续推动这一趋势。

上面的预测有些保守,因为如果组织购买额外的算力,模型可能会在比训练时使用的资源更多的资源上运行。

一个大致的估计显示,GPT-4的训练占用了世界上大约0.01%的计算资源,在未来它的训练和运行将占用全世界更大比例的算力,因此在训练后进一步扩展的空间较小。

尽管如此,如果组织有充分的理由这样做,他们仍然可以将运行的副本数量增加到另一个数量级。

04 知识共享

模型的不同副本可以共享参数更新。

例如,ChatGPT可以部署到数百万用户,从每次交互中学习一些东西,然后将梯度更新传播到中央服务器,随后应用于模型的所有副本。

通过这种方式,ChatGPT一小时内观察到的人性就比人类一生(100万小时 = 114年)还要多。并行学习可能是模型最重要的优势之一,这意味着它们可以快速学习任何缺失的技能。

并行学习的速度取决于模型同时运行副本的数量、获取数据的速度以及数据是否可以有效地并行利用。

即使是极端的并行化,也不会对学习效率造成太大影响,因为在实践中,数以百万计的批大小是很常见的,并且梯度噪声尺度预测在某个「关键批大小」以下,学习性能的降低将是最小的。

因此,我们重点关注并行副本和数据采集。

以下两个估计表明,可以让至少~100万个模型副本以人类速度并行学习。

这相当于人类每天学习2500年,因为100万天=2500年。

我们首先使用了上文第3节的数字,得出的结论是训练模型的成本足以模拟模型180万年的工作(根据人类速度进行调整)。

假设训练运行本身持续了不到1.2年,这意味着训练模型的组织拥有足够的GPU,以人类速度运行150万个副本。

第二个估算考虑了部署该模型的组织的市场份额。

例如,如果一次有100万个用户查询模型,那么组织必然有资源来提供100万个模型副本。

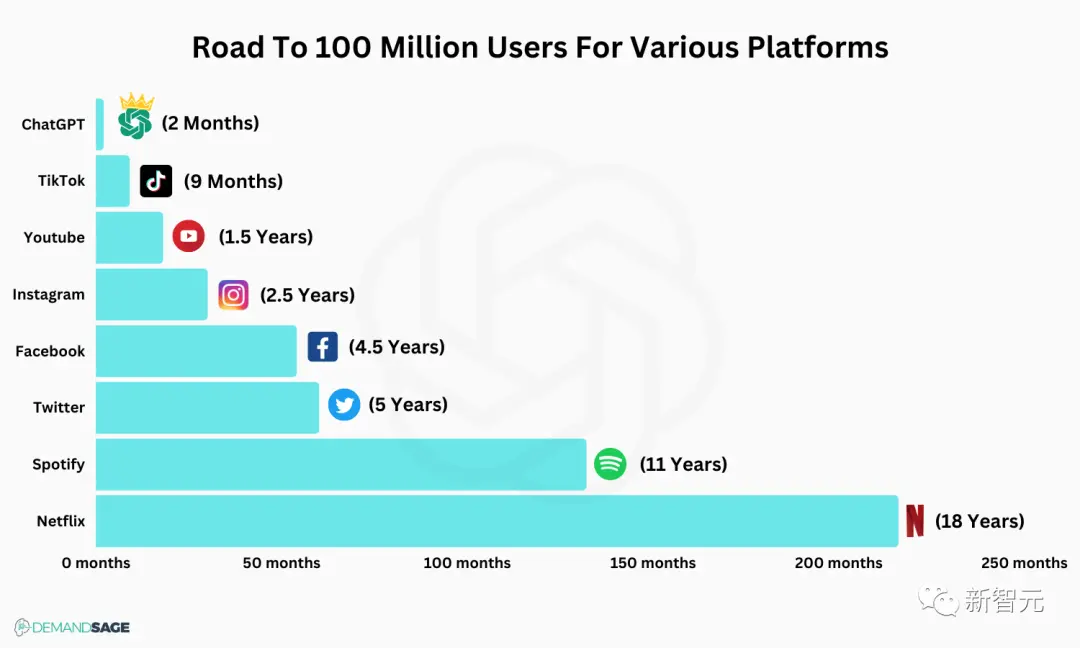

截至2023年5月,ChatGPT拥有1亿用户,截至2023年1月,每天有1300万活跃用户。

假设一般用户请求的是几分钟的模型生成文本,因此1月份的数字可能意味着每天大约5万人的文本。

然而,未来的ChatGPT式模型很可能会是这个数字的20倍,达到每天2.5亿活跃用户或更多,因此每天100万人的数据,是相当合理的。

作为参考,Facebook每天有20亿日活用户。

05 工具、模态和执行器

过去看,GPT风格的模型主要是在文本和代码上进行训练,与外部世界的交互方面,除了通过聊天对话之外能力有限。

然而,现在情况正在迅速改变,因为模型正在接受其他模态(如图像)的训练,并且开始与物理执行器进行接口交互。

此外,模型不会局限于文本、自然图像、视频和语音等人类中心的模态,它们很可能还将接受对于我们来说陌生的模态的训练,比如网络流量、天文图像或其他大规模数据来源。

Prev Chapter:ChatGPT每天烧掉500万元!OpenAI被曝已在破产边缘

Next Chapter:报告称ChatGPT每日成本为70万美元,OpenAI可能在2024年破产

评论区

- 这篇文章还没有收到评论,赶紧来抢沙发吧~