Meta公布audio2photoreal AI框架,输入配音文件即可生成人物对话场景_tiknovel-最新最全的nft,web3,AI技术资讯技术社区

Meta公布audio2photoreal AI框架,输入配音文件即可生成人物对话场景

2024-01-10 14:37:41 浏览:116 作者:管理员

输入配音文件即可生成人物对话场景,Meta公布audio2photoreal AI框架

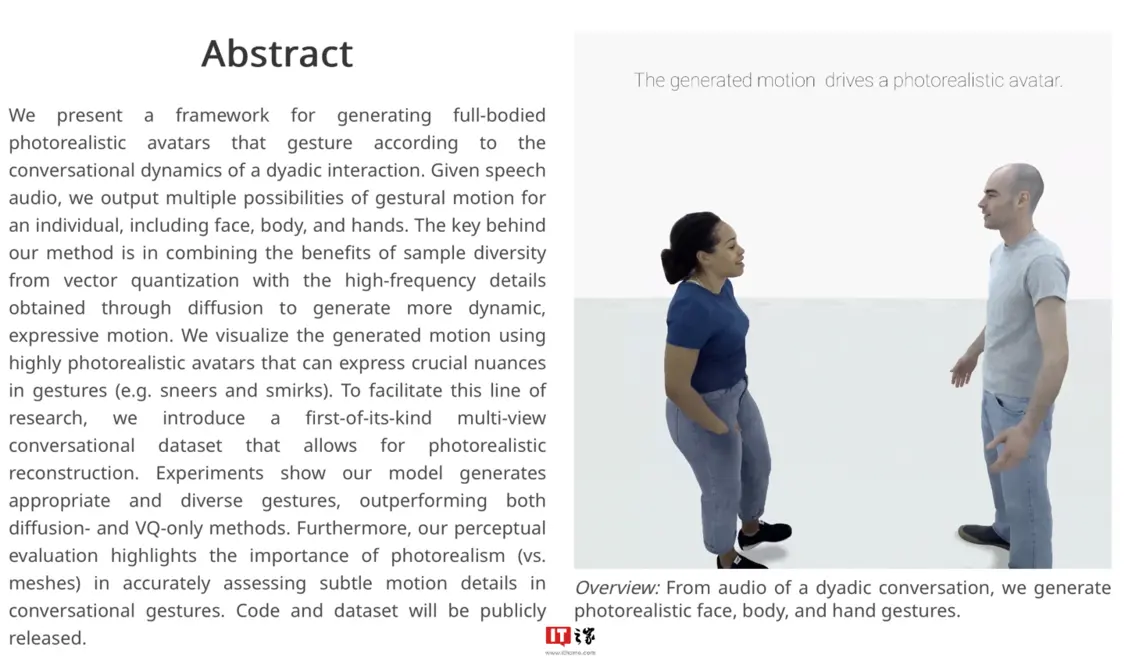

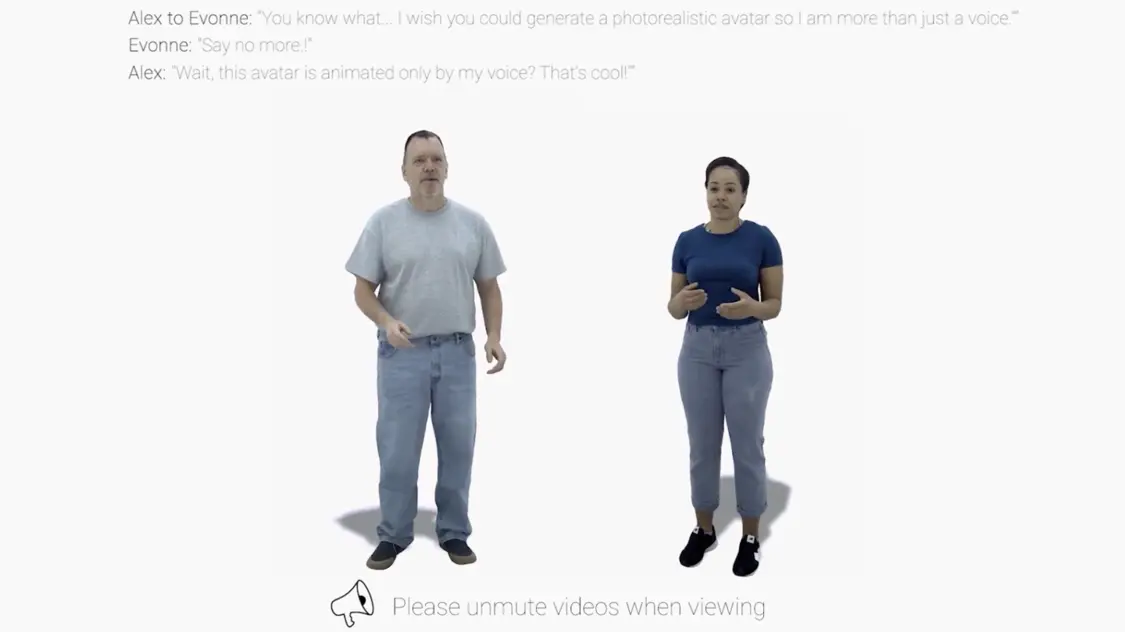

1 月 9 日消息,Meta 日前公布了一项名为 audio2photoreal 的 AI 框架,该框架能够生成一系列逼真的 NPC 人物模型,并借助现有配音文件自动为人物模型“对口型”“摆动作”。

Meta研究报告

IT之家从官方研究报告中得知,Audio2photoreal 框架在接收到配音文件后,首先生成一系列 NPC 模型,之后利用量化技术及扩散算法生成模型用动作,其中量化技术为框架提供动作样本参考、扩散算法用于改善框架生成的人物动作效果。

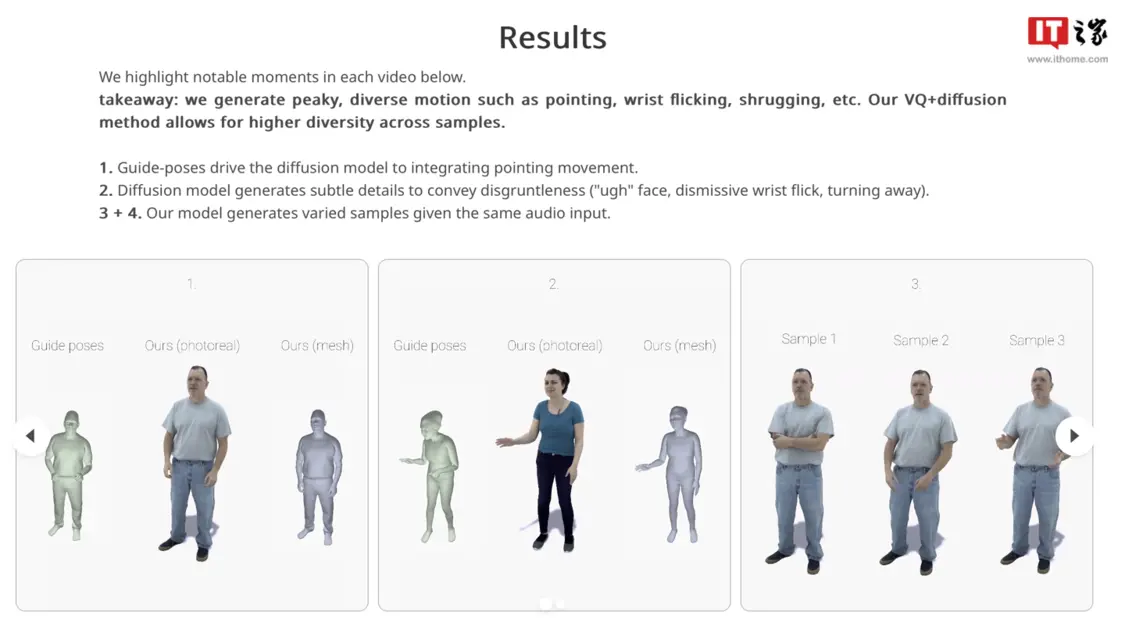

研究人员提到,该框架可以生成 30 FPS 的“高质量动作样本”,还能模拟人类在对话中“手指点物”、“转手腕”或“耸肩”等不由自主的“习惯性动作”。

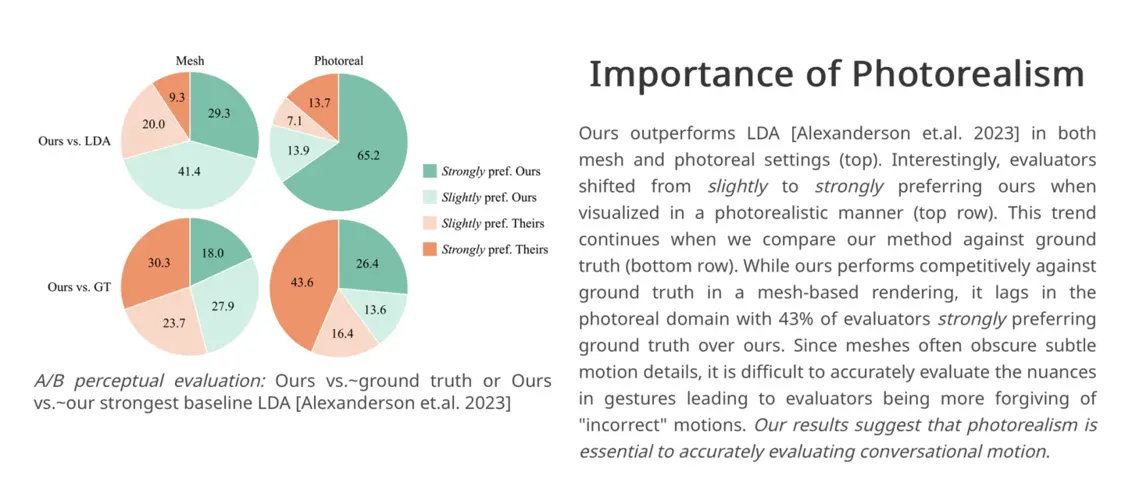

研究人员援引自家实验结果,在对照实验中有 43% 的评估者对框架生成的人物对话场景感到“强烈满意”,因此研究人员认为 Audio2photoreal 框架相对于业界竞品能够生成“更具动态和表现力”的动作。

据悉,研究团队目前已经在 GitHub 公开了相关代码和数据集。

Prev Chapter:阿尔特曼:我被开除又回来很痛苦,但对OpenAI是好事

Next Chapter:AI助力微软发现新材料:80小时完成20年筛选任务

评论区

共 0 条评论

- 这篇文章还没有收到评论,赶紧来抢沙发吧~