台积电量产特斯拉Dojo AI训练模块,目标到2027年将算力提高40倍_tiknovel-最新最全的nft,web3,AI技术资讯技术社区

台积电量产特斯拉Dojo AI训练模块,目标到2027年将算力提高40倍

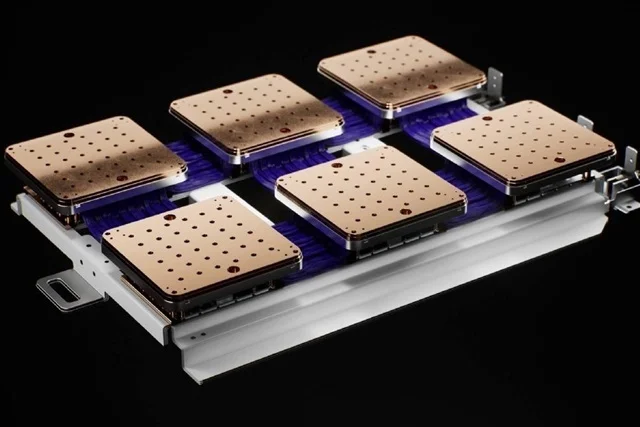

据 DigiTimes,台积电宣布开始利用其 InFO_SoW 技术生产特斯拉 Dojo AI 训练模块,目标是到 2027 年通过更复杂的晶圆级系统将计算能力提高 40 倍。

▲ 图源:特斯拉

InFO_SoW(整合型扇出晶圆级系统封装)是“InFO”技术应用于高性能计算机的一种改良模式,也是一种晶圆级(Wafer Scale)的超大型封装技术,主要包括晶圆状的放热模组(Plate)、硅芯片(Silicon Die)群、InFO RDL、电源模组、连接器等部分。

InFO_SoW 在模组(尺寸和晶圆大小相近)上横向排列多个硅芯片(Silicon Die,或者 Chip),再通过“InFO”结构使芯片和输入 / 输出端子相互连接,从而区别于堆叠了两个“InFO”的“InFO_SoIS(System on Integrated Substrate)”技术。

一般来说,InFO_SoW 技术生产的芯片面积较大,它可以将大规模系统(由大量的硅芯片组成)集成于直径为 300mm 左右的圆板状模组(晶圆状的模组)上;而通过采用 InFO 技术,它又可以获得相比传统的模组相更小型、更高密度的集成系统。

在台积电之前公布的资料中,InFO_SoW 相比于采用倒装芯片(Flip Chip)技术的 Multi-chip-module(MCM)和“InFO_SoW”更有优势。IT之家查询发现,与 MCM 相比,其相互连接的排线宽度、间隔缩短了二分之一,排线密度提高了两倍。此外,其单位面积的数据传输速度也提高了两倍;电源供给网络(PDN)的阻抗(Impedance)明显低于 MCM,仅为 MCM 的 3%。

Prev Chapter:前Meta首席工程负责人胡鲁辉:“后GPT-4”有4大发展趋势,理解物理世界才能接近AGI

Next Chapter:GPT-4、Llama 2比人类更懂“人类心理”?最新研究登上Nature子刊

评论区

- 这篇文章还没有收到评论,赶紧来抢沙发吧~

【随机内容】

-

Reincarnation Of The Strongest Sword God Chapter 1515 - Oppressing an Archaic Species

2024-11-16 -

2022-04-04

2022-04-04

-

2022-04-22

2022-04-22

-

2024-05-29

2024-05-29