最强AR眼镜来了!Meta十年绝密项目,你的下一台手机可能是眼镜_tiknovel-最新最全的nft,web3,AI技术资讯技术社区

最强AR眼镜来了!Meta十年绝密项目,你的下一台手机可能是眼镜

未来的眼镜会长成什么样子?不知道有多少人设想过。

和现在的体积差不多,导航时变成移动的 HDR,视频通话时对方的动态形象悬浮在空中,镜片能显示所有你需要的内容…… 反正就和贝吉塔、钢铁侠戴的那种差不多。

今天凌晨,Meta 发布的首款 AR 智能眼镜 Orion,让我们离这个理想中的产品更近了一点。虽说过去的几年陆续有 AR 眼镜发布,但共性也很明显:要么功能单一只是个移动投影仪,要么体积笨重价格昂贵,完全不适合大众市场。

和先前的产品相比,Meta Orion 不厚重的外观和集成的 AR 功能,让大家再次看到了 AR 眼镜落地的希望。

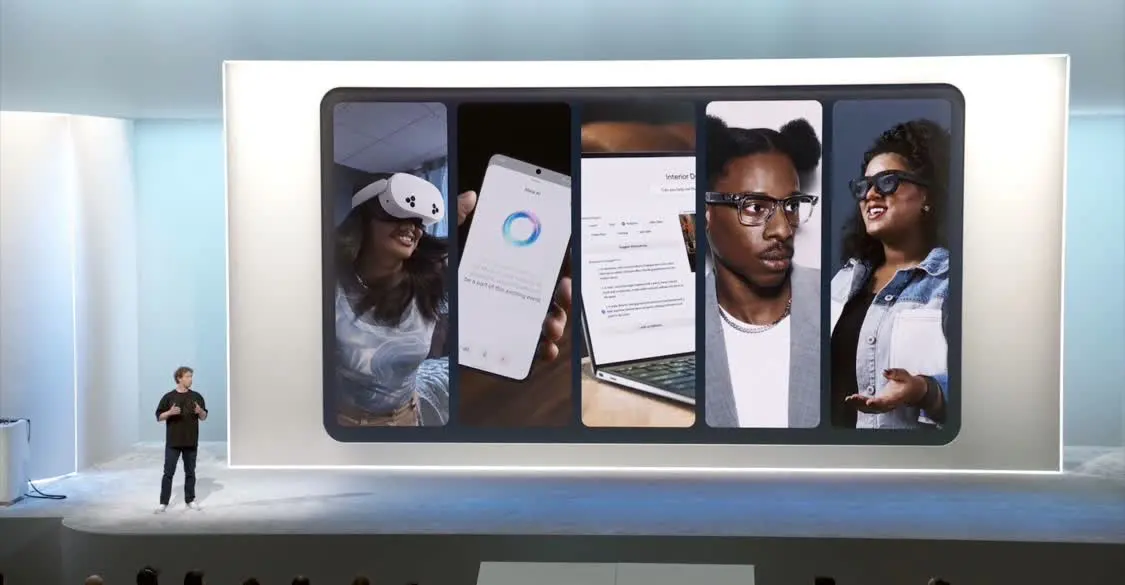

而且 Meta Connect 2024 作为发布会十周年的重要节点,扎克·伯格还带来了其他新玩意儿:

Meta Orion 智能眼镜惊艳登场,AR 体验领先行业;

Meta Quest 3S 头显 MR 眼镜发布,Quest 3 的「青春版」没新意但更便宜;

Meta AI 继续升级,助力头显硬件有更好的使用体验;

Meta Ray-Ban 的 AI 新功能:实时翻译、个性穿搭建议,还能帮你记车位

Meta 首个开源大模型 Llama 3.2 亮相,拥有多模态能力。

AI +硬件是今年所有消费电子品绕不过去的话题,那 Meta 究竟是如何将自家的大模型与新品硬件相结合?万众瞩目的 Meta Orion 智能眼镜究竟长什么样子?我们一起来看看。

Meta 首款 AR 眼镜惊艳亮相,花十年「all in」的明日产品

在扎克伯格的构思中,眼镜应该是最佳的「未来派」设备。

在此之前,已经走入大众市场并且取得了不错战绩的联名眼镜 Ray-Ban Meta,成功验证了市场对智能眼镜的接受程度。

但这个产品,只能说完成了 Meta 目标的一半:Ray-Ban Meta 主要提供音频、摄影和部分 AI 功能,简单来说还是一个戴在眼睛上的传统设备。

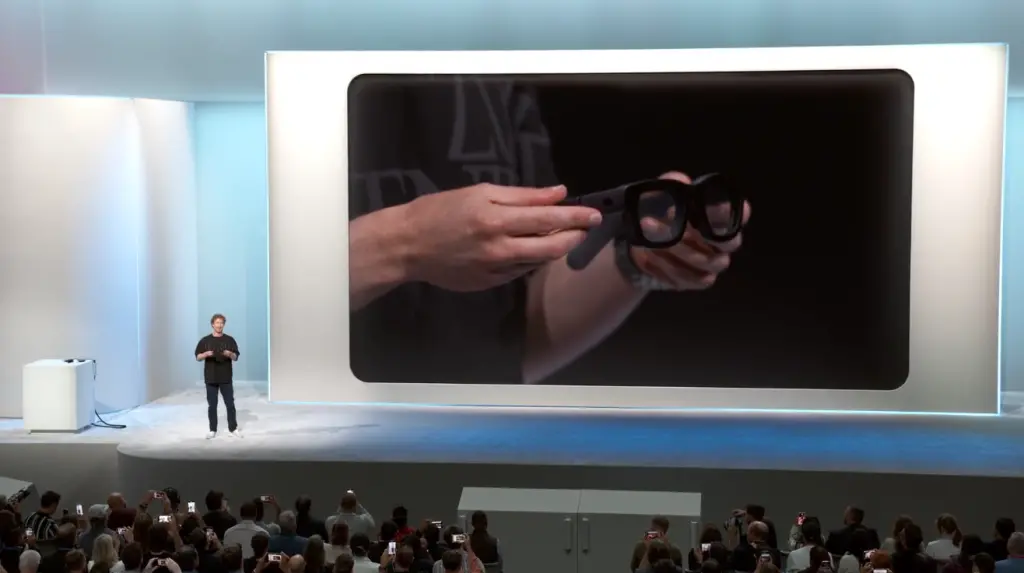

而被扎克伯格称为「无可挑剔」的完全体,也就是 Meta 首款 AR 智能眼镜 Orion,秘密研发了十年,投入了几十个亿美元,今天终于从保密箱中被取出,露出了庐山真面目。

对这款眼镜的第一印象,自然是这个极其接近普通太阳眼镜的外观设计,马上和市面上现有的「大老粗」竞品拉开了不小差距。

因为眼镜也必须要好看。

当然,这也是因为 Meta 并没有选择将所有的组件集成到一个眼镜的形态上。Meta Orion 一共由三个部分组成:眼镜本体,一个手势追踪腕带,以及一个遥控器大小的「计算模块」,三者无线连接。

这种「分体式」的方案,加上机身采用了更轻的镁材料,Orion 眼镜本体实现了惊人的 98 克重量。作为对比,Snap 上周发布的全新 AR 眼镜 Spectacles 重达 226 克。

▲ 上:Meta Orion;下:Snap Spectacle

更让人印象深刻的是,拥有轻薄机身的 Orion 能够实现 2 小时左右的续航,更粗更重的 Spectacles 只有短短的 45 分钟。

眼镜最核心的 AR 投射能力,Orion 在不少方面做到了「遥遥领先」。

Orion 的镜片并非是玻璃显示屏,而是碳化硅透镜,镜框上微型的投影仪会将光发射在波导中,而波导投射在透镜上,从而显示出具有不同纵深和大小的 AR 虚拟内容(扎克伯格称其为「全景图」)。

据 The Verge 的测试,Meta Orion 的视场角高达 70 度,可能是行业内拥有最宽视野的 AR 眼镜。

根据现有的演示视频,用户可以戴着眼镜打开多个 Meta Horizon App 窗户进行多任务,或者用 Meta AI 对现实世界的事物进行识别、标注。

即使用户的视角从这些窗户上面移开,这些虚拟的投射会一直「存在」,静候用户的目光再次回归。

至于投射的画质和清晰度,用来看图文不是问题,但你暂时不会想用这个眼镜看电影。

Meta 擅长的社交能力也和 AR 眼镜碰撞出了新的花样,通话中的好友会以一个全息投影的形象出现在你的面前,不过目前还比较粗糙。

Orion 也有一个朝内的摄像头用于扫描佩戴者的脸部,生成一个实时的建模,用于和手机用户的视频通话画面。

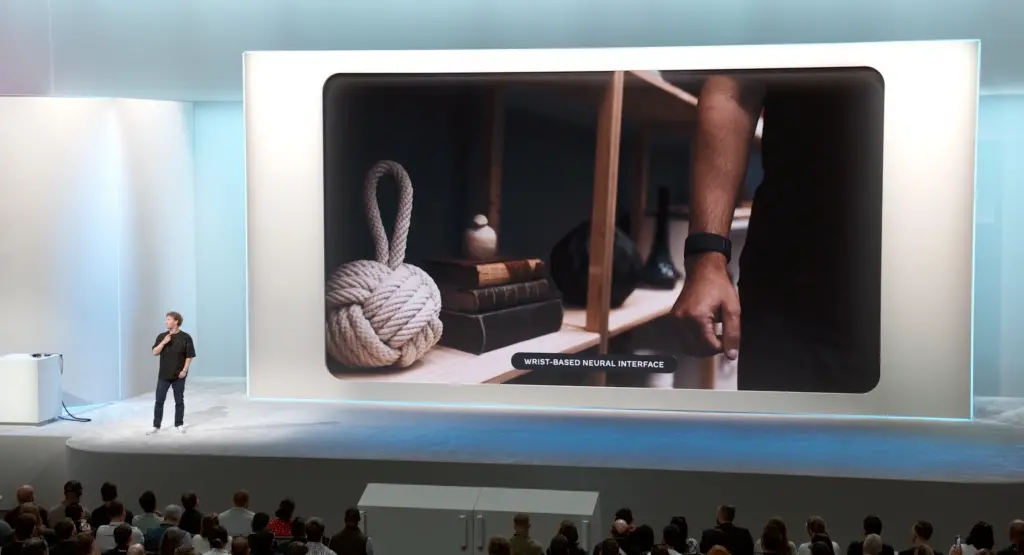

交互方面,Meta Orion 支持眼动追踪、手势操控和 AI 语音操作,佩戴配套的腕带能够实现更精细的手势操作。

这个腕带可以识别一些手势:拇指捏住食指可以选择内容;捏中指和拇指可调用或隐藏应用程序启动器;用拇指抵住合拢的手掌做出抛硬币的手势,即可向上或向下滚动,总体来说非常自然。

值得一提的是,腕带还提供了触觉反馈,让你知道手势有没有被成功识别,解决了目前 MR 交互的一个痛点。

这个腕带的原理是通过肌电图,来读取与手势相关的神经信号,The Verge 甚至评价它「有点像在读心」。

▲ 图源:The Verge

有了这个腕带,用户可以把目光当作 Orion 界面的指针,捏合当作点击,整体体验非常自然,更重要的是,如果要在公众场合用 AR 眼镜,不用再尴尬地对着空气「发号施令」或者「指手画脚」,双手插兜也能完成交互。

在 Ray-Ban 眼镜上已经初露锋芒的 Meta AI,和 AR 也结合出了新玩法,现在能够进一步和现实世界进行交互。

在实机体验中,The Verge 用 Orion 快速识别、标注了桌上放着的食材,并让 Meta AI 根据这些材料生成了一个奶昔的食谱。

虽然扎克伯格表示,Meta Orion 是一款面向消费者打造的产品,但目前的 Orion 设备还是原型机,只面向部分开发者和体验人员提供,其中包括老朋友黄仁勋。

Meta Quest 3S,平价版 Vision Pro 的样子?

扎克伯格登场不到十秒,就公布了 Quest 3S 的价格,这在一众电子产品的发布会中实属罕见,不过还是得感叹一句,开门见山、只讲重点的感觉,真的很棒。

总的来说,Meta Quest 3S 其实是 Quest 3 的「青春版」,128GB 起售价为 299.99 美元(约合人民币 2108 元),256GB 起售价是 399.99 美元(约合人民币 2810 元)。

从配置来看,Quest 3S 搭载了 Snapdragon XR2 Gen 2 处理器,也就是 Quest 3 的同款,而且也同样支持手部追踪。

看完发布会,我感觉比起 Quest 3S 这个命名,其实叫它 Quest 2 改良版会更合适。先前有消息称,作为更加「性价比」的选择,Quest 3S 还是使用了与 Quest 2 相同的透镜,机身整体会比 Quest 3 更厚重一些。

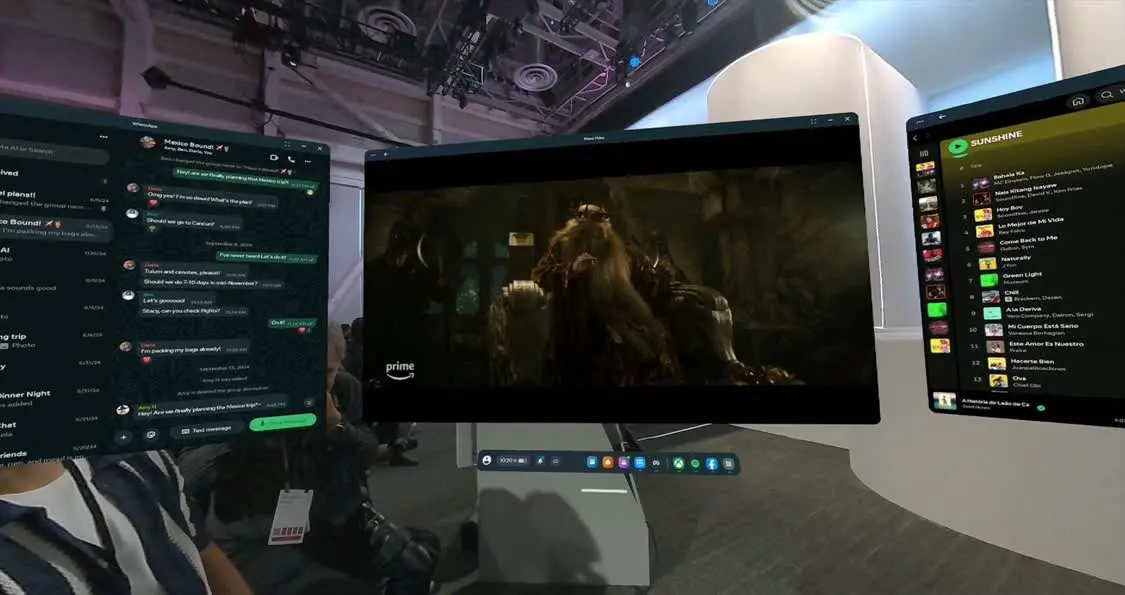

虽然在硬件配置方面 Quest 3S 不及 Quest 3,但在软件生态的体验上,却和老大哥基本持平,Quest 3S 同样可以在 HorizonOS 中获得丰富的娱乐以及办公功能。

去年 Quest 3 发布后,评价一直褒贬不一,其中最被人诟病的是启用视频透视后,延迟过高和畸变严重,扎克伯格称,经过了一年的优化改进,现在的体验有了很大的升级,特别是在 VR 功能、手部追踪和软件适配这三个方面。

用户现在可以在两款产品上,把 2D 网页直接转变为沉浸式办公,就像 Vision Pro 那样,把在设备中打开的界面放在空间的任何位置。

另外,在 Quest 3S 上的剧院模式,可以把单独的界面扩展成一个巨幕影院,屏幕范围能扩充到整个空间里。沉浸式观影在头显设备上已经不是什么新鲜玩意儿了,能适配多少片源和平台,才是拉开各家产品体验的核心。

Quest 3S 支持目前各大欧美主流的媒体平台,Netflix、YouTube 和 Amazon Prime 等都能使用剧院模式观影。

电影和游戏是 VR 头显的娱乐必备,在此基础上的附加功能,往往也能体现出产品本身的性能,这次发布会还公布了 Quest 3S 的新功能——Hyperscale。

用户通过手机扫描房间的轮廓细节,以及家具摆放的位置,接着就能在 Quest 3S 重新构建出一个接近 1:1 的复原场景。

从发布会的演示来看,场景还原度真的不错,毛边和扭曲不是太多,以后线上沉浸式看房,或者足不出户地游玩博物馆或者名胜古迹,又多了一个可以实现的平台。不过除此之外,场景复原的实用性究竟还有哪些?要如何结合每个地区不同的情况将技术落地,是 Meta 和 Quest 今后需要回答的难题。

Meta 的全称是 metaverse,即元宇宙。Facebook 当年改名 Meta 表明了扎克·伯格对新技术探索的决心,而 Meta 也成了最先一批向元宇宙进军的科技巨头。所以「元宇宙」也就成了每次 Meta 新品发布必提及的部分,尽管他们已经在这个领域碰了很多壁。

扎克·伯格在发布会上介绍,Meta Quest 3S 推出了沉浸式社交的增强功能,Quest 的用户现在可以在设备中创建虚拟形象,和彼此一起通关游戏,或者组队进行健身,又或者去听一场线上的演唱会。

随着 Quest 3S 的发布,Quest 2/Pro 也宣布彻底停产,另外 Quest 3 的价格也从 649 美元降至 499 美元,新产品将在 10 月 15 日后发货。

Llama 3.2 发布,多模态能力让眼镜拥有眼睛

比起几乎没变化、甚至还减配的 Meta Quest 3S,Meta AI 的新功能就被衬托得更有新意。

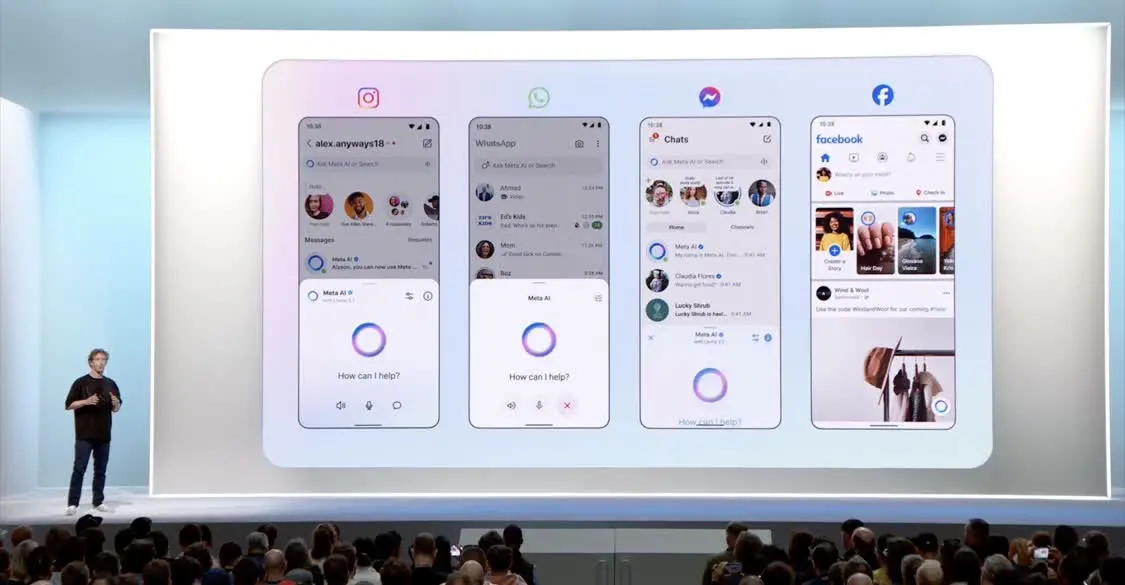

扎克·伯格在发布会上宣布,Meta AI 正式上线语音功能,用户可以通过 Messenger、Facebook、WhatsApp 和 Instagram 向 Meta AI 提出问题或以其他方式聊天,并获得模拟语音回复。

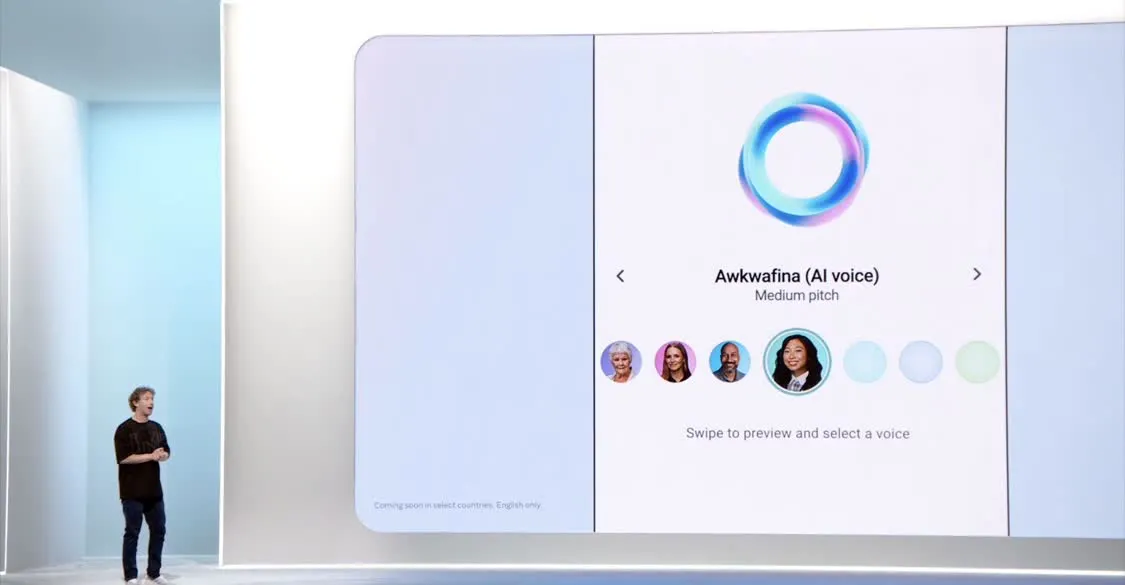

不仅如此,AI 语音的音色还能自主选择,你可以使用包括朱迪·丹奇、约翰·塞纳、奥卡菲娜、克里斯汀·贝尔等名人在内的 AI 声音。

扎克·伯格还在现场演示了语音功能,总体来说对话响应速度还挺快,回答的内容也比较准确,语音语调听起来又向真人问答更近了一步,而且还能随时打断对话插入新的话题或问题。

虽说中间出现了几次失误,不过作为正在探索和发展中的技术这也正常,扎克·伯格本人多次也毫不避讳,就像他本人说的一样:这是 demo 经常会出现的情况。

另外,通过 AI Studio 功能,用户还能根据自身的需求、爱好等,自主创建相应的 AI 角色,它可以帮助我们生成表情包、提供旅行建议,当然也能进行日常的对话。

不过从效果来看,接下来的 AI 翻译功能则更加实用。目前,搭载了 Meta AI 的终端,都能支持实时语音翻译功能,发布会上的两位发言人,通过佩戴 Meta Ray-Ban 完成了一次即时的跨语种(英语-西班牙语)对话。

Meta Ray-Ban 可以通过麦克风采集对方的语音,并迅速翻译成机主的母语,虽说每种语言的翻译响应速度都不算慢,但句子稍微长一点,中间等待的时间还是略显尴尬,而且 Meta AI 有时候还会抢话。

另一个线上视频的语音翻译效果会更上一层楼,比起上面的实时翻译,我愿称之为「高阶版翻译功能」。Meta AI 可以把线上视频的语音翻译成另一个语种的语音,更厉害的是,它能把原视频说话人的语气、音色,甚至于不同国家读英语时的口音都完美还原。

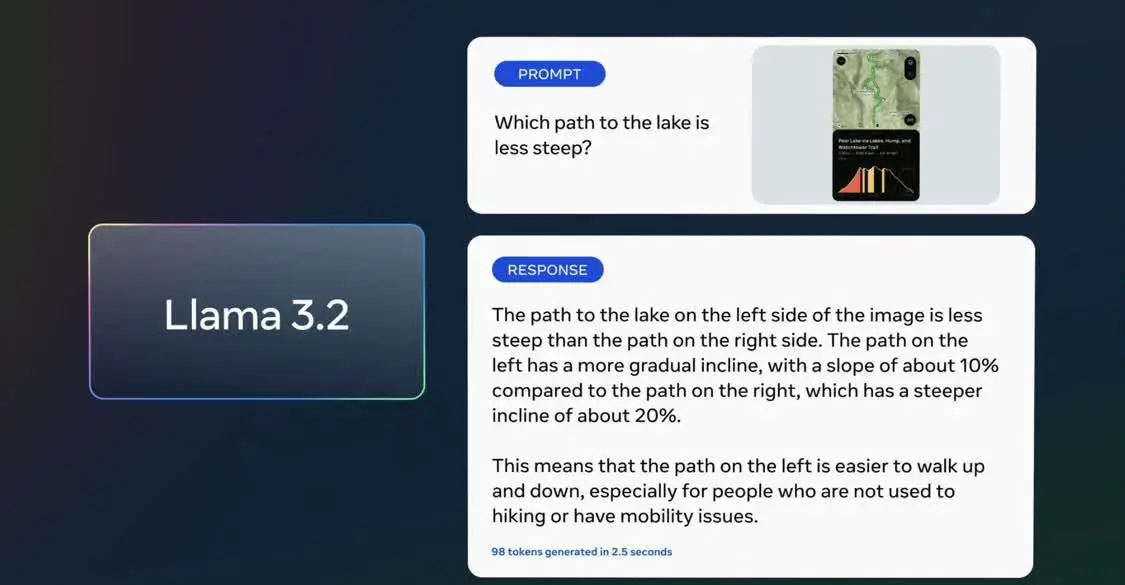

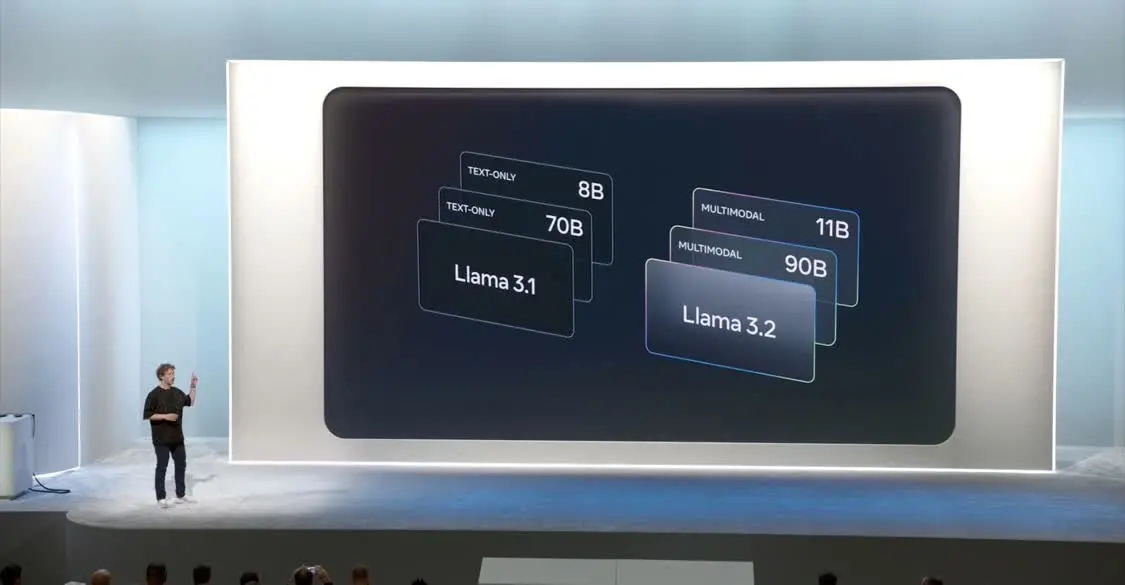

Meta AI 在发布会上一系列的更新功能,其实都有一个共同的驱动核心:Llama 3.2。

今年七月份,Meta 才刚刚公布了 Llama 3.1 模型,简单来说,超大杯 Llama 3.1 405B 是 Meta 迄今为止最强大的模型,也是全球目前最强大的开源大模型,更是全球最强的大模型。

没想到短短两个月 Llama 3.2 就来了。

Llama 3.2 是 Meta 的首个开源 AI 模型,包括两个视觉模型(11B 和 90B)和两个轻量级的纯文本模型(1B 和 3B),这意味着它具备了多模态的能力,也就是可以同时处理文本和图像,其中轻量级的纯文本模型可以直接在本地理解用户输入的内容。

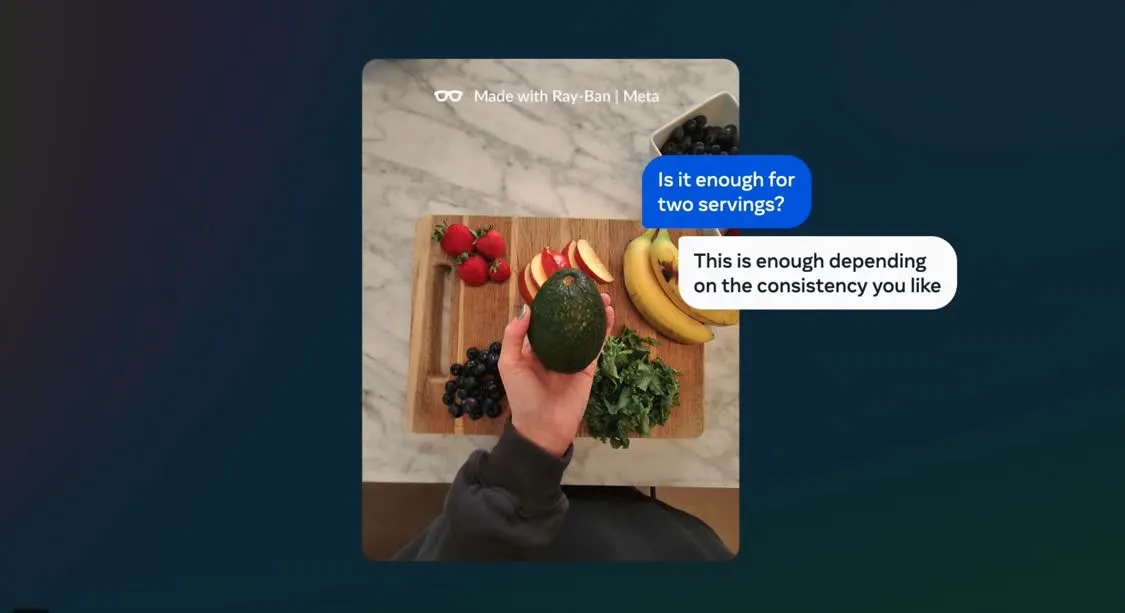

依靠 Llama 3.2 全新的能力,许多搭载大模型的设备也有了更加广泛的实用场景。除了上文提到的 AI 翻译功能, 有了视觉能力的 Meta Ray-Ban 现在能更深入地协助人们的工作生活,日常起居。

你可以直接咨询 Meta Ray-Ban 可以用牛油果做点啥好喝的饮料,你甚至都不需要在句子里提到牛油果,直接用「这个」等代词就行,因为它看得见。

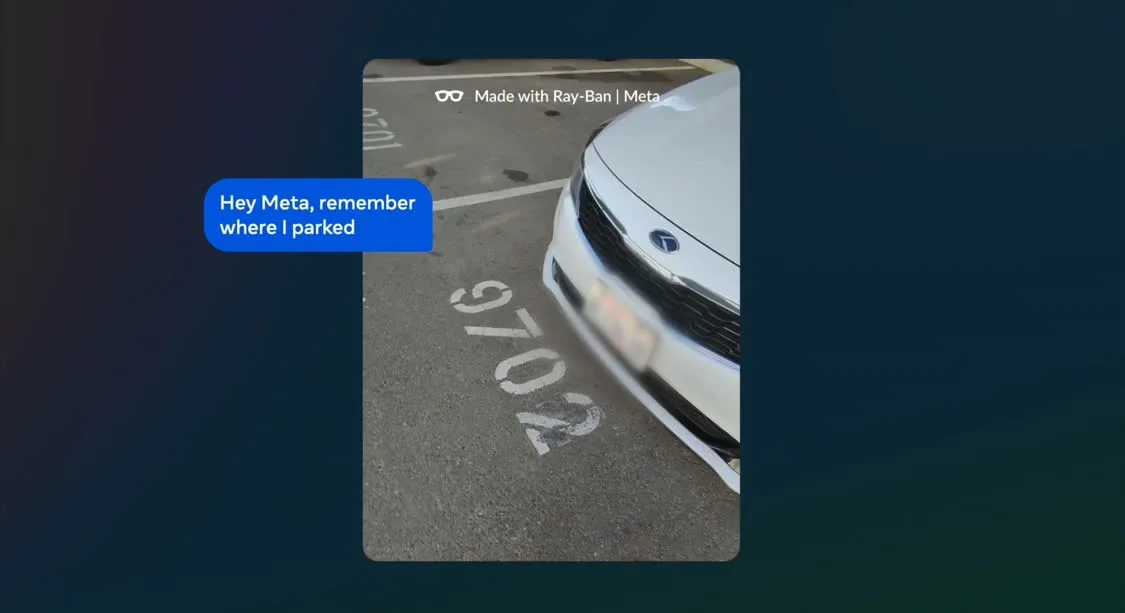

不知道有多少人有过忘记车停在商场哪里的情况,如果你也是忘记车位编号的常客,那现在 Meta Ray-Ban 就能帮你记下车位号码,以便你忘记时随时调取相应的信息。

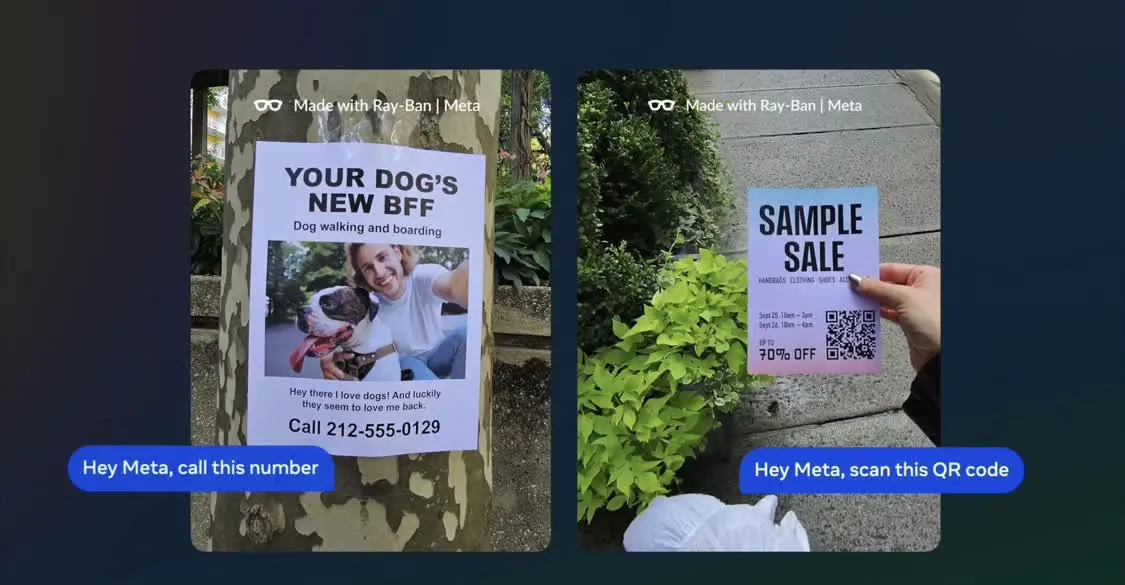

拨打海报上的号码,扫描宣传册上的二维码,帮你搭配日常穿搭…… 总之通过眼镜上的摄像头,加上全新升级的视觉大模型等 AI 能力, Meta Ray-Ban 几乎能出现在你生活的每个角落。

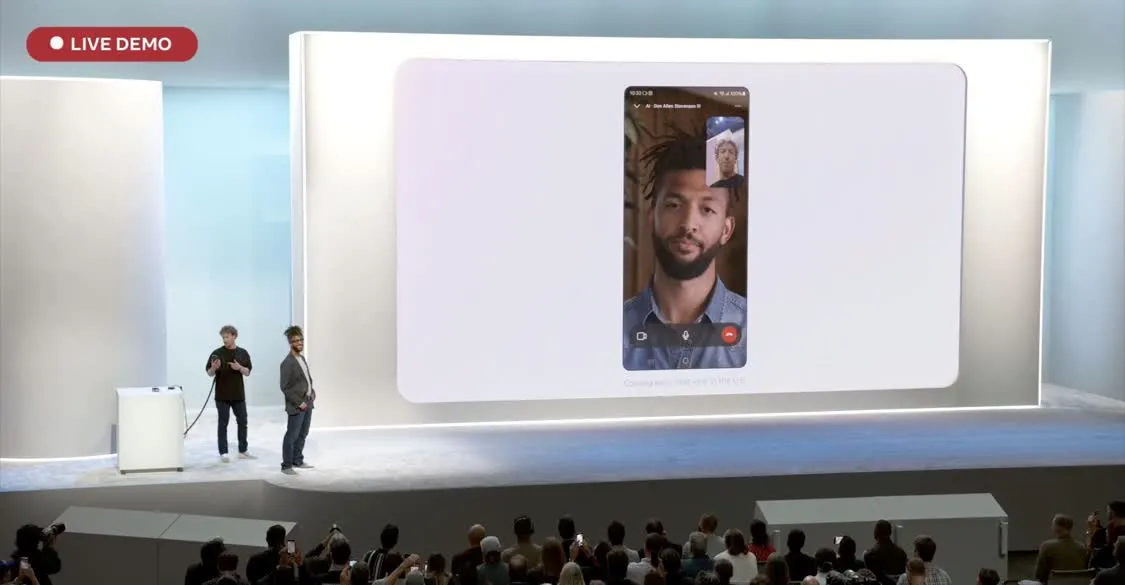

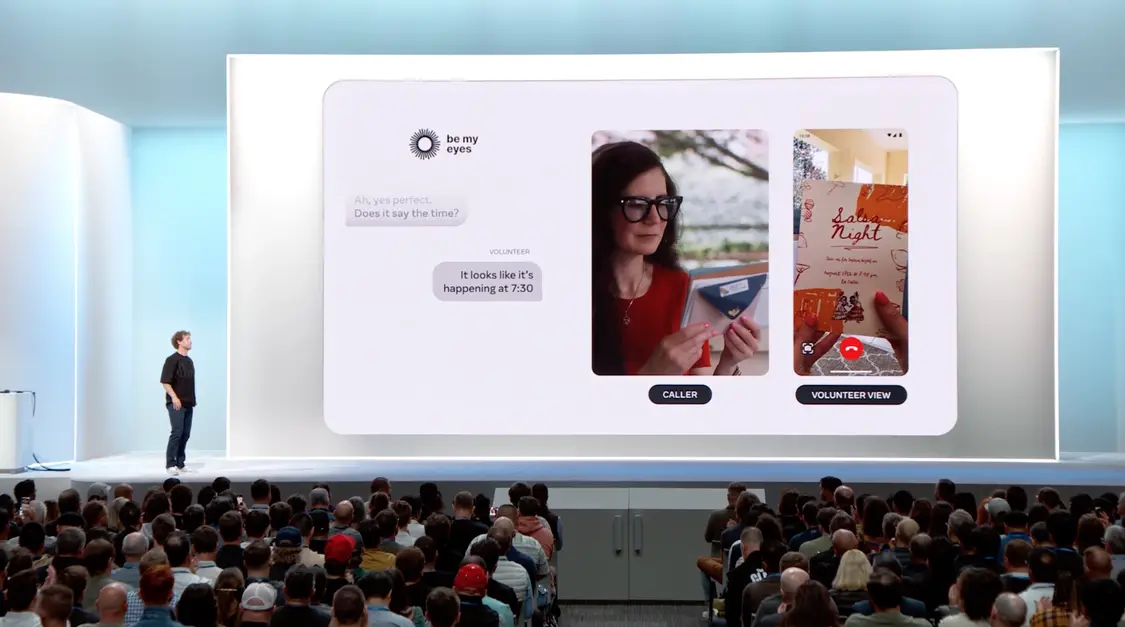

也正是因为这颗摄像头的存在,Be My Eyes 和 Meta 的这次联姻才成为了可能。Be My Eyes 是一家通过实时视频和人工智能,将盲人或视力低下的人,与视力正常的志愿者和公司联系起来的公益平台,通过线上实时的视频通话,志愿者/组织可以帮助智障人士解决眼前的困难。

技术的发展不仅在为绝大多数人的生活增值,也极大程度上弥补了特殊群体中,缺失的那一部分,从而让所有人的生活都能更加方便,技术的意义也就在这里展开。

下一代计算设备的曙光已至

虽然早已对 Meta Orion 眼镜有所预期,但当扎克伯格拿出真机的时候,还是给我们带来了科技新品久违的「惊艳感」。

这种惊艳感不仅是因为 Meta 勾勒的未来蓝图足够吸引,更是因为这个产品的实际效果非常接近愿景,The Verge 在体验过后的评价非常精辟:

它不是虚幻的海市蜃楼,也不是实际的产品。它介于两者之间。

这也是 Orion 和许多 Meta 曾经探索过的奇思妙想不同之处:它不是一个难以走出实验室的概念,而是 Meta 选择「all in」的明日产品,是 AI 和 MR 的完美结合。

它是最佳的 AI 设备:可以看用户所看,听用户所听,能结合用户的现实场景,因此能给出更有效的回答。

它也是终极的交互和联系方式:不需要局限于小屏幕,也不必借助厚重的头显,虚拟和现实世界彼此紧密交融,随时可交互,处处是交互。

手机这种计算设备形态已经走到了生命周期的末尾,这已经是行业的共识;而下一代的计算设备,苹果、Meta,甚至 OpenAI 都正在探索。

尽管还是原型机, Meta 给出的答卷 Orion 目前看来确实不赖,至于是否成为手机之后的下一个主流智能终端,还有很多未知数,但扎克伯格对此倒是信心十足。

眼镜和全息影像将会成为一种无处不在的产品。如果我们能让世界上已经拥有眼镜的人,都升级到拥有 AI 和 MR 的眼镜,那么这将成为世界历史上最成功的产品之一,而且我认为它会走得更远。

评论区

- 这篇文章还没有收到评论,赶紧来抢沙发吧~

【随机内容】

-

马斯克起诉OpenAI和奥特曼:指控其成微软利润工具 而非造福人类

2024-03-01 -

2022-07-12

2022-07-12

-

2022-04-20

2022-04-20

-

2022-10-10

2022-10-10